中国は生成AIでどこまでやれるか?[英エコノミスト]

![中国は生成AIでどこまでやれるか?[英エコノミスト]](/content/images/size/w1200/2023/05/taxiyoshida_Beautiful_Chinese_AI_robot_Cyberpunk_8K_resolution__3ddb1fd3-9348-4c47-bd86-7cf306f57f76.jpg)

北京とワシントンの宣伝文句を聞けば、米国と中国は技術的な覇権をめぐって全面的な競争を繰り広げているようだ。ジョー・バイデン大統領の国家安全保障顧問であるジェイク・サリバンは、昨年9月、「基本的に、今後10年間は一部の技術が非常に重要な役割を果たすと我々は考えている」と宣言した。2月には、中国の最高指導者である習近平が、「国際的な科学技術競争に対処し、高いレベルの自立と自己改善を達成する」ために、「基礎研究を強化し、重要な技術問題を解決することが緊急に必要」と述べて、この気持ちを代弁した。

人工知能(AI)ほど、今、太平洋の両岸の政策立案者を夢中にさせているテクノロジーはないように思える。ChatGPTのような「生成型」AIは、ウェブ上にある人間のテキスト、画像、音声を分析し、ますます通用するシミュラークルを作成することができるが、その能力は急速に向上しており、その強迫観念はさらに強くなっている。もし生成AIが、その支持者たちが主張するような変革をもたらすとしたら、このテクノロジーは、21世紀の地政学的競争において、それを操る者に経済的・軍事的優位性をもたらすかもしれない。欧米と中国の戦略家たちは、すでにAI軍拡競争について話している。中国はそれに勝てるのだろうか?

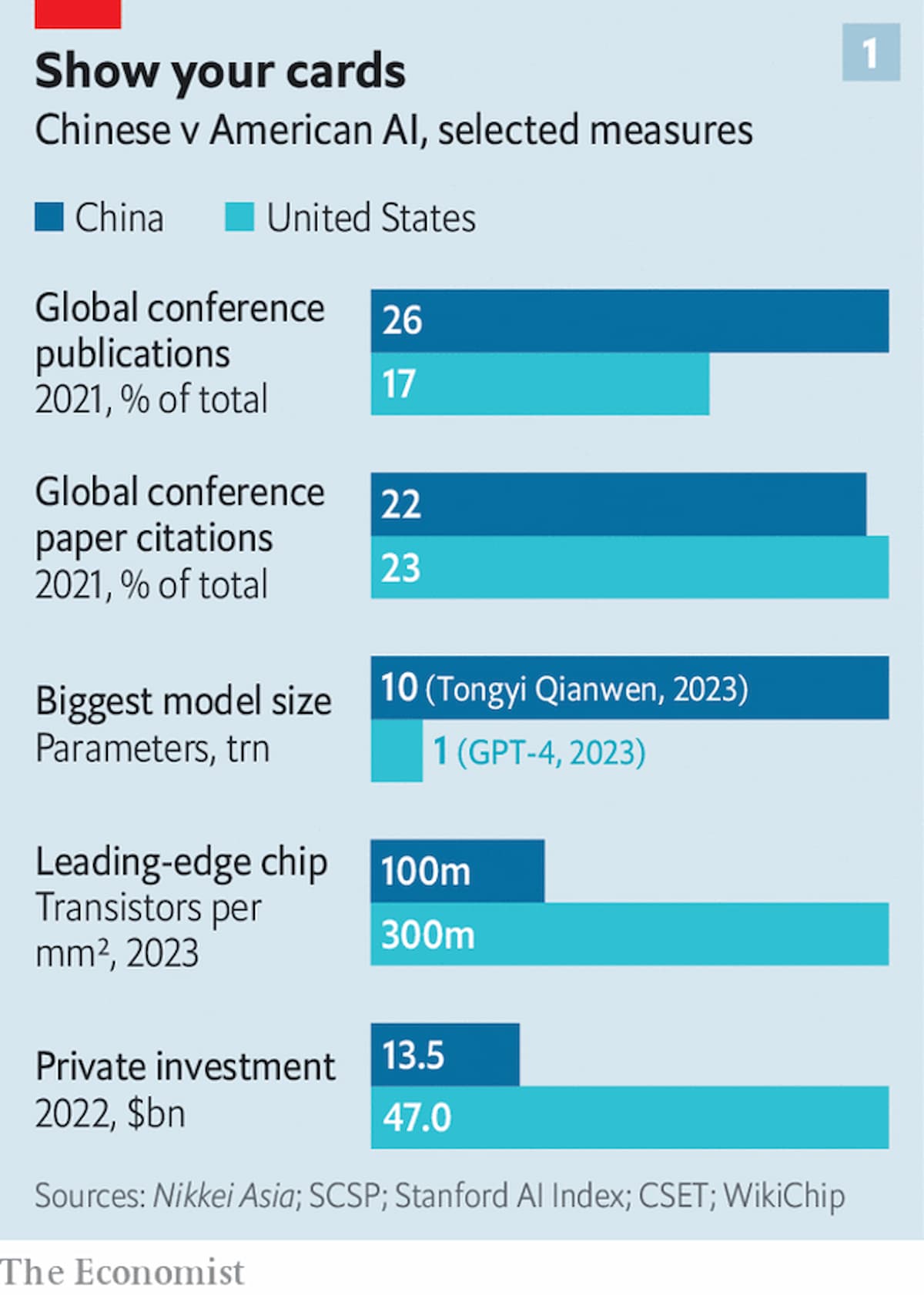

AIの実力を示すいくつかの指標では、独裁国家は少し前に先行している(図表1参照)。2019年には、引用数の多いAI論文のシェアで中国が米国を上回り、2021年には、世界のAI学会発表の26%が中国からであるのに対し、米国のシェアは17%である。AI論文の出版量で、世界のトップ10の機関のうち9つが中国だ。ある一般的なベンチマークによると、共産主義的な監視国家にとって特に有用なAIの一種であるコンピュータビジョンの研究を行っている上位5つの研究所がそうなっている。

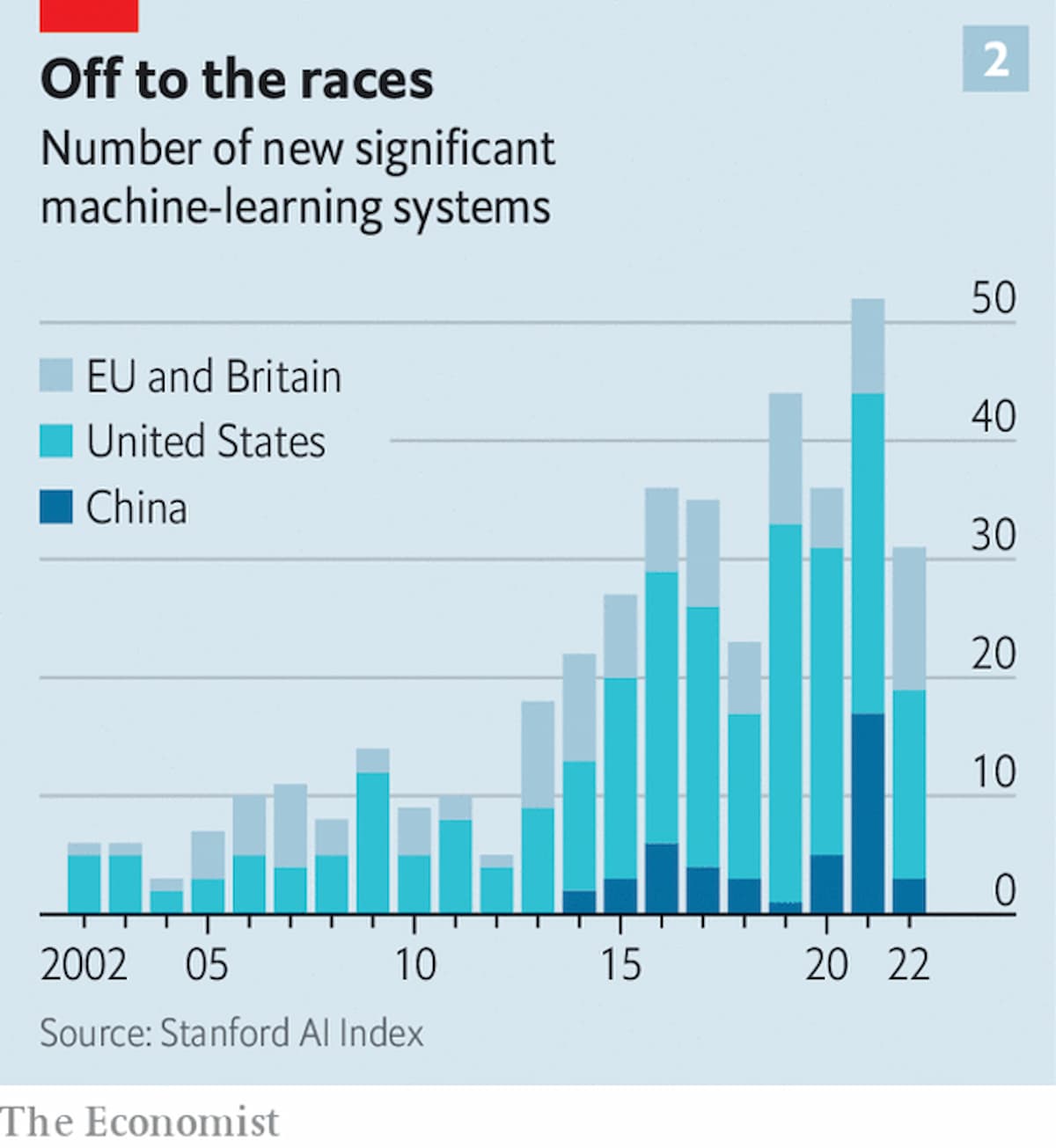

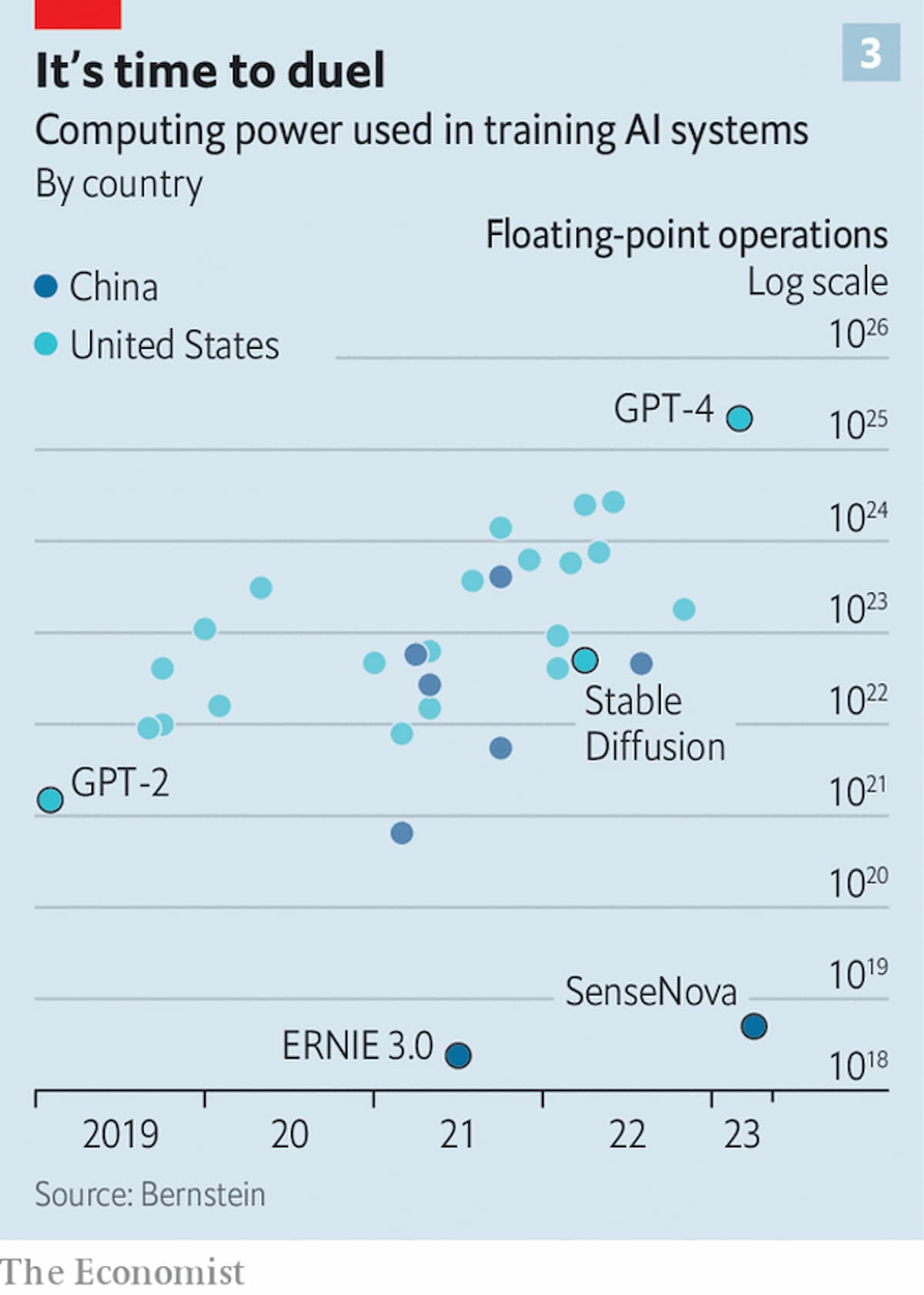

しかし、生成AIの知恵となる「基盤モデル」に関しては、米国がしっかりとリードしている(図表2、3参照)。ChatGPTとその背後にある先駆的なモデル(最新版はGPT-4と呼ばれる)は、米国の新興企業OpenAIの発案によるものである。AnthropicやStability AIのような小さな会社から、Google、Meta、Microsoft(OpenAIを一部所有している)のような巨大企業まで、他の少数の米国企業が独自の強力なシステムを持っている。中国最大のハイテク企業であるアリババとテンセントは、独自の生成型AIをまだ発表していない。

このことから、中国が基盤モデルの構築で米国から2~3年遅れていると、知る人ぞ知る結論に達している。その理由は3つある。1つ目は、データに関することだ。例えば、政府はSenseTimeやMegviiといった企業に中国市民の監視情報を大量に渡すことができ、その企業は中国有数のコンピュータビジョン研究所の協力を得て、それを使って一流の顔認識システムを開発することができた。

ジェネレイティブ・アイズでは、ウェブ上の膨大な非構造化データでモデルを学習させるため、このような利点はあまりないことが判明している。インターネット調査サイト「w3Techs」のデータによると、ウェブサイト全体の56%が英語であるのに対し、中国語はわずか1.5%に過ぎないという事実が、米国のモデルビルダーに有利に働いている。スタンフォード大学のYiqin Fuが指摘するように、中国人は主にWeChatやWeiboといったモバイルのスーパーアプリを通じてインターネットに接している。これらは「壁に囲まれた庭園」であり、コンテンツの多くは検索エンジンにインデックスされない。そのため、AIモデルがコンテンツを吸い上げるのが難しくなっている。国家が支援する北京人工知能アカデミーが2021年に発表したモデル「Wu Dao 2.0」が、GPT-4よりも計算が複雑である可能性があるにもかかわらず、話題にならなかった理由は、データの不足にあるかもしれない。

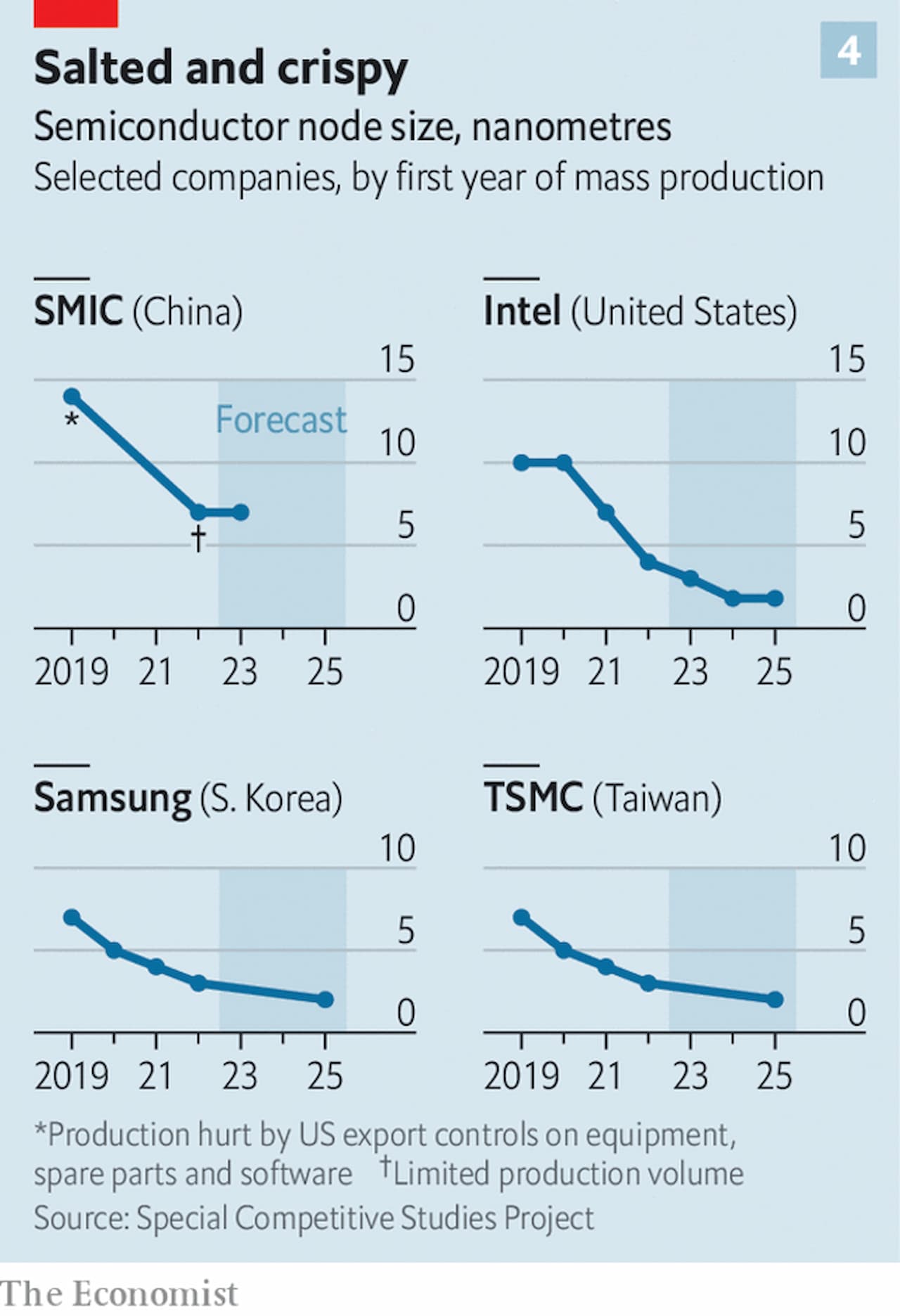

中国が生成的な成果を上げられない2つ目の理由は、ハードウェアに関係している。昨年、米国は、中国がAIで優位に立てる可能性のある技術の輸出規制を行った。この規制の対象は、人工知能のモデルが学習するクラウドコンピューティング・データセンターで使用される強力なマイクロプロセッサーと、中国が独自にそのような半導体を製造できるようにするためのチップ製造ツールである。

そのため、中国のモデルビルダーは損害を被った。英国のシンクタンク、Centre for the Governance of AIが行った中国の26の大型モデルの分析によると、半数以上が処理能力を米国のチップ設計会社であるNVIDIAに依存していることが判明した。中国最大のチップメーカーであるSMICは、NVIDIAのチップを製造する台湾の業界リーダーであるTSMCに1~2世代遅れて試作品を製造しているという報告もある(図4参照)。しかし、SMICが量産できるのは、3〜4年前にTSMCが100万個単位で生産していたチップだけだろう。

中国のAI企業は、米国のもう一つの輸出品である「ノウハウ」を手に入れるのに苦労している。米国は依然として世界の技術者を惹きつけてやまない。米国で開催される主要なAIカンファレンスで論文を発表するAI専門家の3分の2は外国生まれである。2019年、中国人エンジニアはその選ばれたグループの27%を占めた。多くの中国のAIの専門家は、米国で学んだり働いたりした後、専門知識を母国に持ち帰っている。コロナのパンデミックと米中間の緊張の高まりにより、彼らの数は減少している。2022年上半期に米国が中国人留学生に与えたビザは、2019年の同時期に比べ半減している。

データ、ハードウェア、専門知識の三重の不足は、中国にとってハードルとなっている。しかし、このことが中国の「AI」の野望をより長く阻むかどうかは、また別の問題だ。

データを例に挙げる。2月、中国のAI企業の3分の1近くが所在する北京の地方当局は、115の国営組織のデータを公開することを約束し、モデル開発者が遊べるように15,880のデータセットを提供した。中央政府は以前から、中国のアプリの「壁に囲まれた庭」を解体したいと表明しており、より多くのデータが解放される可能性があると、現在オックスフォード大学に在籍する米国人の元外交官、Kayla Blomquistは言う。最新モデルは、機械学習の結果をある言語から別の言語に転送することもできる。OpenAIによると、GPT-4は、トレーニングデータに中国語のソースがほとんどないにもかかわらず、中国語のタスクで顕著なパフォーマンスを発揮したという。バイドゥのErnieは、多くの英語データで学習したとジョージワシントン大学のJeffrey Dingは指摘する。

ハードウェアにおいても、中国は回避策を見つけつつある。フィナンシャル・タイムズ紙は3月、米国からブラックリスト入りしているSenseTimeが、輸出規制を回避するために仲介業者を使っていると報じた。中国のAI企業の中には、他国のクラウドサーバーを通じてNVIDIAのプロセッサーを利用しているところもあるようだ。あるいは、NVIDIAのあまり高機能でないプロセッサを購入することもできる。NVIDIAは、広大な中国市場に対応するため、制裁に準拠したプロセッサを設計したが、その速度は最高級品よりも10%から30%遅くなる。これらの製品は、中国の顧客にとって、処理能力の単位あたりでより高価なものとなっている。しかし、仕事はできるのだ。

中国は、「オープンソース」モデルの助けを借りて、チップの不足と頭脳の不足を部分的に緩和することができる。このようなモデルの内部構造は、誰でもダウンロードすることができ、特定のタスクに合わせて微調整することができる。その中には、モデルの構造を定義する「重み」と呼ばれる数値が含まれており、これはコストのかかるトレーニングから導き出される。スタンフォード大学の研究者は、Metaの基礎モデルであるLLaMaの重みを使って、Alpacaというモデルを600ドル未満で構築した(GPT-4のようなモデルのトレーニングには1億ドルかかると言われている)。Alpacaは、いくつかのタスクでChatGPTのオリジナルバージョンと同等の性能を発揮している。

中国のAI研究所も同様に、国際的な研究チームの知恵を結集したオープンソースのモデルを利用することができる。同じくシンクタンクのカーネギー国際平和財団のマット・シーハンは、中国は「ファスト・フォロワー」であることに特徴があると述べている。中国の研究所は海外の進歩を吸収し、それを迅速に自国のモデルに組み込んでおり、多くの場合、国家の資金が投入されている。シリコンバレーの著名なベンチャーキャピタリストは、オープンソースモデルを共産党への贈り物と呼び、より露骨な表現をしている。

このように考えると、米国も中国も、AIのモデリングで抜きんでたリードを築けるとは考えにくい。たとえ中国が米国の制裁に遭って割を食っても、それぞれが同じような能力を持つAIを手に入れることは可能だろう。しかし、モデル構築の競争がデッドヒートとなった場合、米国には、最先端のイノベーションを経済全体に普及させる能力という、AIの大勝利を収める可能性があるものがある。1950年代、民主的な敵国であったソビエト連邦の2倍の科学論文を発表していた米国が、技術的なリードを広げることができたのは、結局のところ、より効率的な技術の拡散があったからだ。

中国は、ソビエト連邦よりもはるかに新しい技術を取り入れる能力が高い。フィンテック・プラットフォーム、5G通信、高速鉄道など、そのどれもが世界トップクラスである。しかし、こうした成功は例外であって、ルールではないかもしれないとJeffrey Dingは言う。特に、クラウドコンピューティングやビジネスソフトウェアの導入は、AIを補完するものとして、中国はあまりうまくいっていない。

また、米国の輸出規制は、中国のモデル作りをすべて頓挫させるわけではありないが、中国のハイテク産業をより広範囲に制約するため、新しい技術の採用が遅れることになる。さらに、中国の企業全体、特に中小企業では、技術普及のパイプ役となる技術者が不足している。経済の大部分は国有企業に支配されており、国有企業は堅苦しく、変化を嫌う傾向がある。その一部はいかがわしいものだ。中国のチップのための「ビッグファンド」は、国内の半導体企業を支援する目的で2014年に500億ドルを調達したが、不祥事に見舞われたことがある。何千もの新しいAIスタートアップの多くは名ばかりのAIで、国が優遇する産業に配る贅沢な補助金の一部を得るためにラベルを貼っている。

その結果、中国の民間企業は、生成的なAIを十分に活用するのに苦労するかもしれない。特に、共産党が検閲官が嫌がることをチャットボットに言わせないよう、厳しい規則を課した場合はなおさらだ。このようなハンディキャップは、2年半にわたる中国のハイテク産業に対する弾圧など、習近平による広範な民間企業への屈服に加えられることになる。

反テクノロジーキャンペーンは正式に終了したが、少なくともAIビジネスには深い傷跡を残している。昨年、中国のAI新興企業への民間投資は135億ドルで、米国のライバル企業に流れた金額の3分の1にも満たない。データプロバイダーのPitchBookによると、2023年の最初の4カ月間で、この資金格差は拡大する一方であるようだ。生成AIが革命的であるかどうかは別として、自由市場は、誰がそれを最大限に活用するかに賭けたのである。■

From "Just how good can China get at generative AI?", published under licence. The original content, in English, can be found on https://www.economist.com/business/2023/05/09/just-how-good-can-china-get-at-generative-ai

©2023 The Economist Newspaper Limited. All rights reserved.

翻訳:吉田拓史、株式会社アクシオンテクノロジーズ