「ジェネラリストな医療AI」という夢のような提案

科学誌『Nature』で非常に広範な医療タスクを行えるジェネラリストな人工知能(AI)が提案された。患者とのやり取りによる情報収集から、医師の臨床での意思決定支援まで、広範に渡る応用を行うAIだ。AlphaFoldによるタンパク質の立体構造予測以来、医学界はAI応用の激流の中にいる。

科学誌『Nature』で非常に広範な医療タスクを行えるジェネラリストな人工知能(AI)が提案された。患者とのやり取りによる情報収集から、医師の臨床での意思決定支援まで、広範に渡る応用を行うAIだ。AlphaFoldによるタンパク質の立体構造予測以来、医学界はAI応用の激流の中にいる。

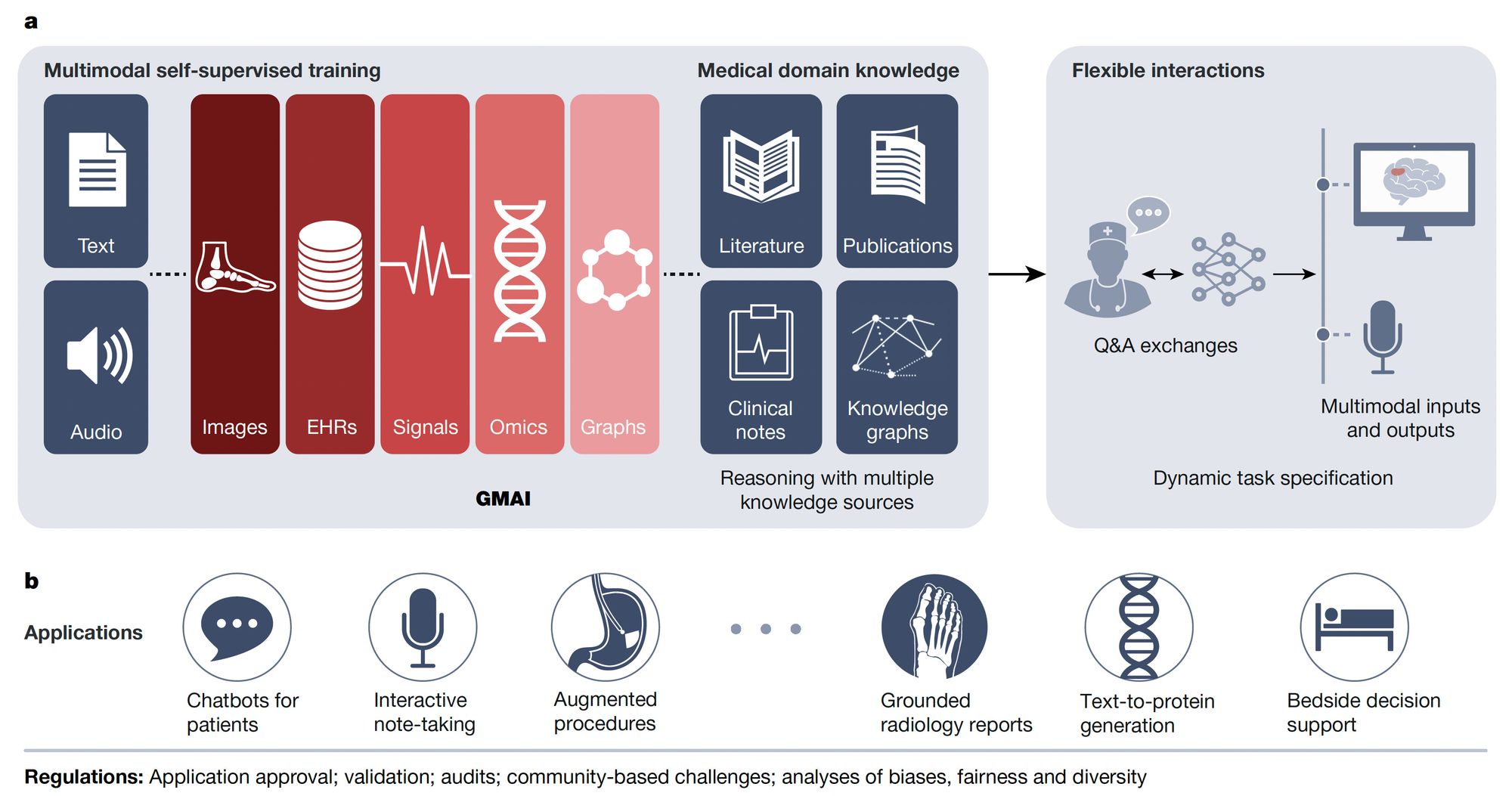

スタンフォード、ハーバードなどの研究者らは、『Nature』誌の4月12日号で、医療用AIの新しいパラダイムである「ジェネラリスト医療人工知能(Generalist medical artificial intelligence: GMAI)」を提案した[1][2]。

これは、多くの医療アプリケーションとデータタイプにわたって知識豊富で柔軟で再利用可能な、新しい種類の医療AIモデルであるという。

研究者らは、GMAIモデルは、タスク固有のラベル付けされたデータをほとんど、あるいは全く使わずに、多様なタスクを実行することができるようになる、と予想。GMAIは、大規模で多様なデータセットを自己監視することによって構築され、画像、電子カルテ、検査結果、ゲノム、グラフ、医療テキストなどのデータを含む、医療モダリティのさまざまな組み合わせを柔軟に解釈することができると想定している。

GMAIが画像、電子カルテ、検査結果、ゲノム、医療テキストなどのさまざまなデータの組み合わせで、ChatGPTのようなモデルの能力をはるかに超えて解釈できるようになると論文は主張した。これらのGMAIモデルは、音声による説明、推奨事項の提示、スケッチの描画、画像の注釈を行う予定だ。

そして、そのモデルは、フリーテキストによる説明、音声による推奨、画像注釈など、高度な医療推論能力を示す表現豊かなアウトプットを生成すると研究者らは考えている。

これは、機械学習(ML)の医療における応用範囲が医療画像だけの制約されたフェーズが終わることを意味するという。電子カルテ、センサー、画像、ラボ、ゲノム、生物学的レイヤーのデータ、そしてあらゆる形態のテキストや音声からなる全幅のデータへと拡張される。知識のドメインには、出版物、書籍、文献のコーパス、エンティティのネットワーク関係(知識グラフ)などがある。

「これまでのヘルスケアにおけるAIは、狭く、単一モダルで、単一タスクであった。500以上のFDAが認可または承認したAIアルゴリズムについては、ほぼすべてが1またはせいぜい2タスクのためのものだった」と著者の一人である心臓病学者のEric Topolは書いている。

「それを超えるためには…マルチモーダルなデータを取り込むことができるモデルが必要だった。Transformerモデルアーキテクチャ、GPU、教師あり学習、大規模なマルチモーダルデータの入力など、これらの構成要素が最終的に今日の状況につながっている。GPT-4は最も先進的な大規模言語モデル(LLM)であり、私たちはまだ初期段階にいる」

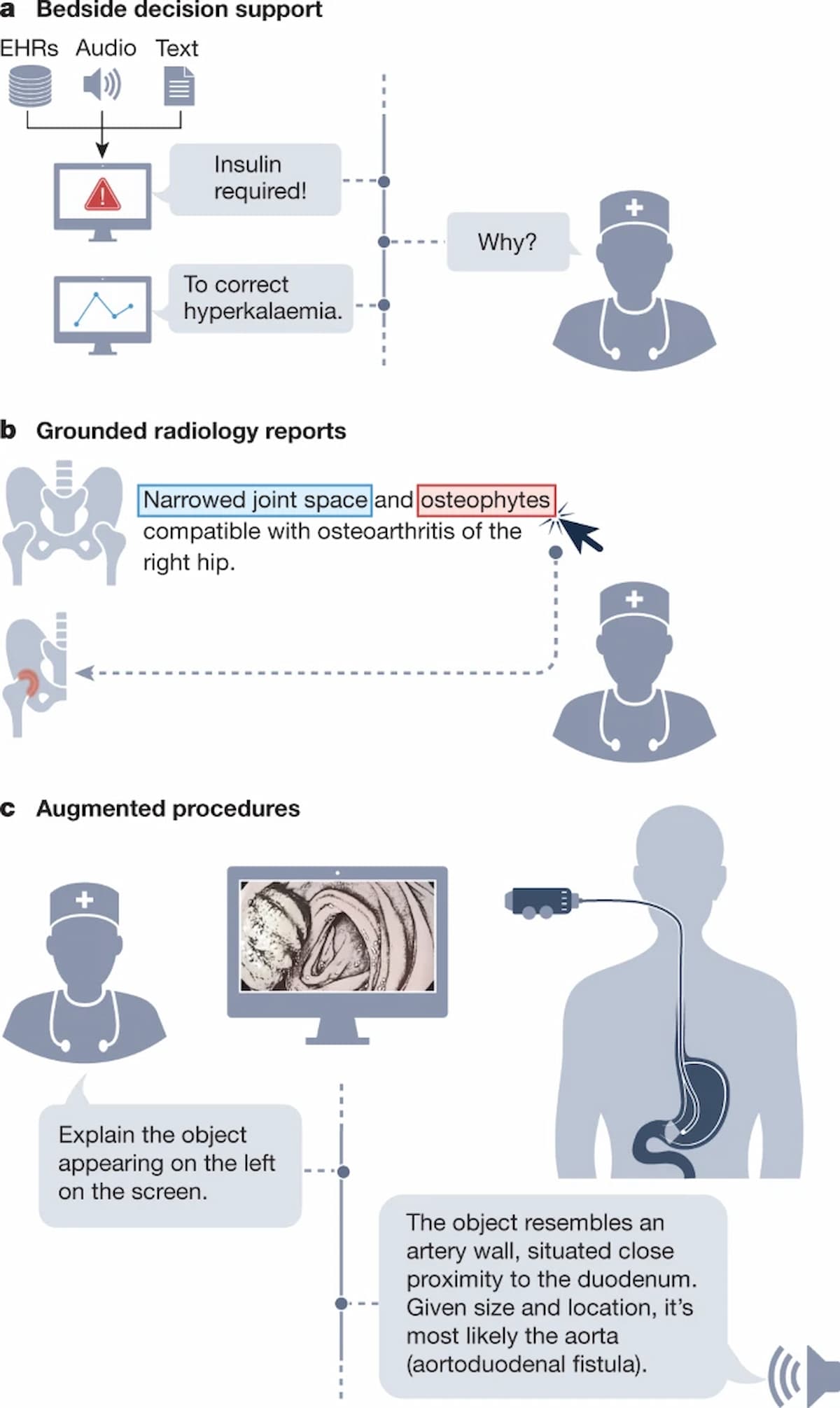

論文は、患者とのやり取りによる情報収集から、医師の臨床での意思決定支援まで、GMAIで様々なユースケースに取り組むことができると説明している。

放射線科では、患者の病歴を考慮しながら、異常箇所を視覚的に指摘する放射線診断書を作成することができる。放射線科医は、GMAIモデルとチャットすることで、症例に対する理解を深めることができる。「前の画像にはなかった新しい多発性硬化症の病変を強調できますか?」というふうに。

論文の中で科学者たちは、GMAIを信頼できる技術に発展させるために必要な追加の要件と機能を説明した。このモデルは、個人的な医療データや過去の医療知識をすべて収集し、その利用を許可したユーザーと対話するときにのみ、それらを参照できるようにする必要があると指摘している。そして、看護師や医師のように患者と会話し、新たな証拠やデータを収集したり、さまざまな治療計画を提案したりできる必要がある。

今後の開発への懸念

共著者らは研究論文の中で、1,000の医療課題をこなすモデルが、さらに多くのことを学習する可能性があることの意味を取り上げている。「医療におけるジェネラリストモデルの最大の問題は、検証だと考えています。そのモデルが正しいこと、そして単なる作り話でないことをどうやって確認するのでしょうか?」とLeskovecはスタンフォード・ニュースに対して言っている。

彼らは、ChatGPT言語モデルの欠陥がすでに発見されていることを指摘している。「しかし、AIシステムが生死を左右するような重大なシナリオがある場合、検証は本当に重要になります」とMoorは言う。

注釈

[1]Moor, M., Banerjee, O., Abad, Z.S.H. et al. Foundation models for generalist medical artificial intelligence. Nature 616, 259–265 (2023). https://doi.org/10.1038/s41586-023-05881-4

[2]スタンフォード大学工学部のコンピュータサイエンス教授であるJure Leskovec、同工学部の博士研究員であるマイケル・ムーア、ハーバード大学のOishi BanerjeeとPranav Rajpurkar、イェール大学のHarlan Krumholz、トロント大学のZahra Shakeri Hossein Abad、Scripps Research Translational InstituteのEric Topolらの研究