DeepMind研究者「英語以外で自然言語処理の研究を行うべき」

DeepMindの研究者であるSebastian Ruderが「英語以外の言語で自然言語処理の研究を行なうべき理由」というブログ記事を投稿した。世界中で7000以上の言語が話されているが、NLPの研究ではほとんどが英語に焦点を当てている。Ruderは、この文脈の中で、なぜ英語以外の言語に取り組むべきなのかを概説した。

要点

DeepMindの研究者であるSebastian Ruderが「英語以外の言語で自然言語処理の研究を行なうべき理由」("Why You Should Do NLP Beyond English")というブログ記事を投稿した。世界中で7000以上の言語が話されているが、NLPの研究ではほとんどが英語に焦点を当てている。Ruderは、この文脈の中で、なぜ英語以外の言語に取り組むべきなのかを概説した。

ここ数年、自然言語処理の多くのタスクでエキサイティングな進歩が見られたが、そのような成果のほとんどは、英語とその他の少数の高リソース言語のセットで達成されている。

社会的な視点

Ruderは、どの言語を話すかによって、情報へのアクセスや教育、さらには人と人とのつながりが決まる、ことを問題視している。「インターネットは誰にでも開かれていると思っていても、支配的な言語(主に欧米諸国の言語)とそれ以外の言語との間には、デジタル言語の隔たりがある。ウェブ上で表現されている言語はわずか数百の言語に過ぎず、少数言語の話者は利用できる情報が著しく制限されている」。

「技術的な包摂の欠如が続くことは、言語格差を悪化させるだけでなく、サポートされていない言語や方言の話者を、より技術的にサポートされているリソースの高い言語に駆り立て、そのような言語の多様性をさらに危険にさらす可能性がある。英語以外の言語の話者が取り残されないようにすると同時に、既存の不均衡を相殺して言語と識字率の障壁を下げるためには、我々のモデルを英語以外の言語にも適用する必要がある」。

言語学的な視点

計算言語学者は言語理解の方法を開発してきたが、それは一般的に英語という単一の言語にしか適用されていない。「英語をはじめとする少数の高資源言語(高品質なデータセットが存在する言語)は、多くの点で世界の他の言語を代表するものではありません。多くの資源に富む言語の多くはインド・ヨーロッパ語族に属し、ほとんどが西欧世界で話されており、形態学的に貧弱である。すなわち、情報はほとんどが構文的に表現されており、例えば、単語レベルでのバリエーションよりも、固定された語順や複数の別々の単語を使用している」とRuderは説明する。

より全体的に見るには、異なる言語の類型論的特徴を見ないといけない。「『World Atlas of Language Structure』には、192の類型論的特徴、すなわち言語の構造的・意味的特性がカタログ化されている。例えば、ある言語における主語、目的語、動詞の典型的な順序を記述した類型論的特徴がある。各特徴は平均して5.93のカテゴリを持っている」。

特徴カテゴリは、言語所属するグループによって大いに分散がある。このようなタイプ別特徴の大規模なサブセットを無視すると、我々のNLPモデルは一般化に役立つ貴重な情報を見逃してしまう可能性がある、とRuderは指摘している。

「英語以外の言語を扱うことは、世界の言語間の関係についての新しい知識を得るのに役立つかもしれない(Artetxe et al., 2020)。逆に、自分たちのモデルがどのような言語的特徴を捉えることができるのかを明らかにするのに役立つかもしれない。具体的には、特定の言語についての知識を使って、例えば、ダイアクリティックの使用、広範な複合語、抑揚、派生、重複、凝集、融合など、英語とは異なる側面を探ることができるかもしれない」。

機械学習の視点

我々のモデルは一般的であることを意図しているにもかかわらず、その帰納的バイアスの多くは英語とそれに類似した言語に固有のものだ。

Ruderは様々な先行研究に触れ、英語固有のバイアスを例証する。「同様に、ニューラルモデルは、形態素が豊富な言語の複雑さを見落としていることが多い (Tsarfaty et al., 2020)。サブワードのトークン化は重複を伴う言語ではうまくいかない(Vania and Lopez, 2017)。バイトペアのエンコーディングは形態素とうまく整合せず(Bostrom and Durrett, 2020)、より大きな語彙数を持つ言語は言語モデルにとってより困難である。文法、語順、構文の違いもまた、ニューラルモデルにとって問題となる (Ravfogel et al., 2018; Ahmad et al., 2019; Hu et al., 2020)。さらに、我々は一般的に、事前に訓練された埋め込みがすべての関連情報を容易に符号化すると仮定しているが、これはすべての言語に当てはまるわけではないかもしれない (Tsarfaty et al., 2020)」

計算言語学者が提案する最近のモデルは、その過程で、英語データの特性や条件に合わせてオーバーフィットしてきた。特に、データセットの多い言語に焦点を当てることで、大量のラベル付きデータとラベルなしデータが利用可能な場合にのみ有効な手法を優先してきた。

「**対照的に、現在の手法のほとんどは、世界のほとんどの言語に共通するデータの乏しい条件に適用された場合にうまくいかない。**下流のタスクのサンプルの複雑さを劇的に減少させる事前学習言語モデルの最近の進歩(Petersら、2018; Howard and Ruder、2018; Devlinら、2019; Clarkら、2020)でさえ、世界のほとんどの言語では利用できない大量のクリーンでラベル付けされていないデータを必要とする(Artetxeら、2020)。このように、少ないデータで良好な結果を得ることは、現在のモデルの限界をテストするための理想的な環境であり、リソースの少ない言語での評価は、おそらく最もインパクトのある実世界での応用を構成している」。

文化的・規範的視点

言語モデルが訓練されたデータからは、特定の言語の特徴だけでなく、文化的規範や常識的な知識も明らかになる。

しかし、そのような常識的知識は文化によって異なるかもしれない。例えば、「無料」と「無料でない」の概念は文化の違いによって異なり、「無料」とは、レストランの塩のように、誰もが許可を求めずに使用することができるものだ。タブーとされる話題も文化によって異なる。さらに、文化によって、相対的な力や社会的な距離の評価も異なる (Thomas, 1983)。さらに、データセットに含まれるような実世界の状況の多くは、多くの人の直接の経験とは一致せず、また、世界の多くの人にとって明らかな背景知識となっている重要な状況を反映していない(Ponti et al., 2020)。

「その結果、主に欧米を起源とする英語データにしか接していなかったエージェントは、欧米諸国の話者とはそれなりの会話ができるかもしれないが、異文化の人との会話は実用上の失敗につながる可能性がある」。

「文化的な規範や常識的な知識を超えて、私たちがモデルを訓練するデータには、その根底にある社会の価値観が反映されている。NLPの研究者や実践者として、私たちは自分のNLPシステムが特定の国や言語コミュニティの価値観を独占的に共有することを望むかどうかを自問自答しなければならない」

「この判断は、テキスト分類のような単純なタスクを主に扱う現在のシステムではあまり重要ではないかもしれませんが、システムがよりインテリジェントになり、複雑な意思決定タスクを扱う必要があるようになればなるほど重要になってくるでしょう」。

認知の視点

Ruderは、モデルは最終的に、どの言語の構造にも固有ではなく、異なる特性を持つ言語にも一般化できる抽象化を学習できるようにならなければならない、と主張する。

人間の子供はどんな自然言語も習得することができ、その言語理解能力はあらゆる種類の言語間で驚くほど一貫している。人間レベルの言語理解を達成するためには、我々のモデルは、異なる言語族や類型の言語間で同じレベルの一貫性を示すことができなければならない。

計算言語学者ができること

- データセット:新しいデータセットを作成する場合は、アノテーション予算の半分を別の言語で同じサイズのデータセットを作成するために確保してください。

- 評価:特定のタスクに興味がある場合は、別の言語で同じタスクでモデルを評価することを検討してください。いくつかのタスクの概要については、NLP ProgressやXTREMEベンチマークを参照してください。

- Bender Rule:あなたが取り組んでいる言語を記述してください。

- 前提条件:モデルが使用するシグナルと、モデルが行う前提条件を明確にしてください。あなたが研究している言語に特有のものと、より一般的なものを考慮してください。

- 言語の多様性:研究している言語のサンプルの言語の多様性を推定してください (Ponti et al., 2020)。

- 研究:資源の少ない言語の課題に取り組む方法に取り組む。

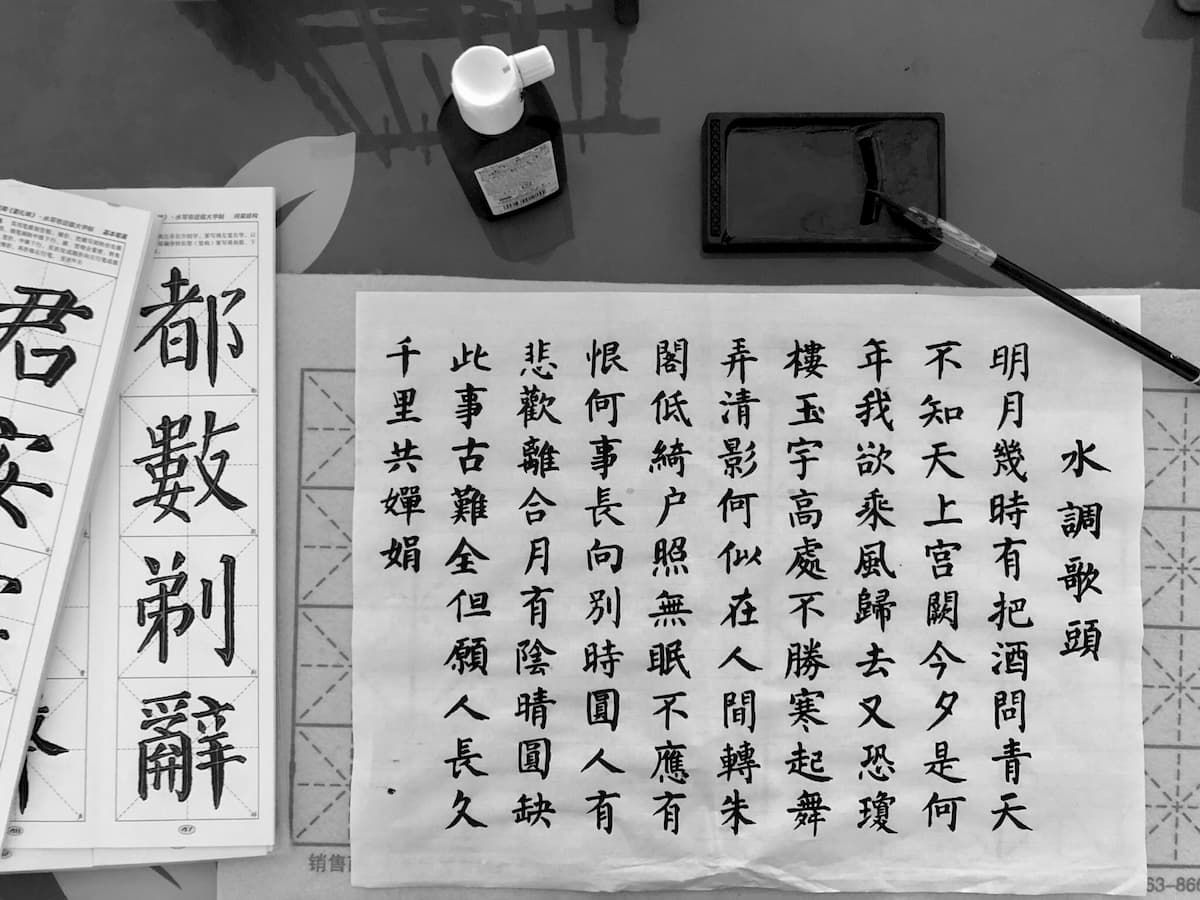

Photo by Cherry Lin on Unsplash