SNSの分断を防ぐためのナッジ|笹原和俊|メディアの未来#2

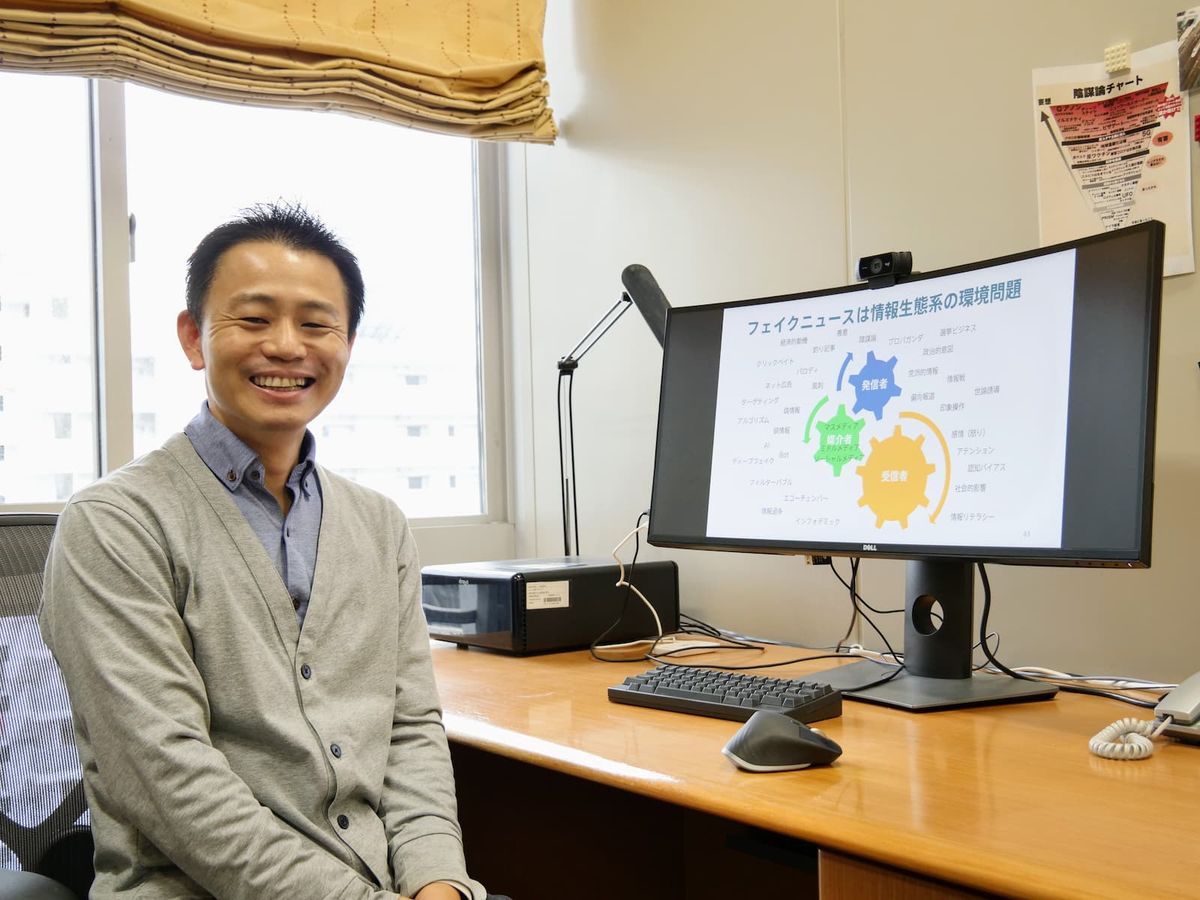

アクシオンでは「メディアの未来」と題し、編集長の吉田拓史が様々な識者にインタビューを行うことにした。第2回のインタビュイーは、東京工業大学環境・社会理工学院准教授で、国立情報学研究所客員准教授でもある笹原和俊。

デジタル化、スマホ化、そして近年のSNSをめぐる様々なトラブル。「メディア」は再び岐路に立たされている。そこでアクシオンでは「メディアの未来」と題し、編集長の吉田拓史が様々な識者にインタビューを行うことにした。

第2回のインタビュイーは、東京工業大学環境・社会理工学院准教授で、国立情報学研究所客員准教授でもある笹原和俊。

SNSが生み出すデータを使って社会科学の新しい地平を探ってきた計算社会科学の研究者である笹原に、「ソーシャルメディアのいま」を聞いた。

「SNSがあろうがなかろうが、もちろん分断は起こり得るわけです。現実世界でもそういうことは実際にありました」と笹原は言う。しかし、SNSは状況を変化させるようだ。「ただ、SNSがあることで、それがより高速に起こってしまうというのがこの研究が示したことです」

笹原が2020年にインディアナ大学の研究者たちと出版した研究は、リベラルからコンサバティブまで多様な意見を持つ人々から構成されるソーシャルネットワークを仮定し、その構成者がお互いの意見を交換するうちに、二極化することを示すものだ。

「普段、われわれがSNSでやっていることを、このコンピューターシミュレーション上のエージェントにやらせてみます」と笹原は言う。「それを繰り返しやっていくと、一体、ネットワーク全体としてはどのような性質が創発するのかを見ようとしました」。

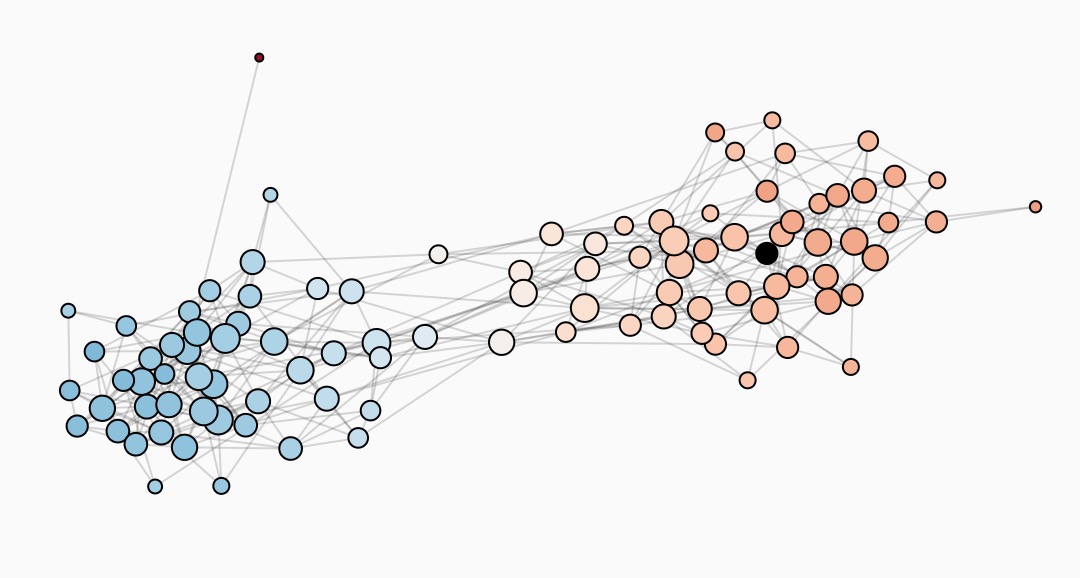

笹原らが採用した計算モデルは将棋や囲碁のような「ターン制」の時間を採用し、一回のターンのたびに、ユーザーが選択され、友人によって投稿または再投稿(リツイートやシェアに相当)されたメッセージが彼らに対して表示される。ユーザーの意見はメッセージに基づいて変更され、その後、ユーザーがフォロー/アンフォローを行ってターンが終了する。このターンを繰り返していくと、ネットワークの意見は2つの極に収束していく(下図)。

文章よりこちらのデモを見たほうがわかりやすいだろう。

これはいわゆる「エコーチェンバー」と呼ばれる現象だ。エコーチェンバーとは、自分の考えと一致する信念や意見にしか出会わないため、既存の見解が強化され、別の考えが考慮されない環境のことを指す。

印象的なのは、フォロー/アンフォローの仕方を、大手プラットフォームで採用されているようなレコメンデーション(推薦)の類似アルゴリズムにしたときだけでなく、ランダムに設定した場合でも、最終的なエコーチェンバーの成立は避けられないということだ。さらに外から何か影響を与えるようなファクターが入ってくると、この傾向は加速される可能性があるという。選挙のようなイベントやインフルエンサーのような「声の大きい人」による社会的影響は有力な要因だという。

近年のデジタルコンテンツの消費に関わる問題としては、エコーチェンバーと同時にフィルターバブルが指摘されている。「まずこのフィルターバブルもエコーチェンバーもアルゴリズム、特に推薦のアルゴリズムが関わっているのは間違いない」と笹原は語る。「つまりSNSがなければここまで高速にエコーチェンバー化しないというのが私の研究なので、SNSの技術が人々を非常に結びつけたり、特定の情報だけをフィルタリングしたりなどというところは効いているのは間違いないと思います」

「エコーチェンバーの場合は自分と興味関心が似た人とつながります。それがまた情報の伝搬経路になっているわけです。どんどん自分に合ったコンテンツだけが非常に高速に来るような環境ができているので、フェイクが混ざった時に、そこに例えばディレイを入れたり摩擦を入れるなど、何かスローにするような仕組みを入れていかないと解決にはならないのだと思うのです」

前述の論文は「ターン制の時間」でSNSをモデリングした。現実世界の時間はより激しいダイナミズムが生まれるのは想像に難くない。「バースト」といわれる現象では、「ある外のイベントをトリガーとして、2~3時間では起こり得ないような急激に何かムーブメントが立ち上がることがあります。それは良い時もあります。何か支援の輪が広がるようなことです。一方でゼレンスキー大統領のディープフェイクが出回って、一歩間違ったら皆、投降してしまうということもあるかもしれません」と笹原は言う。

インフルエンサーの存在は、SNSの問題を複雑化する側面があるようだ。大手アプリケーションで行われる新規フォローの推薦では、インフルエンサーが推されやすい。「レコメンデーションに従うと、自分と似た人とつながることを後押しするので、フォロワー数の分布をこのシミュレーションの世界でもやってみると、べき分布という対数軸上で尻尾が伸びるような分布になります」

「どんどんスケールフリー(次数分布のべき乗則)とかヘヴィーテイル(裾の重い分布)といわれるようなものが出てきてしまいます。そうすると、桁違いに多くの人に情報を伝えられたり、インフルエンサーと讃えられる人が出てくるということだから、それは一歩間違うと悪い情報が拡散する世界です」

その他に対して圧倒的にフォロワーを持つアクターの性質が悪いとすると、そういう人が非常にフォロワーを獲得してしまうのは好ましくない、と笹原は言う。「つながり過多、情報過多、これをうまく飼いならすことをしないと、『リテラシーを高めましょう』だけではもはやどうにもならない世界に突入しています」

最初にSNSが出てきた時は、とても良いことが起きているのだと思っていたし、たぶん計算社会科学の研究もそういう、ちょっとハッピーなものが多かったと思うのですけれども、ゲームが変わってきていないか、と私(吉田)は質問した。

変わった、と笹原は言う。「ちょうどSNSが出てきたのと、計算社会科学が出てきたのが同じ頃なのです。つまりSNSのデータが使えるようになったというのが一つの契機なのです」

「それまで社会科学は、望遠鏡や顕微鏡に相当するものがなかったのです。つまり人の行動を非常に詳細に時系列で、あるいは関係性まで追えるような装置がなかったので、社会科学は停滞していたのです。それに相当するものがSNSでした。社会科学が進んだのかもしれないけれども、いろいろ社会問題も進んでしまって、なおかつ使う人も偏りました」。

多様な考えの共存を意図したナッジ

笹原はこのような状況を回避するための「ナッジ」を提案している。それは、新たなつながりが作られる際にシステムがなければ出会えないような「意外なつながり」が生まれる確率を高めることだ。

笹原らが開発したSNSアプリケーション「Polyphony」では、多様な個人属性に基づき相性を計算し「相性がいいほど、心地いい音になる」というナッジが施されている。「本能やシステム1(※ノーベル経済学賞受賞のダニエル・カーネマンが提唱した思考形態。システム1は速い思考、システム2は遅い思考を指す)という直感をくすぐってあげて、ちょっとでもそういう人をフォローするのを後押しするシステムを作ってみたらどうかと考えました」

前述の研究ではフォロー/アンフォローがランダムに行われた場合でも、二極化が起きていた。つながりが異なる思想感の間で行われるよう「調整」を施すことがPoliphonyの含意であるようだ。当時、笹原が所属していた名古屋大学の大学院生に利用してもらい、その利用方法を観察した結果、興味深い結果が得られたという。

印象的だったのは、首里城が火事で燃えてしまったことについて、「美しい」と表現した人がこのSNS内にいたときの対応だったという。「これはTwitter上だとたぶんすぐ炎上してしまうと思うのですが、このSNSで炎上は起こらなくて『そういう見方もありますよね、でもあまりそういうことを書くべきじゃないですよね』というようなことを言っていました」。

今までこのシステムがなければつながらなかったような人がつながっているため、多様な人がいるという意識が有り、炎上に至らなかったケースだった、と笹原は表現する。

「できるだけ介入は弱い形で、それで自分が最終的に意思決定をするというところを残しつつ、技術をうまく活用することで、多様なつながりというものが常につくられては消え、つくられては消えするような状況をつくれたら、偏った意見に駆逐されないような土壌をつくることになります。それはエコーチェンバーを防ぎ、ゆくゆくはフェイクニュースの拡散などを抑えるような環境になるのではないかなと思っています」

「もう少しソーシャルメディアと長期にわたって良い関係性を築いていこうと思うのだったら多少の摩擦もなければいけないし、異なる声も聞かないといけないです…できればわれわれ研究者は、何とかなる部分は技術で何とかしたいと思うのです」

笹原和俊(ささはら・かずとし):2005年東京大学大学院総合文化研究科修了。博士(学術)。現在、東京工業大学環境・社会理工学院准教授。国立情報学研究所客員准教授。専門は計算社会科学。主著に『フェイクニュースを科学する 拡散するデマ、陰謀論、プロパガンダのしくみ』(化学同人)がある。

インタビュー書き起こし

以下はインタビューの書き起こし。読みやすくするため編集を加えている。以下のやり取りはポッドキャストで聴ける。

吉田:(研究では)その継続した時間じゃなくて離散的な的な時間というか、それでモデルを動かしていくと二極化する、セグリゲーション値が高くなってダイバーシティーが失われるというような内容だったと思うのですけれども、これを最初からお伺いできればと思います。

笹原准教授:分かりました。たぶん最初にこの動画を、これは音声なので伝わらないですけれども、僕は一応説明のために動画を使うと分かりやすいと思います。

この計算モデルはソーシャルメディア上で人々がつながっている、フォロー、フォロワー関係にあります。最初の状態はいろいろな人がいろいろな意見を持っているという状態を仮定します。それはここではリベラルからコンサバティブまでいろいろな人がいます。これは色で表しているのですけれども、いろいろな意見があっていろいろな人がつながっているという状況を仮定しています。

その状況から普段、われわれがSNSでやっていることを、このコンピューターシミュレーション上の、「エージェント」と呼んでいるのですけれども、こういうエージェントにやらせてみます。それを繰り返しやっていくと、一体、ネットワーク全体としてはどのようなことが、どのような性質が創発するのかということを見ようということです。

それで見てもらうと、まずこちらの右上の図、これは自分がつながっている友人の意見の多様性がどう変わっていくかというものを、これは時間で見ているのですけれども、どんどん単調減少していくのです。どういうことでこうなっているかというと、自分と似た意見を持つ人からは影響を受けます。それで自分の意見をちょっと変えます。その代わり自分と似ていない意見を言う人はアンフォローしてしまいます。その代わりまた別の人をフォローするということを繰り返しやっていくのです。

そうすると最初はいろいろな意見があったのだけれども、だんだん青い意見は青い意見によりなっていって、赤い意見はより赤い意見になっていきます。それだけではなくて、この2つのグループが最初は一様に混ざっていたにもかかわらず、だんだん2つに分かれていって、最終的にはこれが赤グループと青グループに分断されてしまうということが起こってしまいます。ということがたった3つのパラメータをセットすると、こういう現象が必ず起きてしまうということをこの研究で示したのです。

吉田:自分が好まない意見をアンフォローするというようなことが仮定として入っているわけですね。

笹原准教授:そうです。

吉田:確か、ランダムにユーザーを選んで、リツイートやリポストをその人に見せるのですね。

笹原准教授:ランダムに選んでフォローするということです。

吉田:はい。

笹原准教授:そうです。そのフォローの仕方はこのシミュレーション上では変えられるので、今、このデモで見せているのは仮にアンフォローする人は自分とは意見が違う人だとしても、次につながるのは誰でもいいのです。ランダムに誰かを選ぶというのが一番、選択肢としてはあまりよろしくないですけれどもあり得る選択だし、あるいはSNSが「こういう人もいますよ」というリコメンデーションの機能を持っているので、それに従うというのも一つの手だし、自分がソーシャルメディアのスクリーン上、タイムライン上で、この人は面白そうと思ってフォローするのもありなのですが、どれを選んでもこれになってしまうのです。

吉田:なるほど。

笹原准教授:どうフォローしても、嫌いな人はアンフォローするというファクターが入っていると必ずこうなってしまうのです。

吉田:なるほど。それがランダムであろうと。

笹原准教授:そうです。そうなのです。

吉田:はい。

笹原准教授:むしろ、リコメンデーションなどに従うと、そのリコメンデーションのアルゴリズムというのは自分に似た人とか、自分と似たようなフォロワー関係を持つ人を推薦してくるから、より強烈に、あるいはより高速にエコーチェンバー化してしまうということが起こってしまうのです。

吉田:なるほど。フォローに関してレコメンデーションが絡めば、ますますそれは加速するということですよね。

笹原准教授:そうです。それを示したのはこの図なのですけれども、これは横軸が、どのぐらい他者から影響を受けるかという強さを表していて、先ほどのシミュレーションのパラメータの一つですけれども、こちらの軸がどのぐらいの頻度でフォロー、アンフォローを繰り返すかという頻度です。それがLog(対数)とLogで描かれているのです。

そうするとどういう設定でシミュレーションがスタートするかというのがこの図で、色の強さが、どのぐらいの速さでエコーチェンバーになってしまうかという、明るければ明るいほど、あっという間にエコーチェンバーになるし、逆に暗いとあまり……エコーチェンバーになるのにすごく時間がかかるか、もしくはなりません。ではSNSがある世界はどこかというと、他者が見えてしまうので、他者からすごく影響を受けますよね。

吉田:そうですね。

笹原准教授:こういう世界ですよね。

吉田:はい。

笹原准教授:どのぐらいフォロー、アンフォローを繰り返すかというと、対面のコミュニケーションよりははるかに頻繁にフォロー、アンフォローを繰り返していますよね。この辺の世界なのです。

吉田:はい。

笹原准教授:そのため、SNSがないこういう世界に比べると、SNSがある世界のほうが、はるかに高速にエコーチェンバー化してしまうということを、先ほどのシミュレーションをシステマチックにやると分かるのです。SNSがあろうがなかろうが、もちろん分断は起こり得るわけです。現実世界でもそういうことは実際にあります。

吉田:そうですね。

笹原准教授:ただ、SNSがあることで、それがより高速に起こってしまうというのがこの研究が示したことなのです。

吉田:なるほど。これは怖いですね。例えば選挙などそういう、もう一つ外的な要因が加わるとたぶんこれがさらに……。

笹原准教授:そうですね。これは非常にシンプルなセッティングだけれども、さらに外から何か影響を与えるようなファクターが入ってくると、非常にこれは加速される可能性があります。

吉田:そうですよね。インタラクションは絶対に上がりますね。

笹原准教授:はい。そうですね。

吉田:フォロー、アンフォローの速度も上がっていきます。

笹原准教授:恐らくここも変わります。社会的影響、つまり……

吉田:そうですね。

笹原准教授:声の大きい人、インフルエンサーの影響をもっと受けます。

吉田:はい。そうですね。

笹原准教授:そういう影響を受けると、自分の身の回りの人も影響を受けます。自分の近しい人がそういう影響を受けると自分もさらに影響を受けるということになるので、そういう何かイベントがある時、実際、今の戦争の状況もそうですよね、ものすごく影響を受けやすくてエコーチェンバー化しやすいということになります。

吉田:なるほど。怖いですね。そうですね。たぶんある意味シンプルなモデルでこれくらい分かるということなのですね。

笹原准教授:そうですね。

吉田:ちょっと驚いたなというところです。なるほど、そうですね。これがその論文の話ですか。これは、生データを使って実証するみたいな研究は、Twitterさんのデータなどを使って、たぶんアメリカなどはされてはいますよね。

笹原准教授:はい。あります。

吉田:そういうふうに実証的にたぶんやってみても、似たような結果は出ているのでしょうか。

笹原准教授:私の論文でも、この基本的なメカニズムを動かしていくと、Twitterの時系列的な変化、どのぐらい人々の意見が偏るかというマクロな特徴量を捉えることができるので、ある程度、このモデルでもそれをキャプチャーしているのです。ある大統領選があったとして、お互いの対立のディベートがある時に、どのぐらいリアルタイムの対立の状況と、Twitterのこの意見の偏りが一致するかなどということを示した論文もあります。そのため、そういうTwitterのデータはある種のプロキシとして、代替データとして使って、こういう基礎メカニズムでそれが説明できるかというような研究はたくさんあります。

吉田:ノードの意見が変わったということの判定はすごく難しい問題になる気がするのです。

笹原准教授:それは難しいです。はい。

吉田:そこをどうお考えでしょうか。

笹原准教授:実データでそれを示そうと思うと、例えばあるノード、そのユーザーが日々つぶやいている内容も全部データを取っておいて、どのぐらい、言っている内容やトーン、あるいは感情というものがコンシステントかということです。あるいは話題というものを調べて、大きな変化がなければこのノードは意見を変えていないという言い方もできるし、逆に言うと、変わることもありますよね。政治の場合はリベラルが保守になるということはあまりないのかもしれないですけれども、例えばこの手の問題がやはり悪影響を及ぼしているのがワクチンの陰謀論などです。

ワクチンを打つかどうか迷っている人もいます。そういう人に対して働き掛けて、「ワクチンなんか、これは不妊になるから危ないのですよ」などという間違った情報を伝えて怖がらせてワクチンを打たなくするというような、意見を変えさせることもあります。そういった時に、どういうふうにそういうニュートラルな人たちを守るかというようなことは、こういうモデルを動かしていると分かってきます。

吉田:細かくなるのですが、いろいろな可能性があると思っています。一つは偽装しているケースがままあるかなと思っています。この前のヒラリー、トランプの選挙の時も、ヒラリーが勝つというポール(調査)が出ていました。

笹原准教授:そうですね。

吉田:たぶん恐らく、内心ではトランプ支持だったというようなこともあるので、その辺りというのは計算社会科学でどう見ますか。

笹原准教授:はい。それはまず調査がだんだん……調査というのは、こちらから質問して答えてもらいます。本当はその選択肢の中に自分の意見がないとしても答えてしまう場合があるので、そういう意味で解の正確さというのが問題視されている場合があります。そのため、その代替値でソーシャルメディアだと生の声が聞こえるから、より現実に近いのではないかと思って、われわれのような計算社会科学者はソーシャルで分析するのです。

1個問題になっているのは、最近だと、ソーシャルメディアで自分の意見を発信するというよりは、自分は聞く側に回ってあまりそういう意見を表明しないサイレントマジョリティーが非常に多いです。そのため、本当はそこを分析に加えないと、一部の偏った人たちの意見だけを分析してしまっている、見てしまっていることになると思うのです。それは全然正確な予測にはならないわけです。ただサイレントマジョリティーはソーシャルメディアでは声を発しないので捉えることもできないのです。そこは難しい問題です。

吉田:そうですね。どこまでプライバシーに踏み込むかというものでもあります。

笹原准教授:そうなのです。ええ。

吉田:はい。そうですよね。データを取得するかというところもたぶん一つの課題だと思っています。Twitterさんは比較的鷹揚なのでしょうか。

笹原准教授:そうですね。

吉田:それに対して、たぶんFacebookさんはそうじゃないような印象を私は勝手に思うのです。

笹原准教授:そうですね。まだ現段階だと取る方法はあります。

吉田:そうですか。

笹原准教授:アカデミアの人に対してはCrowdTangleというAPIを、申請すると認めているのです。それは返信などは取れないのですけれども、パブリックな投稿は取ることができて、われわれもその投稿を使った分析などをしているので、一応取ることはできます。

ただおっしゃるとおり、Facebookはあまりそういうことに協力的ではなくて、最初はCrowdTangleを作ったのだけれども、今はそれを閉じようとしています。その代わりに何かアカデミアには別の方法でデータを提供するからということをちょっとやり始めています。あまりこういう、学術研究に協力しようということに消極的な感じは私も受けます。

吉田:中にたぶん、計算社会科学者さんをたくさん抱えられていると思うのです。そこの方々がどういう分析をしたかというのも、いまひとつ全部出てきていないような印象を私は持っています。

笹原准教授:そうですね。以前に比べると、それでもだいぶんデータは活用できるようになってきました。ソーシャルメディアのデータは決して世間の代表的なデータではないのだけれども、でも問題が起こっているのはソーシャルメディア上であることは間違いないので、そういう意味ではこういったデータを分析することは大事ですし、それを論文化して公開するということは大事です。僕がこういう研究を始めた10年くらい前に比べると、だいぶんましになったというふうに思います。

吉田:なるほど。はい。恐らくちょっと偏ったデータなのかもしれないけれども、われわれが経験している現実と近似している感じは非常にあります。

笹原准教授:そうですね。ありますし、問題が起こっている、まさにその現場なので、これを分析しないと対策もやはり打てないのです。エビデンスをきちんとしておくのは重要です。

吉田:そうですね。はい。今回の研究に基づくと、ある程度二極化する傾向があるということは、それ(情報)が事実であるかないかということに対して、あまり気に留めてないのではないかという印象を受けたのです。

笹原准教授:皆さんがということですか。

吉田:そうですね。はい。

笹原准教授:そうですね。こういう理論的なことが分かったとして、どういうふうにではこれを、社会を良くしていくのに生かすかということなのですけれども、確かに周りの人はそんなに気にしないというのはあるかもしれないですね。

それからエコーチェンバーって、自分は本当はそこに入ってしまっているのだけれども、なかなかそれを鳥瞰(ちょうかん)、俯瞰(ふかん)できないので、自分がいかに偏った情報環境にいるかというのは見えないですよね。そのため、自分から何とかしようということは思わないし、自分に合った情報が来ているのだからそれでいいではないかという考え方も一方ではあります。けれどもそういう偏った情報にばかり触れるのって良いことでしたっけということは、立ち止まって考えないといけないです。

そこに見ている情報というのは、もしかしたら非常に自分の価値観と合致しているかもしれないけれども、逆に言うと気付きが少ない、驚きがない、発見がないなどという、そういう、もう死んでしまった世界かもしれないです。それはもうイノベーションも起こらないし、新しいアイデアも出てこないということなのです。

もう少しソーシャルメディアと長期にわたって良い関係性を築いていこうと思うのだったら多少の摩擦もなければいけないし、異なる声も聞かないといけないです。ということは、自分でそういうことを心掛けられれば一番良いのですが、できればわれわれ研究者は、何とかなる部分は技術で何とかしたいと思うのです。

吉田:何とかしようという部分の一つが、たぶんナッジだと思うのですけれども、これを教えていただいてもよろしいですか。

笹原准教授:はい。そうですね。これも、自分がどういうふうにナッジを使ったか……同じ人とばかりつながって多様性がどんどん失われてしまう、これはエコーチェンバーの一番問題なところです。だとするとその逆をしようということです。多様な人とできるだけつながりたくなるようなSNSをつくろうと思って、これは完全に実験的な、コンセプチュアルな段階なのですけれども、こういうことをしました。

アルゴリズムが、この人とこの人はある部分は似ているのだけれども、ある部分は違いますよねというようなものを見つけます。それで、そういうある種の望ましい……望ましいと言うとすごく上から俯瞰的に…嫌な感じもするが、でもちょっと面白いかもしれませんよというつながりを、いい音でナッジするということにしたのです。

普通ならば、この人をフォローしたらこんな人もいますというように、ユーザーをリコメンデーションするわけです。そのリコメンデーションって、大体フォローのパターンから計算されることが多いのですけれども、そうではなくて、誰をフォローしているかはともかく、どこかは似ている、でもどこかは違うという人が一番良い音が鳴るようにナッジをします。

吉田:なるほど。

笹原准教授:だからそのユーザーをクリックすると何か非常に、分からないけれども良い音がします。良い音がするということは、ひょっとしたら良い人かもしれないし面白い人かもしれないという、本能やSystem1という直感をくすぐってあげて、ちょっとでもそういう人をフォローするというところを後押しするなどということをすると。、ちょっとだけ余計なお世話をするシステムを作ってみたらどうかということを考えたのです。

まだ効果検証まで厳密なことができているわけではないのですけれども、大学院生にまず使ってもらって、そこで起きたことをいろいろとオブザーベーションしたわけです。いろいろな面白いことが起こって、これは名古屋大学に私がいた時にやったのですけれども、名古屋大学のいろいろな部局の大学院生が使ってくれてます。そこで推薦、紹介のアルゴリズムでつながるわけです。そうするとお互い大学院生が夜な夜な作業というか研究をしていて、励まし合います。

あるいは、その私が作ったSNSはPolyphonyというのですが、多様な声という意味です。投稿は文字でできるのですが、それをAmazonのPollyという人工知能を使って音声に変換して、声を聞くことができるのです。合成音声ですけれども、自分が投稿した内容が音声で聞こえます。

ある時、これは作った私もよく分からなかったのだけれども、絵文字がどうも発音されるらしいということに気付いたユーザーがいて、そこで絵文字を投稿し合うカルチャーというものが勝手に創発しました。

吉田:面白いですね。

笹原准教授:そうなのです。それで、全然普段なら会わないような、違う部局に、違う学部にいるような人たちがそこでわーっと集まって、サブカルというかちょっとした文化がそこで生まれました。そういう、絵文字を使った大喜利みたいなものがブームとして起こるというようなことを見ました。

あるいは、印象的だったのは、首里城が火事で燃えてしまったことがあったと思うのですが、あれを「美しい」と表現した人がこのSNS内にいたのです。これはTwitter上だとたぶんすぐ炎上してしまうと思うのですが、このSNSで炎上は起こらなくて、そういう見方もありますよね、でもあまりそういうことを書くべきじゃないですよねというようなことを言っていました。

笹原准教授:それで自然に鎮火していくというようなことがありました。それはでも多様な人がいるな、まさに今までこのシステムがなければつながらなかったような人がつながっているので、このような人もいるのかというような、そういう意識があるから炎上に至らなかったのかなというようなケースがありました。

一時期ではあったのですが、そういうことはナッジでも作ることは可能なので、これが唯一の方法とは思わないのですけれども、できるだけ介入は弱い形で、それで自分が最終的に意思決定をするというところを残しつつ、そういう技術をうまく活用することで、多様なつながりというものが常につくられては消え、つくられては消えするような状況をつくれたら、偏った意見に駆逐されないような土壌をつくることになります。そのため、それはエコーチェンバーを防ぎ、ゆくゆくはフェイクニュースの拡散などを抑えるような環境になるのではないかなと思っています。

吉田:最初の、紹介いただいた論文で、つまりフォロー、アンフォローの関係がランダムでもまずいことになるから、そういう……

笹原准教授:そうなのです。そうです。ちょっと音で面白い人とつながってみよう、ちょっと違う人とつながってみようというところに、ちょっとだけシステムを方向付けてあげるということをするといいんじゃないか、ただそれは介入であることは間違いないので、それを良しとするか悪しあしとするかはユーザーの……。

吉田:小規模でやっている分には本当に素晴らしいという感じになると思います。

笹原准教授:ええ。ですけれども。

吉田:そう、大規模にした時に……

笹原准教授:それはおっしゃるとおりです。

吉田:そうなのです。試してみたいというのはあります。

笹原准教授:おっしゃるとおりです。これは大学、特に名古屋大学という閉じていた、まあ、閉じたわけではないのですが、他の人も入れたのですが、主にはその人たちが使っていたので、そこまで大きなことは起こらなかったのですけれども、これをリアルワールドにぽんと放り投げた時に、では本当にどうかというのはちょっと怖いというか、難しいです。

あとはナッジの性質として、ナッジってショートピリオドだと効果を発揮するのですが、だんだん皆、飽きていくのです。

吉田:なるほど。

笹原准教授:人間ってハビチュエーションする生き物なので、その時に、ではこの音で方向付けるというアイデアだけでいいのかというと、たぶん飽きてくるのです。だから多段階でそういうものが設計されていて、使ってはそういうものを発見し、使ってはそういうものを発見しということが行われているようなSNSだといいのかなと思います。

吉田:面白いですね。アプリのプロダクトマネジメントやゲームプランニングのような話ですね。それこそ今のゲームって、常にメンテナンスが入って、リニューアルが入って新しいものが付いていって、ある種のナッジが繰り返されていくと思うのです。ゲームの中でチートする人がいたら、そのチートの可能性を抑えて良いようにしたり、そういうものとの共通性を感じました。

笹原准教授:そうですね。だからオープンエンデッドというところが非常に大事なのだけれども、あるところはナッジだったり、そのシステム設計・制度精度だったりで、あまり極端なほうに走らないようにきちんと敷居はあるというようなところで、でもできるだけオープンエンドに、ユーザーの自由度が高まるような仕組みがあると良いかなと思います。

吉田:分かりました。非常に、私も作る側なので…。

笹原准教授:そうですよね。作る側としてはそこをやはり意識します。

吉田:そうですね。いや、意外に思い付かないアイデアです。そういうふうにある種、報酬付けるわけですね。

笹原准教授:そうですね。報酬付ける、そういうことです。

吉田:いや、面白いなと思いました。先ほどの論文で触れられなかったのですけれども、偽情報のほうですね。先ほどはどちらかというと二極化の話でした。偽情報って、その威力というか、どういうふうに考えていますか。

笹原准教授:エコーチェンバー化した環境ですよね。

吉田:そうですね。

笹原准教授:エコーチェンバー化した環境が偽情報というものに対して悪いのは、要するに二極化するわけです、それで片方にとっての真実というのは片方にとってはフェイクになってしまいます。

その構造があると、片方はその情報を良しと思っているので止まりません。一方は、これは間違っていると思って、「それはフェイクですよ、間違っていますよ」と言うのだけれども、そちらの意見はもう完全にシャットアウトという構造ができてしまっているので、環境として訂正情報が届きにくい、間違いが訂正されづらいということになっています。それがフェイクニュースの拡散という意味では悪影響を及ぼすというふうに思っているわけです。

吉田:悪意の人がいた場合、エコーをかけやすい。

笹原准教授:そうですね。それが外から見えてしまっていると、いくらでもマニピュレートできてしまいます。最近だと別に、人間がそれをやらなくても、AIやボットといわれるような存在がいて、ちょっとずつ思考誘導するというようなことができてしまいます。

吉田:はい。そうですね。人間の心というようなものをある程度モデル化して、取りあえずそれを見てマニピュレートできるというようなものですね。

笹原准教授:そうなのです。実際そういうことをやられていて、『Nature』だったか『Science』だったかに載った論文で示された、それはワクチン、反ワクチンのFacebook上の動きを分析したものなのです。反ワクチンのクラスターの人たちってすごくしたたかで、反ワクチンとは関係ないサイトだったり団体のようなものを架空に立ち上げておいて、そこにいったんユーザーを引き付けておいて、ちょっとずつ自分たちの主張を浸透させていくということをやっています。

吉田:すごいですね。

笹原准教授:ネットワーク分析をするとはるかに、そういうニュートラルな、まだどちらかが、ワクチンでいいのかな、悪いのかなと不安に思っている人たちが情報を得ようと思って活動するわけです。その人たちに積極的に働き掛けるのは反ワクチンの人たちで、むしろプロワクチンたち、ワクチンは大事ですよと言っている人たちは、正論は言っているのだけれども、まったくアトラクティブではないのです。まあ、正論だからこそつまらないというのはあるのかもしれないですけれども、あくまで……そもそもマーケティングに失敗しているのです。

吉田:巧妙ですよね。

笹原准教授:巧妙なのです。その論文の予測によると、何も今手を打たないと反ワクチンがプロワクチンを打ち負かすという、数で、そういう世界が来てしまいますよという予測をしているのです。

吉田:怖いですね。

笹原准教授:オンライン上、そういう思想誘導のようなことが今はできてしまうわけです。今はターゲティングできてしまいますから。

吉田:はい。そうですね。たぶん全てが分かっていないですが、ケンブリッジ・アナリティカ事件などもその種のゲームだと思います。

笹原准教授:そうですね。それの非常に初歩的なものですよね。あれは本当にlikeとFacebookのコンテンツの関係性だけから、その人の趣味嗜好のようなものが分かるという話です。今はもっと分析のレベルが進んでいるので、あれはたぶん、こういう人たちというグループ単位や、ある種の共通する人をくくるということだと思うのですけれども、今は本当にピンポイントでこの人ってできてしまいます。

吉田:そうですね。はい。

笹原准教授:時間や位置情報、過去にこれを買ったというようなものがあるともう、ピンポイントでこの人ってできてしまいます。

吉田:そうですね。

笹原准教授:その人に意見を変えさせると、全体がガラッと変わってしまうというようなことができてしまうわけです。

吉田:そうですね。たぶん過去の購買履歴などは事件が発覚してから使えなくはなってはいるけれども、いまだにFacebook……名指しになってしまいますが、Facebookの広告のターゲティング精度というのは異様に高いものなのでターゲットになりやすいです。ターゲットしやすいですね。

笹原准教授:そうですよね。

吉田:そういうことができるというのは間違いないと思います。今の話の関連で、最後の質問のほうから先に行こうと思います。このCREST FakeMediaのところに関してお伺いしてもよろしいでしょうか。

笹原准教授:はい。このプロジェクトはフェイクニュースのさらに先というか、フェイクメディアです。単に文字情報だけ、ニュースだけではなくて、ディープフェイクに代表されるような、本当に人間が見分けが付かないようなリアリスティックな、しかし偽の動画、画像です。

こういったものが非常に大量に流通するようになったような世界、「インフォデミック」という言葉で呼びますけれども、そういう世界になった時に何か対抗するすべがないと、正しい意思決定ができない、行動できないわけなので、先回りしてまずそういうものを作る技術を開発しましょうということです。作ることで理解します。攻撃者側がどのようなふうに作るのかということを先回りしておこうということです。

それからもちろんそういうものを検出する技術です。検出する技術を作って、それが誰でも簡単に使えるようにして、今のSNSに搭載されるなり、何か別の新しいソーシャルシステムに搭載されるなりというところを目指します。

それから今目にしているメディア、画像なり映像なりニュースなりが、正しいかどうかということを保証するような仕組みを作りましょう。これが3つ目です。

4つ目が、これは私が主に関わっている部分ですけれども、そういった技術を、ではどういうふうにソーシャルメディアに生かしていくかということです。技術ができたからといって、それイコールすぐにそういうフェイクメディアを駆逐できるということではなくて、どのタイミングで使うか、どのような情報をユーザーに提示するか、さらにメディアリテラシーを高めるためにはそういう技術がどのようなものが使えるかということです。いろいろなレベルの使い方があると思うので、そこを研究しているのがわれわれのグループということになります。

吉田:ゲームがAIバーサスAIというか、ソフトウエアvs.ソフトウエアのような感じにたぶんなっています。昔は人がマニピュレートしていた部分も大きかったと思いますが、今はちょっと変わってきたという側面が、たぶんこのプロジェクトにあるかと思います。

笹原准教授:はい。それもあります。つまり、今、AIをトレーニングするのに大量のWebの情報が必要なわけなのですけれども、それは悪意を持って何かコードが混入したり、AIが誤動作するように仕組まれていたりなどということもできてしまうわけです。

このプロジェクトはそこも無毒化という概念を掲げているのですけれども、そういうAIが学習するのに使うのに無害なデータを作りましょうというところも今、技術的な試みとしてやっているところです。それはNIIの越前先生という方が主に研究されている分野です。

吉田:はい。攻撃の仕方というと本当にたくさんあると思っています。たぶん最近だと文章生成が特にTwitterなどでは有効なのかなと思うのです。これの攻撃にさらされた時にどう守るべきかについて、ちょっと専門ではないと思いますが、考えはいかがですか。

笹原准教授:つまりAIが作った文章などが大量に来た時に、人がどういうふうに考えればよいかということですね。

吉田:そうですね。もうちょっと条件を加えると、最初の論文にあったような、エコーチェンバーがあるような状況下において、AIを使って攻撃しようとしている人たちがいて、その攻撃手法の一つが……

笹原准教授:そういったフェイクの文章ということですね。

吉田:はい、フェイク文章です。

笹原准教授:一番フェイクかどうか見破るのに重要なのはソースを確認するということなので、そのコンテンツがどこから来たかを見抜く技術が必要だし、そういった悪意を持って攻撃を仕掛ける人って、たぶん単体ではやってなくて、恐らく複数のアカウントでボットクラスターとかボットネットという言い方をしますけれども、ネットワーク的にやっていると思うのです。そのため、そういうものを検知するというのは大事です。

地道にはもちろん、そのニュースのコンテンツがどうか、正しいかどうかということを判定するようなAIも今、作られてはいます。例えばWikipediaのデータで世界知識を学習して、それからのずれがあるかどうかを検知するなど、いろいろなやり方はあるのですけれども、そういった技術を入れていくなどです。

吉田:分かりました。最近、画像生成のほうも非常に評判が良いです。

笹原准教授:画像生成は今、ものすごい勢いですよね。

吉田:はい。分かりました。では、これは私の興味も大きい部分がある質問なのですけれども、フィルターバブル、エコーチェンバーと推薦システムですか。ソーシャルメディア、YouTubeなど本当にいろいろなものにたぶん使われていますけれども、これはどうお考えですか。このフェイクニュースの流通において、たぶんなかなかのウエートを占めている印象はあるのです。

笹原准教授:そうですね。まずこのフィルターバブルもエコーチェンバーもアルゴリズム、特に推薦のアルゴリズムが関わっているのは間違いないです。つまりSNSがなければここまで高速にエコーチェンバー化しないというのが私の研究なので、SNSが、その技術が人々を非常に結びつけたり、特定の情報だけをフィルタリングしたりなどというところは効いているというのは間違いないと思うのです。

そういうソーシャルメディアやそういったアルゴリズムに下支えされたコミュニケーションって、これからもずっととっていかなくてはいけないので、そのポジティブフィードバックのどこをつぶせばブレーキがかかるかということは考えておかないといけないです。

今、どんどん、ポジティブフィードバックが回る方向にしか行っていないです。過去にどういう履歴を残したかを知れば、この人が好みそうなコンテンツが分かるから、その情報だけをろ過させるというのがフィルターバブルです。

エコーチェンバーの場合は自分と興味関心が似た人とつながります。この人がシェアしてもらって来るわけだから、それがまた情報の伝搬経路になっているわけです。そのため、どんどんそういう、自分に合ったコンテンツだけが非常に高速に来るような環境ができているのでその時に、フェイクが混ざった時に、そこに例えばディレイを入れたり摩擦を入れるなど、何かスローにするような仕組みを入れていかないと解決にはならないのだと思うのです。ただそこには表現の自由などいろいろな問題が関わってくるので、技術だけでどうにかなる問題ではないのは言うまでもないことです。

吉田:そうですね。最初の論文だと、時間を区切ってやっているわけじゃないですか。でもリアルワールドではたぶん……

笹原准教授:面倒ですね。

吉田:この継続的な時間の中でやっているので、もっとある種の速度が、たぶん違うわけですね。

笹原准教授:そうですね。

吉田:とんでもないダイナミズムがあるのでしょうね。

笹原准教授:おっしゃるとおりです。バーストといわれる現象がまさにそれです。ある外のイベントをトリガーとして、2~3時間では起こり得ないような急激に何かムーブメントが立ち上がるということがあります。

それは良い時もあります。プロソーシャルな何か支援の輪が広がるなど、そういうふうになるのはいいのだけれども、一方でゼレンスキーのディープフェイクが出回って、もしかしたら、一歩間違ったら皆、投降してしまうということもあるかもしれません。

そのようなことも加速させてしまうような世界なので、そこにある種の真贋(しんがん)をラベル付け、これは正しい……イチゼロではないにしろ、このぐらいの確率でもしかしたら改ざんされていますとアラートするなど、そういうものはシステムの側でちょっとディレイを入れて、速度を遅めるなど、何かそういうことがないと、あまりにも大量なので、人間ではもはや処理できなくて、リテラシーうんぬんではない世界に入ってしまっています。

吉田:はい、そうですね。量が増えると認知が追い付かないという研究はたくさんあると思います。

笹原准教授:そうです。追い付かないです。

吉田:そうですね。そのパーセンテージを示すというのは非常に良いアイデアだなと思いました。商業的な観点から言うと、もうからなくなるから、たぶん、プロダクトマネジャーをすぐ蹴飛ばすアイデアだと思うのです。つまりタイムラインに流れていくような情報の、これが78%改ざんされている可能性があると出ると、たぶんエンゲージメントが落ちて、このアプリを使うのはやめようということになります。

笹原准教授:そうですね。

吉田:何としてでも、うそだろうが何だろうが見せないといけないというところが、たぶんどことなくあるかなと思うのです。

笹原准教授:そういうシステムを作ろうとして、われわれのCRESTもそういうものを作ろうとしていて、越前先生の研究ですが、今、取り組んでいるところですけれども、一部でき始めている部分もあります。顔映像に関して、これが改ざんされたものかどうかということを判定するWeb APIを開発されて、今、いろいろな企業などに声を掛けているような段階だということは聞いています。

吉田:はい。そういうコンテンツプロバイダーというか。

笹原准教授:はい、そうですね。これはやはり企業にとっては深刻な問題ですよね。

吉田:なるほど、そうですね。推薦システムの話をしていたのだと思うのですが、推薦システムが絡まない最初の論文の推定だけで、あれだけの二極が起きるということは、コンテンツの取得のところにそれが噛むとたぶん何かが起きている可能性がありますか。

笹原准教授:はい。エコーチェンバーが起こるか起こらないかに関しては、そのリコメンデーションであろうが、ランダムにフォローしようが関係なかったのですが、1個だけ非常に関係するものがあります。それは何かと言うと、インフルエンサーが出るのです。リコメンデーションに従うと、自分と似た人とつながることを後押しするので、フォロワー数の分布をこのシミュレーションの世界上でもやってみると、非常にこういう、いわゆるべき分布という、対数軸上で尻尾が伸びるような分布になるのです。

吉田:はい。ロングテールですね。

笹原准教授:それがリコメンデーションがない世界だともっと緩やかなのですけれども、リコメンデーションがあるとそちらに引っ張られるので、どんどんスケールフリーとかヘビーテールといわれるようなものが出てきてしまいます。そうすると、ヘビーテールということは、桁違いに多くの人に情報を伝えられたり、インフルエンサーとたたえられる人が出てくるということだから、それは一歩間違うと悪い拡散する世界ですよね。

吉田:はい、なるほど。ネットワークとして……

笹原准教授:ネットワークとして、そうです。

吉田:これは考え方によりますけれども、ヘルシーではない可能性が出てきますね。

笹原准教授:そのアクターがワルだとするとそうです。

吉田:はい。

笹原准教授:良いアクターだともちろんそうではないですけれども。そのノードの性質が、アクターが悪い人だとすると、そういう人が非常にフォロワーを獲得してしまうようなものが自動的に出てくるのはよろしくないです。

吉田:はい。そうですね。往々にして、あまり良くないこともありますね。

笹原准教授:はい。人がつながり過ぎると良くないことが起こるのは、それはそうですよね。そのため、つながり過多、情報過多、これをうまく飼いならすことをしないと、『リテラシーを高めましょう』だけではもはやどうにもならない世界に突入しています。

吉田:最初にSNSが出てきた時は、とても良いことが起きているのだと思っていましたし、たぶん計算社会科学の研究もそういう、ちょっとハッピーなものが多かったと思うのですけれども、ゲームが変わってきていますね。

笹原准教授:変わっています。そうですね。ちょうどSNSが出てきたのと、計算社会科学が出てきたのが同じ頃なのです。つまりSNSのデータが使えるようになったというのが一つの契機なのです。

つまりこれまで社会科学は、望遠鏡や顕微鏡に相当するものがなかったのです。つまり人の行動を非常に詳細に時系列で、あるいは関係性まで追えるような装置がなかったので、社会科学は停滞していたのです。それに相当するものがSNSなので、このデータが分析できれば、非常に社会科学が進むと思ったら、まあ、社会科学が進んだのかもしれないけれども、いろいろ社会問題も進んでしまって、なおかつ使う人も偏りましたよね。

吉田:そうなのですよね。

笹原准教授:昔はFacebookやTwitterぐらいしかなかったので、皆がそれを使っていたから、ある意味代表性の問題もカバーされている部分もあったのだけれども、今や若者はもうInstagram、TikTokです。日本だと高齢者というか、結構年配の人だけはFacebookを使って、若者はむしろ扱わない、敬遠しています。まあTwitterはまあまあというような、そういうところです。だからプラットフォームでかなり分断されてしまっています。

吉田:そうですね。最初に扱っていたのはもっと社会を知ろうという感じだったのですけれども、だんだんセキュリティ問題に本当に寄ってきたかなと思います。

笹原准教授:そうですね。なってきました。

吉田:私もこの起業をする前に、それこそ2016年のアメリカの選挙など、ブレグジットなどもあって、たぶん非常にそこは契機なのかなと思っています。だんだんセキュリティの話題になったような印象があるのです。

笹原准教授:そうですよね。

吉田:そうなのですよね。ごめんなさい。では最後にちょっと、ある種の面白質問を入れさせていただきたいのですが。イーロン・マスクさんがTwitterを買ったじゃないですか。彼にどういうプロダクトマネジメントしてほしいかというようなことを知りたいです。

笹原准教授:今はまだちょっと、暗礁に乗り上げている感じですね。だからどうなるか分からないです。

吉田:まだ決まるかどうか分からないですけれども。はい。

笹原准教授:そうですね。イーロン・マスクの話題だと、一つ、ちょっと小ネタコメント的なものは、ボットかどうかを判定するアルゴリズムをイーロン・マスクにかけたら、最初、ボットと出たのです。

それは後で、それは私の共同研究者が作っているBotometerというツールでやったのですけれども、後で分かったのは、Twitterのバグできちんとデータが取れていなかったかららしいのですけれども。

Twitterは非常にうまく活用しているわけなのですけれども、一部の人が非常にインフルエンスを発揮できるようなツールにはなってしまっているし、エコシステムとして考えた時に、非常に病的なものが混ざりやすかったり、一部の声だけが非常に可視化されてしまったりなどがあります。

特に顕著にコロナ禍で見えたのは、「トイレットペーパーがなくなります」もそうなのですけれども、フェイクニュース自体はそれほど拡散していないのに、Twitterのアルゴリズムが「こういうものが話題になっています」というふうに可視化したがために、今度はマスコミがそこに飛び付いて、それで事がむしろ複雑になってしまいます。本当にトイレットペーパーがなくなってしまったというようなことがあります。

そういったニュースのソーティングだったり、どういうふうに見せるべきか、本当は取り上げほしいものが取り上げられなくて、取り上げなくていいものが取り上げられてしまったりということがあるので、そういったもののコンテンツのモデレーションというようなものは、もう少しうまくやってほしいなと思います。もし何かあった時に拡散を止められるようなブレーキが欲しいです。

吉田:そうですね。

笹原准教授:Twitterに何がないかと言うと、ブレーキがないのです。普通、車を売るためには非常に、衝突実験を何回もして安全性というものを確かめてから売るじゃないですか。でもSNSってそういう安全性をきちんと確認しないまま出している感じがあります。

これはスマイリーキクチさんがよく講演でおっしゃったことなのですけれども、書き込みがあって、突然ある1人が悪者にされてしまうということはもう容易にできてしまうではないですか。そういう安全性を確保するような何かブレーキというものがTwitterには欲しいなと思います。

吉田:分かりました。そうですね。マスメディアとSNSってたぶん別であるほうが、社会が堅牢(けんろう)だと思うのですが、今は協調してしまっているといいますか。マスメディア側もどうやって……言葉は悪いですけれども、うまくSNSを使うとバズが取れてアテンションが取れるというような、そういう……

笹原准教授:そうですね。ダイナミズムが全部アテンションエコノミーで、そこにお金も全部引っ付いて回っているというところなので、いったんアテンション、お金の流れを変えないといけないのだということです。それがWeb3なのかどうかは分からないですけれども、今の広告モデルでやっている以上、必然的に生まれている部分というのはあるのだと思うのです。

吉田:はい。そうですね。

笹原准教授:いかに、先ほど言ったように、Polyphonyのアイデア、ナッジが大事ですよというようなことを言っても、それはTwitterなりFacebookなりのプラットフォームの利益を損なう方向に働いてしまうので、むしろまとまってくれていたほうがターゲティングできるから、プラットフォーマーとしてはそちらを目指しますよね。でもプラットフォーマーが長期的な、健全なコミュニケーションを支えるのだというふうに企業理念を変えないと、なかなかそこは変わらないです。

吉田:はい。ちょっと付け加えたいのですけれども、Facebookさんの内部告発やTwitterの内部告発でも、シリコンバレーのカルチャーで作っていて、取りあえずやってみて試してみてということで、それでストップはないなどというふうになっていると思うのです。それが両方で暴露されたと思います。でも、SNSはそういうものではなくなったという、医薬品やお酒などでしょうか

笹原准教授:だからこそセキュリティーに乗っかっているとそうなるのですよね。そうです。何億人というサイズで使うようなものになってしまいました。もう公共の性質が非常に大きくなって起きてしまったので、そのように簡単にABテストをしてくれるなということですよね。

吉田:そうですよね。はい。すみません。ではありがとうございます。最後にちょっと今後の研究の抱負だけ伺ってもいいですか。

笹原准教授:そうですね。今は特にこのCRESTのプロジェクトでディープフェイクを見抜くような技術、それをどうやって、あるいはシンセティックメディアといわれるような、真贋がなかなか人間では判断付かないようなメディアが氾濫した時にどうするかということを研究しているので、何とかそれで社会実装できるような技術を作っていきたいですし、それをうまく活用できるような使用法というのでしょうか、システムの組み方のようなことを見つけていきたいなと思います。私は計算社会科学者なので、何とかそこを定量的なエビデンスで押さえたいなと思っています。

吉田:はい。きょうはどうもありがとうございました。

笹原准教授:はい。

吉田:素晴らしいお話、とても勉強になりました。

笹原准教授:はい。こちらこそ、ありがとうございます。

参考文献

1. Sasahara, K., Chen, W., Peng, H. et al. Social influence and unfollowing accelerate the emergence of echo chambers. J Comput Soc Sc 4, 381–402 (2021). https://doi.org/10.1007/s42001-020-00084-7

2. 笹原 和俊, SUGANO Bruno, 奥田 慎平, 佐治 礼仁, 加藤 周, Polyphony, 人工知能学会全国大会論文集, 2020, JSAI2020 巻, 第34回 (2020), セッションID 1L4-GS-5-05, p. 1L4GS505, 公開日 2020/06/19, https://doi.org/10.11517/pjsai.JSAI2020.0_1L4GS505, https://www.jstage.jst.go.jp/article/pjsai/JSAI2020/0/JSAI2020_1L4GS505/_article/-char/ja, 抄録: