AI規制を声高に叫びながら誰もが巨大モデルにオールインしている現実

「AIの安全性」を巡る議論が噴出している。だが、主張のどれもが各々のステークホルダーの利益を代表しているように見える。実際には誰もが全てのリソースをAI研究に投じ、競争相手を出し抜こうとしている。

「AIの安全性」を巡る議論が噴出している。だが、主張のどれもが各々のステークホルダーの利益を代表しているように見える。実際には誰もが全てのリソースをAI研究に投じ、競争相手を出し抜こうとしている。

先日、イーロン・マスクやジョシュア・ベンジオなどのレジェンド級のAI研究者によって、巨大AI実験の減速とGPT-4より強力なモデルの訓練の一時停止を求める請願書が出された。この公開書簡には、今のところ約2万人の署名が寄せられている。

興味深いのは、請願者の一部にとっては、OpenAIがAI競争で先行するのを阻止するための「戦略的な呼びかけ」に過ぎないのではないか、と見受けられることだ。

その筆頭がマスクである。マスクはTwitter社内で大規模な人工知能プロジェクトを始動させたと報じられている。同社はすでに約10,000個のGPUを購入し、大規模な言語モデル(LLM)を含むプロジェクトのためにDeepMindからAI人材を採用したと米メディアBusiness Insiderは報じた。

深層学習に利用されるハイエンドGPU 約10,000個の購入は、数十億円から100億円以上までの投資を意味する。また、このGPUに計算させるのも非常に高価だ。Twitteは「不安定な財務状況」が続いているにもかかわらず、計算に数千万ドルを費やしたとされる。

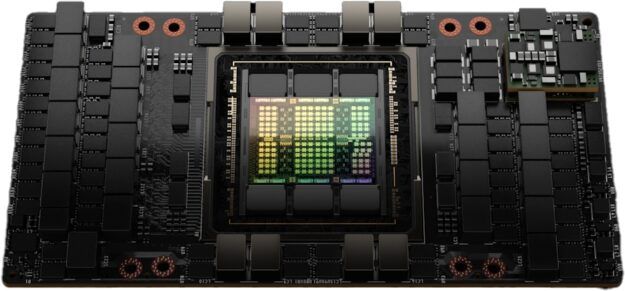

OpenAIはChatGPTボットの訓練にNVIDIAのA100 GPUを使用し、現在もこのマシンを使ってChatGPTを動かしている。現在、NVIDIAはA100の後継機であるH100 GPUを発売しており、ほぼ同じパワーで数倍の速度がある(写真)。Twitterは、AIプロジェクトにH100 GPUまたは同様のハードウェアを使用する可能性が高いと思われる。同社がAIプロジェクトを何に使うかまだ決めていないことを考えると、何台のHopper GPUが必要になるかを推定するのは難しい。

Twitterは、エンジニアの追加採用も行っているようだ。今年初め、同社はAlphabetの子会社であるAI研究所DeepMindのエンジニア、Igor BabuschkinとManuel Kroissを採用した。マスクは少なくとも2月から、OpenAIのChatGPTに対抗するため、AI業界で積極的に人材を求めてきた。生成AIの正確な目的は不明だが、検索機能の向上やターゲットとなる広告コンテンツの生成などの応用が考えられている。

第三極を形成する動き

一方、「テック大手以外」の第三極を形成する動きも活発化した。ドイツの非営利AI研究団体であるLAION(Large-scale AI Open Network)は先週、「安全なデジタル未来」のためにAIモデルの公開を求める署名活動を開始した。この書簡の中で、同団体は、マスクらの請願を「誤ったアプローチ」と呼び、どちらの目的にも不利になる可能性があると指摘している。むしろ、AIのイノベーションのプロセスを加速させるべきだ、と書簡は述べている。

この新しい請願書の最も重要な目標は、国際的な発展のためのAI研究をオープンソースで行うための公的資金によるスーパーコンピュータをオープンソースで大規模なAI研究とその安全性のために建設することだ。「オープンソースの基礎モデルを訓練するために、10万個の最新AIアクセラレータを備えた国際的な公的資金によるスーパーコンピューティング施設を設立する」と書かれたこの手紙は、現在2500人以上の署名者がおり、目標の1万人の4分の1に達している。

LAIONのメンバーであるChristoph Schuhmann、Huu Nguyen、Robert Kaczmarczyk、Jenia Jitsevによって書かれた新しい請願は、マイクロソフト、OpenAI、グーグルのような大企業からAI研究を独占したいま、アカデミアや政府機関の独立性を確保することが、いかに時代の要請であるかを説いている。「GPT-4のようなテクノロジーは、少数精鋭で独占的にコントロールするにはあまりにも強力で重要なものです」と書簡には書かれている。

LAIONは、スーパーコンピュータを使った誰もがアクセスできる大規模なモデルは、グローバルに、中小企業に大きな利益を与えるとも考えている。しかし、「AIのためのCERN」を実現するための招致は、まだEU、英国、カナダ、オーストラリアに限られている。

LAIONの請願も、コミュニティから反発を受けている。LAIONの主張もまた画像生成を手掛けるグループの利益を反映したものにも見えるからだ。

LAIONは、Stable DiffusionやMidjourneyなどの画像生成モデルで使用される画像データセット「LAION-5B」を構築したことで、多くの論争にさらされてきた。LAIONのデータは、元のソースに正当なクレジットを与えることなく、インターネットから非倫理的にかき集められたものだ。

正しい規制のあり方とは?

マスク主導の請願に反対した一人である、Meta チーフAIサイエンティストのヤン・ルカンは、スタンフォード大学のAI研究者のアンドリュー・ンとの対談で、AGIを心配する人たちがいかに見当違いなことを言っているか、今は実際に危害を加えるリスクがあるが、それは研究によって解決される必要があることを表明している。

ルカンとンは、将来起こりうる危害に基づいて研究を規制するのは良くない考えであり、製品を規制することが実は正しい道かもしれないと話している。ルカンは、GPT-4に一定の評価を示したものの、それ以上のものを作ることも同様に重要であると言っている。

マスクは、最近Twitterでルカンと同じ話題で議論になり、意見をぶつけていた。

ルカンはAIの安全性を航空機の安全性と比較し、「航空機のエンジニアが飛行機を怖がらないのと同じように、なぜAIエンジニアがAIを怖がる必要があるのか」と言ったところ、マスクは「連邦航空局(FAA)が航空機メーカーに安全性に手を抜かないよう規制を設けるまでは、飛行機は頻繁に墜落していた」と反論した。

ニューヨーク・タイムズとのポッドキャストで、アルファベットのスンダー・ピチャイは、マスクらの請願の詳細には異論があるかもしれないが、この文書で引き出されている精神には同意すると述べている。「AIは、規制するにはあまりにも重要な分野です。また、規制してはいけない重要な分野でもあります。だから、こうした会話が進んでいることをうれしく思う」と語った。