米陸軍が兵士の意図を汲む会話型AIを開発

米陸軍の研究部門は、兵士が特定のコマンドを使うのではなく、自然な会話をすることで小型ロボット車に命令を与えることができるシステムを開発している。ロボットは兵士の意図を理解し、与えられたタスクを完了させることができるようになるという。システムは、地域の偵察や捜索救助に使われるだろう。

米陸軍の研究部門は、兵士が特定のコマンドを使うのではなく、自然な会話をすることで小型ロボット車に命令を与えることができるシステムを開発している。陸軍のプレスリリースによると、ロボットは兵士の意図を理解し、与えられたタスクを完了させることができるようになるという。システムは、地域の偵察や捜索救助に使われるだろう。

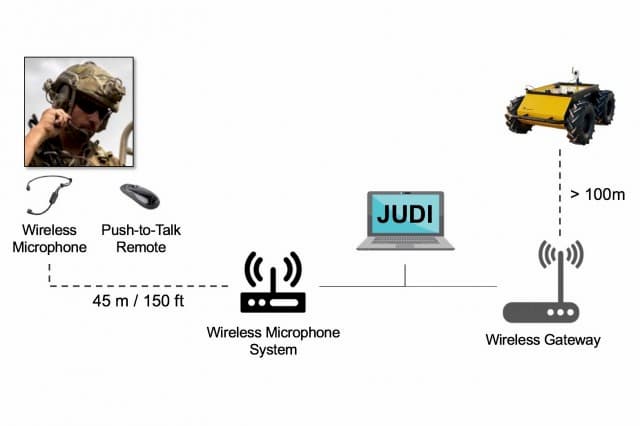

米国陸軍戦闘能力開発司令部の陸軍研究所の研究者は、南カリフォルニア大学創造技術研究所と共同で、兵士と自律システム間の双方向の会話対話を可能にするJUDI(Joint Understanding and Dialogue Interface)能力を開発した。

この取り組みは、自律システムとチームを組む際の兵士の負担を軽減し、システムを口頭で指揮・制御できるようにすることで、次世代戦闘車両の陸軍近代化優先課題と自律性のための陸軍優先研究領域を支援するものだ。

同研究所の研究員であるマシュー・マージ博士は、ステートメントの中で「対話は、陸・空・海・情報空間にまたがる兵士が戦場で状況認識を維持できるようにするために、マルチドメイン作戦の多方面で活動する自律システムにとって重要な機能となるでしょう」と述べている。「この技術により、兵士は、口頭でのタスク指示を移動ロボットの指揮・制御に使用することができる戦術作戦において、双方向の音声と対話を介して自律システムと対話することが可能になる。また、この技術により、タスクが完了した際にロボットに明確な説明を求めたり、状況の更新を提供したりすることが可能になる。任務に関する事前に指定された、時代遅れの可能性のある情報に頼るのではなく、対話によって、人間のチームメイトと会話することで世界の理解を補うことが可能になる」。

この革新的なアプローチでは、対話処理は、兵士の話し言葉から兵士の意図を解釈する統計的な分類法に基づいていると同博士は言う。この分類器は、研究の初期段階では人間の実験者がロボットの自律性に立ち会っていた人間・ロボット対話の小さなデータセットで訓練された。

マージ博士は「自然言語を活用するJUDIの能力は、偵察や物資の配送のように、任務に異なる能力を貢献するロボットを制御したり、チームを組む必要がある兵士の学習曲線を減らすでしょう」と語った。

目標は兵士とロボットの相互作用のパラダイムを、今日のような頭を下げてハンズフルにジョイスティックで操作するロボットから、ソルジャーが周囲の状況を認識しながら1台以上のロボットとチームを組むことができる、頭を上げてハンズフリーでの相互作用モードへとシフトさせることにあると彼は述べている。

研究チームによると、JUDIは商業分野で行われている現在の類似の研究とは異なるものだ。

「商業界では、主にSiriやAlexaのようなインテリジェントなパーソナルアシスタントに焦点を当ててきた。事実に基づいた知識を取得し、リマインダーを設定するような専門的なタスクを実行することができるシステムだが、物理的な周囲の状況を考慮して推論することはない」とマージ博士は述べている。「これらのシステムはまた、タスクの実行方法を学習するために、クラウドの接続性とラベル付けされた大規模なデータセットに依存している」。

「対照的に、JUDIは物理的な世界での推論を必要とするタスク向けに設計されており、人間とロボットの以前の相互作用を必要とし、信頼できるクラウド接続性がほとんどないためにデータが疎かになっている。現在のインテリジェントなパーソナルアシスタントは、何千ものトレーニング例に依存している可能性があるが、JUDIは数百と桁違いに小さいタスクに合わせることができる」。

さらに、JUDIはロボットのような自律システムに適応した対話システムであり、兵士の音声やロボットの知覚システムのような複数の文脈の情報源にアクセスして、協調的な意思決定を支援することを可能にしている、と米陸軍は主張している。

JUDIは、10年に及ぶRobotics Collaborative Technology Allianceの下で開発された、ナビゲーション、計画、知覚、制御、推論などのインテリジェントシステムに必要とされる特定の機能を実行するソフトウェアアルゴリズム、ライブラリ、ソフトウェアコンポーネントのスイートであるCCDC ARL Autonomy Stackに統合される予定だ。

「ARLが自律性ソフトウェアスタックに組み込まれた新しい能力を開発すると、それはGVSCのロボティクス技術カーネルへと移行し、広範なテストとハードニングを経て、コンバットビークルロボティクス(CoVeR)プログラムなどのプログラムで使用される」とAIMM ERPプログラムマネージャーのJohn Fossaceca博士は、ステートメントの中で述べている。「最終的には、これは陸軍が所有する知的財産となり、次世代の戦闘車両がモジュラーインターフェースを備えた最高の技術をベースにしていることを保証するための共通アーキテクチャとして、業界のパートナーと共有されることになる」。

今後、研究者たちは9月に予定されているAIMM ERP全体のフィールドテストにおいて、物理的な移動ロボットプラットフォームを用いたJUDIのロバスト性を評価する予定だ。

「私たちの究極の目標は、兵士が自律システムとより簡単にチームを組めるようにすることで、特に偵察や捜索救助のようなシナリオにおいて、より効果的かつ安全に任務を遂行できるようにすることです。"兵士が、拡張が可能で、ミッションの状況に容易に適応できる自律システムへのよりアクセスしやすいインターフェースを持つことができることを知ることは、非常に喜ばしいことでしょう」。

民間人を誤射するリスクも

陸軍は、このシステムを搭載したロボットは、オペレータの意図を理解することができるだろうと主張しているが、それはもしかしたら民間人を誤爆する可能性がある。

意図分類はチャットボットの標準的な機能であり、陸軍が作ろうとしているものと最も類似した技術である。これらのボットは、一般的な質問やフレーズに基づいて訓練されており、特定の意図と照合される。例えば、「タクシーを呼べ」「車を拾ってくれ」「タクシー」などは、すべてSiriがUberアプリを開くためのコマンドに結び付けられる。しかし、これらのコマンドはシステムにあらかじめプログラムされている必要がある。アルゴリズムが実際に学習するのは、コマンドに単語を一致させる方法であって、コマンドに従う方法や新しいコマンドを作成する方法、何らかの方法で適応する方法ではない。

この新しいシステムの下では、陸軍のロボットは、物理的な環境に関する文脈を非公式な会話と統合しなければならない。「あそこに行って」という言葉は、発話のたびに異なる意味を持つことがあり、ナビゲートされるべき無限の可能性の領域を生み出している。たとえロボットを操作する兵士がランドマークを指差したり、言及したりしたとしても、AIはランドマークがどのように見えるかを理解したり、人間が指差した軌跡をどうやってトレースするかを理解するために、何層にも何層にも及ぶ追加のアルゴリズムを必要とするだろう。

これが、移動式ロボットの明確なリーダーであるボストン・ダイナミクス社のような企業が、いまだにリモートコントローラーに頼っている理由かもしれない。StarshipやRefraction AIのような自律型配送ロボットでは、何かが軌道から外れた場合に備えて遠隔操作者が制御できるようになっている。これらはすべて、ロボット工学に数十億ドル、数十億ドルを投資しているシリコンバレーの最大手企業や敏捷な新興企業をいまだに悩ませている技術的な課題だ。

また、倫理的な問題もある。米軍は、殺人に使用されるロボットやドローンには人間のオペレーターが必要だと主張してきた。しかし、それが意図を判断するのがロボットの仕事であり、将来的にそれらの意図コマンドの一つが武器を発射することになるかもしれない場合、コマンドが誤って発動されることがないという高い信頼性が必要になる。軍用ロボットは兵士の意図を間違って推測したために民間人を殺す可能性がある。

聴覚的な合図はまた、敵対的な例、画像やノイズによってロボットを攻撃に開放し、アルゴリズムを騙して通常はしないようなことをさせるように特別に設計されている。これらの攻撃は、一般的な音声認識アルゴリズムにも有効であることが示されている。

軍用ロボットには、機械を命令して操作するための特別な訓練を受けた特別なハンドラーが必要になるかもしれない。このシステムは9月の実地試験でテストされる予定で、アルゴリズムの有効性がそこでテストされる可能性が高い。これには前例がある。ボストン・ダイナミクス社製ロボット「スポット・ミニ」には専用のハンドラーがいる。将来の仕事を考える上で、興味深いことだ。「ロボットのハンドリング」は、履歴書に望まれるスキルなのかもしれない。