BLOOM:数百人の研究者の共同作業により開発されたオープンな大規模言語モデル

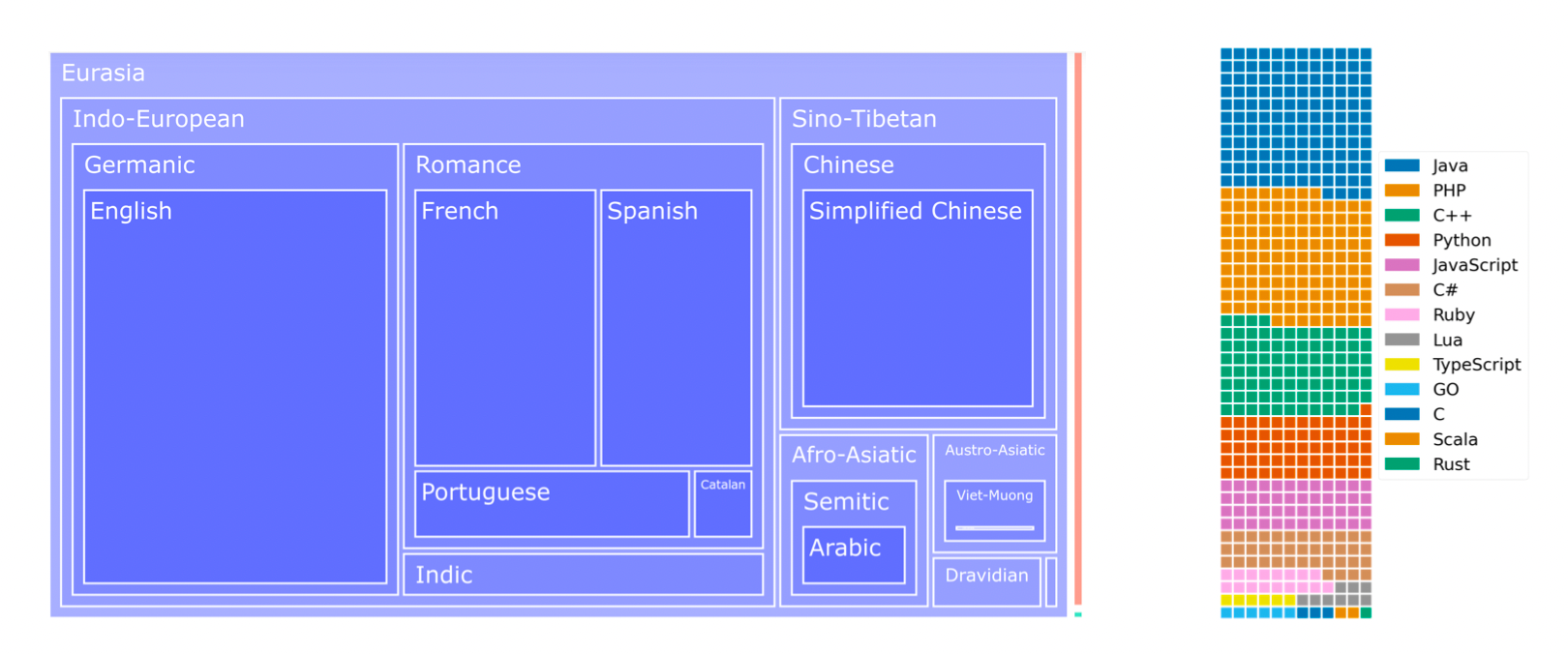

完全な透明性をもって訓練された初の多言語LLMがBLOOM(BigScience Large Open-science Open-access Multilingual Language Modelの略)である。BLOOMは、46の自然言語と13のプログラミング言語で学習した1760億パラメータの言語モデルで、数百人の研究者の共同作業により開発・公開された。

大規模言語モデル(LLM)は、AI研究に大きなインパクトを与えている。事前学習された言語モデルは、より少ない量のラベル付きデータからより良いパフォーマンスを生み出すことが多いため、現代の自然言語処理(NLP)パイプラインの基礎になっている。

言語モデルの性能は、モデルを大きくするにつれて増加する傾向があり、LLMの学習コストは、十分にリソースのある組織にとってのみ許容可能なものとなった。さらに、最近まで、ほとんどのLLMは一般に公開されていなかった。その結果、研究者コミュニティの大半はLLMの開発から排除されてきた。

この現状を変えるために、完全な透明性をもって訓練された初の多言語LLMがBLOOM(BigScience Large Open-science Open-access Multilingual Language Modelの略)である。BLOOMは、46の自然言語と13のプログラミング言語で学習した1760億パラメータの言語モデルで、数百人の研究者の共同作業により開発・公開された。

BLOOMは、AIスタートアップのHugging Faceがフランス政府からの資金援助を受けてコーディネートしたBigScienceというプロジェクトにおいて、1000人以上のボランティア研究者が昨年1年間かけて作り上げたものである。 BigScienceは2021年5月に始まり、1000人以上の研究者が大規模で多言語のディープラーニングモデルを構築するために協力した。

オープンソースのAIスタートアップであるHugging Faceによって組織された30のワーキンググループは、2021年半ばから2022年半ばにかけて、データガバナンス、入力データとソースの選択、モデリング、モデルの評価、モデルの最適化とスケーリングを含むエンジニアリング、一般化、倫理的AIと法的枠組み、ROOTSオープン多言語データセットとRAILオープンAIライセンスの導入といった大規模言語モデル(LLM)構築におけるすべての異なるステップを扱う作業を設定することになりました。

この共同研究には、Institute for Development and Resources in Intensive Scientific Computing (IDRIS) と Grand Equipement National De Calcul Intensif (GENCI)が参加した。これらの機関は、ワークショップにJean Zayスーパーコンピュータの利用を可能にした。このチームは、最大150 TFLOPSの学習スループットを達成した。最終的なBLOOMモデルのトレーニングには117日間を要した。

今年の7月12日に正式にローンチした。研究者たちは、他の主要モデルと同等の性能を持つオープンアクセスLLMの開発が、AI開発の文化に長期的な変化をもたらし、世界中の研究者が最先端のAI技術へのアクセスを民主化するのに役立つことを期待している。