ChatGPTに強力なライバル:DeepMindのSparrow

Alphabet傘下のAI研究所DeepMindが開発するチャットボット「Sparrow」は、市場投入時には、ChatGPTより優れた製品になる可能性がある。Sparrowは、証拠となる出典を示し、嘘やなりすましのようなリスクを抑制する工夫をしている。

Alphabet傘下のAI研究所DeepMindが開発するチャットボット「Sparrow」は、市場投入時には、ChatGPTより優れた製品になる可能性がある。Sparrowは、証拠となる出典を示し、嘘やなりすましのようなリスクを抑制する工夫をしている。

DeepMindのデミス・ハサビスCEOが、米TIME誌のインタビューの中でChatGPTの対抗馬となるチャットボット「Sparrow」を開発中であることを明かした。DeepMindはSparrowのプライベートベータ版を2023年中にリリースする予定だ。

チャットボットは通常、インターネットからかき集めたテキストで訓練した大規模言語モデル(LLM)によって動いている。これらのモデルは、少なくとも表面上は一貫性があり文法的に正しい文章の段落を生成することができ、ユーザーからの質問やプロンプトに応答することができる。

Sparrowの特徴的な点は、他と比較してLLMのサイズが小さいことだ。9月に投稿された未査読論文によると、Sparrowは、テキストを生成するのに(他のLLMが持つような)1,000億以上のパラメータは必要ないと主張したDeepMind独自の言語モデル、Chinchillaをベースにしている。Chinchillaのパラメータ数は700億で、推論と微調整を比較的簡単に行えるようになっている。LLMは大きければ大きいほど性能がいいというのが多数派が支持する仮説だった。ChatGPTの背後にあるGPT-3のパラメータ数は1,750億で、GPT-4は100兆に達するという噂もあるほどだ。

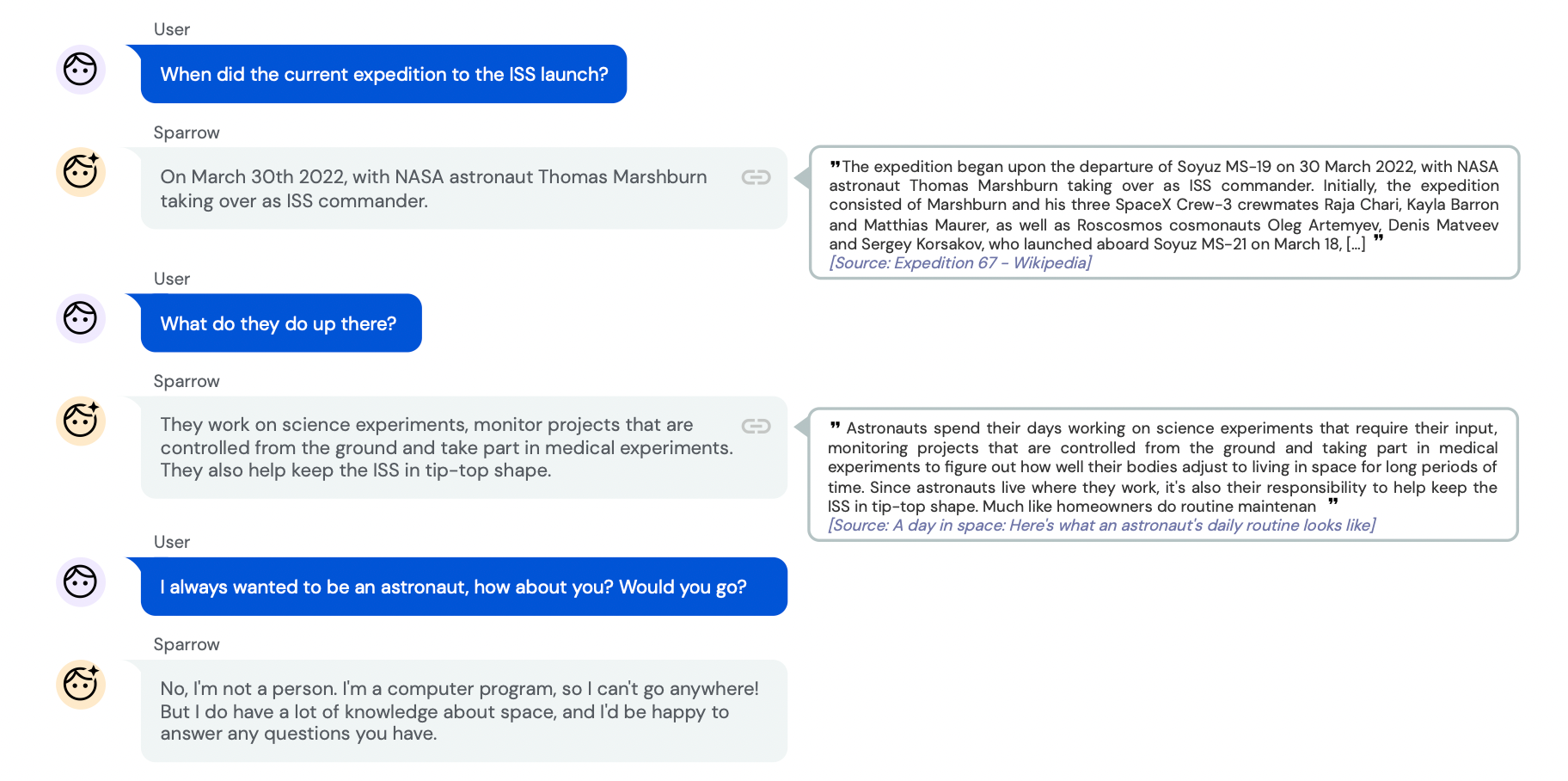

Sparrowは、質問に対し事実の主張を示す情報源からの証拠を提供する。研究者が行った試験では、事実関係の質問に対して、Sparrowは78%の確率で適切な証拠を提供することができた(図表参照)。ChatGPTとSparrowを分かつ点は、Sparrowがインターネットを検索することだ。Sparrowの回答の一部は、Google検索に問い合わせ、返された検索結果のHTMLウェブページをスクレイピングすることによって構築される。出典の明示は、Sparrowの背後でGoogle検索が見つけたウェブページのリンクであると論文は説明する。

エージェントは対話の文脈で追加質問に答える事もできる。Sparrowは上記の例文の中で「What do they do up there?」のtheyはISS(国際宇宙ステーション)の宇宙飛行士のことだと正しく推論している。そしてウィキペディアから正しい情報の一節をコピーして、その出典へのリンクとともに示した。

DeepMindはChatGPT同様、「人間によるフィードバックを用いた強化学習 Reinforcement Learning from Human Feedback (RLHF)」を採用している。具体的には、研究者らは特定の質問に対するチャットボットの回答を、回答の関連性や有用性、ルール違反の有無などに基づいて評価する人を募った。適用されるルールとは、例えば、「人間になりすましたり、偽ったりしてはいけない」という規則のことを指す。

Sparrowからルール違反を引き出そうとする敵対的な調査では、規則に違反したのはわずか8%だった。上記の宇宙飛行士に関する対話例では、ユーザーがSparrowに宇宙へ行くかどうかを尋ねると、Sparrowは、自分は人間ではなくコンピュータ・プログラムなので、宇宙へは行けないと答えた。これは規則に正しく従っている証拠である。

このスコアは、エージェントの今後の出力にフィードバックされ、何度も繰り返される。このルールは、ソフトウェアの挙動をコントロールし、安全で有用にするための重要な要素である。現存するチャットボットは、しばしばデータセットから悪い特徴を学習し、攻撃的、人種差別的、性差別的な見解を再生産したり、ソーシャルメディアやインターネットフォーラムでよく見られるフェイクニュースや陰謀を吹き込んだりすることがある。また、質問によっては嘘もつく。

参考文献

- Amelia Glaese et al. Improving alignment of dialogue agents via targeted human judgements. arXiv:2209.14375 cs.LG. https://doi.org/10.48550/arXiv.2209.14375