無声音声をデジタル合成音声に変換するAIシステム

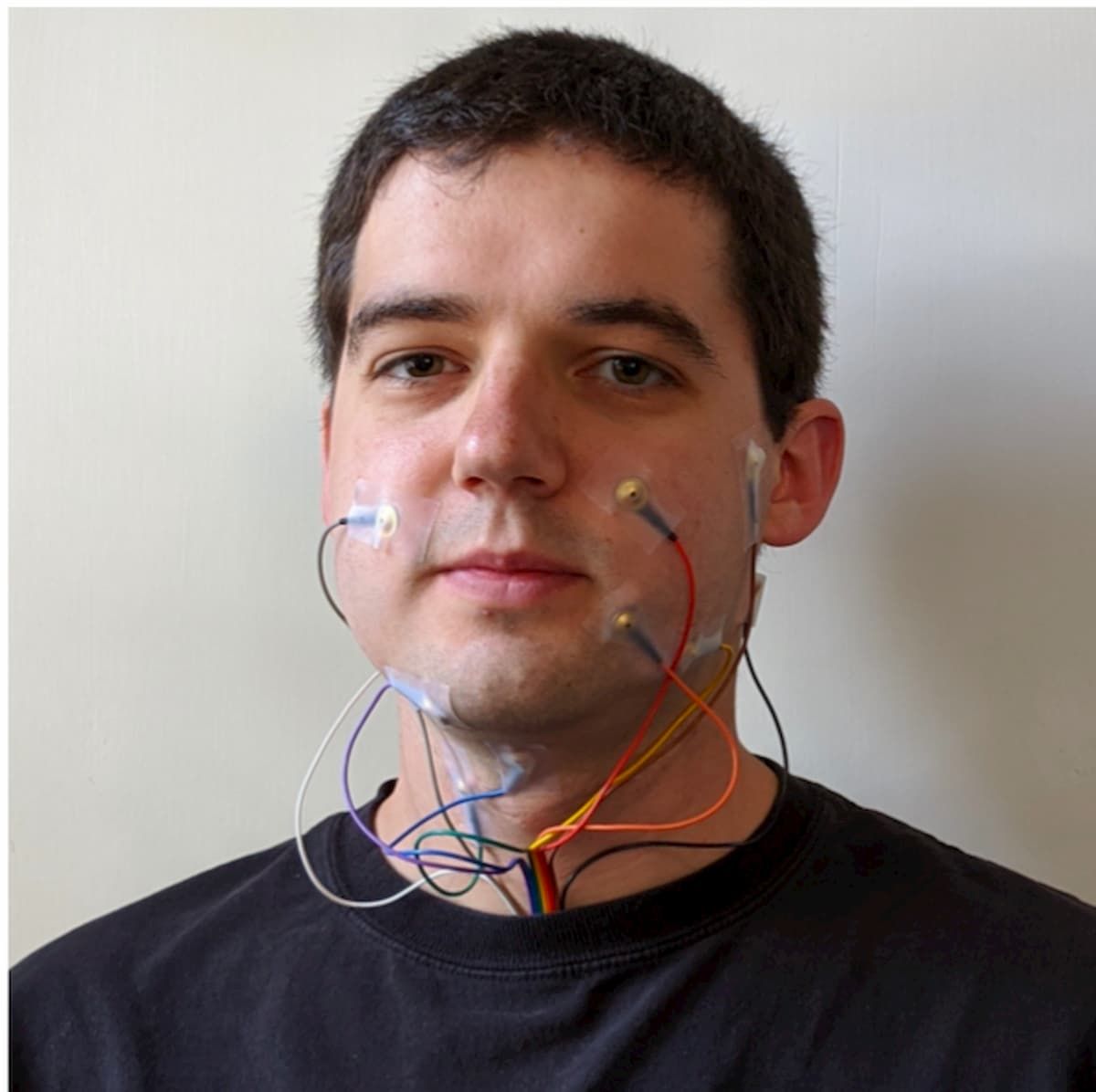

UCバークレー校の研究者らは、顔や喉に電極を当てて筋電図(EMG)を使って、無声発話を検出するAIシステムを開発することに成功した。このモデルは、音を出さずに発話された音声を筋肉感覚で測定することで、無声発話を実現する。特に、デジタルボイシングと呼ばれる、送信や再生のための合成音声を生成する作業に焦点を当てている。

UCバークレー校の研究者らは、顔や喉に電極を当てて筋電図(EMG)を使って、無声発話を検出するAIシステムを開発することに成功した。先週オンラインで開催されたEmpirical Methods in Natural Language Processing (EMNLP)のイベントで、David GaddyとDan Kleinによるこのモデルに関する論文「Digital Voicing of Silent Speech」が最優秀論文賞を受賞した。

UCバークレー校の研究者は、無声発話の予測に「音声出力ターゲットを発声録音から無声録音に転送する」アプローチを採用した。その後、DeepMimdが開発した深層学習による音声波形モデルWaveNetを音声音声予測を生成するために使用している。

このモデルは、音を出さずに発話された音声を筋肉感覚で測定することで、無声発話を実現する。特に、デジタルボイシングと呼ばれる、送信や再生のための合成音声を生成する作業に焦点を当てている。

研究者らは、彼らの研究が、音声を出せない人々のための多くの応用を可能にし、AIアシスタントや音声コマンドに反応する他のデバイスのための音声検出をサポートする可能性があると考えている。「例えば、Bluetoothヘッドセットのように、周囲の人に迷惑をかけずに電話での会話ができるようなデバイスを作ることができる。このようなデバイスは、環境が大きすぎて聞き取りにくい場合や、沈黙を維持することが重要な場合にも有用である。また、外傷や病気で喉頭を摘出された人など、可聴音声を発することができなくなった人がこの技術を使用することも可能である。

このようなデジタルボイシングの無声音声への直接的な用途に加えて、無声音声テキストシステムを作成するためのコンポーネント技術としても有用であり、既存の高品質なオーディオベースの音声テキストシステムを活用して、無声音声をデバイスやデジタルアシスタントで利用できるようにすることができる。

発声されたEMGデータで訓練されたベースラインと比較して、このアプローチでは、書籍の文章を書き写す際の単語エラー率が64%から4%減少し、ベースラインと比較してエラーが95%減少した。この分野でのさらなる研究を促進するために、研究者たちは20時間近くに及ぶ顔面筋電図データを公開した。