Google、AI倫理のコンサルティングを提供へ

グーグルは年末までに、新たなAI倫理サービスを開始する予定だ。最初は、グーグルは、コンピュータビジョンシステムにおける人種的偏見の発見、またはAIプロジェクトを管理する倫理的なガイドラインの開発などのタスクについて、コンサルティングを提供する予定だ。

グーグルは年末までに、新たなAI倫理サービスを開始する予定だ。Wiredの報道によると、最初は、グーグルは、コンピュータビジョンシステムにおける人種的偏見の発見、またはAIプロジェクトを管理する倫理的なガイドラインの開発などのタスクについて、コンサルティングを提供する予定だ。長期的には、顧客のAIシステムの倫理的な整合性を監査し、倫理的なアドバイスを有料で提供する可能性もある。

グーグルはクラウドコンピューティング市場ではアマゾンとマイクロソフトに次ぐ遠い3位で、AIの専門知識を競争上の優位性と位置付けている。成功すれば、この新しい取り組みは新たな流行語を生み出す可能性がある。それは、EaaS(Ethics as a Service)。「サービスとしての倫理」を意味し、SaaS(Software as a Service)のようなクラウド業界の造語をモデルにしている。

グーグルは、独自の論争を経て、AIの倫理的な教訓を学んできた。2015年には、あるユーザーがサービスが黒人の友人と一緒に写った写真に「ゴリラのラベルを適用したと報告した後、グーグルは謝罪し、その写真アプリをゴリラの検出からブロックした。2018年には、何千人ものグーグル従業員が、ドローンからの監視画像を分析するために同社の技術を使用したMavenと呼ばれる国防総省の契約に抗議した(このプロジェクトは現在、Palantirというデータ分析会社が請け負っている)。

その後すぐに、同社は自社のAI技術を使用するための倫理原則を発表し、類似のプロジェクトではもはや競争しないと述べたが、すべての防衛関連の仕事を排除したわけではない。同年、グーグルは中国の権威主義的な検閲に準拠するように設計された検索エンジンのバージョンをテストしていることを認め、悪用される危険性があるため、ライバルであるマイクロソフトやアマゾンが何年も前から行っていたような顔認識技術を米政府に提供しないと述べた。

グーグルの苦戦は、AIが世界を助けるだけでなく、害を与える可能性がある性質に基づくものだ。 たとえば、顔認識システムは黒人に対しての正確さが低いことが多く、GPT-3のようなテキスト生成ツールはステレオタイプを強化することができる。同時に、規制当局、法律家、市民は、社会へのテクノロジーの影響力に疑念を抱くようになってきた。

Wiredによると、グーグルはすでに、世界的な銀行大手のHSBCなど、一部の顧客が考えることを支援してきた。今、グーグルは年内に正式なAI倫理サービスを開始することを目指している。Frey氏によると、最初のものは、グーグルの従業員に提供されているものと同様に、AIシステムにおける倫理的な問題を発見する方法や、AI倫理ガイドラインの作成と実装の方法などのトピックに関するトレーニングコースが含まれる可能性が高いという。その後、グーグルは顧客のAIプロジェクトをレビューしたり監査したりするためのコンサルティングサービスを提供する可能性があり、例えば、融資アルゴリズムが特定の人口統計グループの人々に偏っていないかどうかをチェックすることもあるという。グーグルは、これらのサービスの一部に課金するかどうかはまだ決めていない。

グーグル、フェイスブック、マイクロソフトはいずれも最近、開発者が自社のAIシステムの信頼性や公平性をチェックするために使用できる技術的なツールをリリースしており、多くの場合は無料である。IBMは昨年、システムの出力が民族性や郵便番号などの属性と問題のある相関関係を示す可能性があるかどうかを調べる「Check fairness」ボタンを備えたツールを発表した。

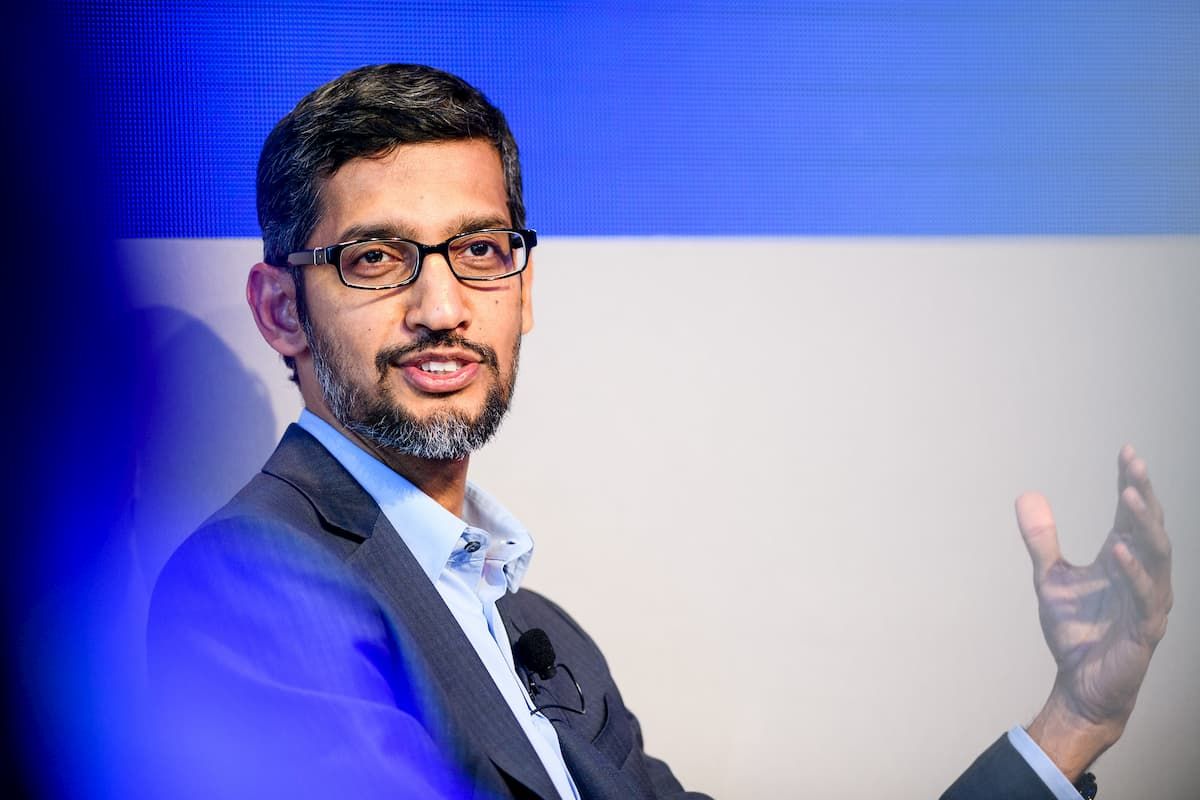

Photo: "An Insight, An Idea with Sundar Pichai" by World Economic Forum is licensed under CC BY-NC-SA 2.0