テスラの自律走行車はビジョンのみアプローチを継続するか?

LiDARはマスクが言うとおり松葉杖なのだろうか

要点

テスラはカメラ映像のみの自律走行を目指しており、それが成就したときの報酬は大きい。しかし、同社は秘密裏にLiDAR有りのアプローチもテストをしており、Waymoのような多数派と歩を揃える可能性もある。

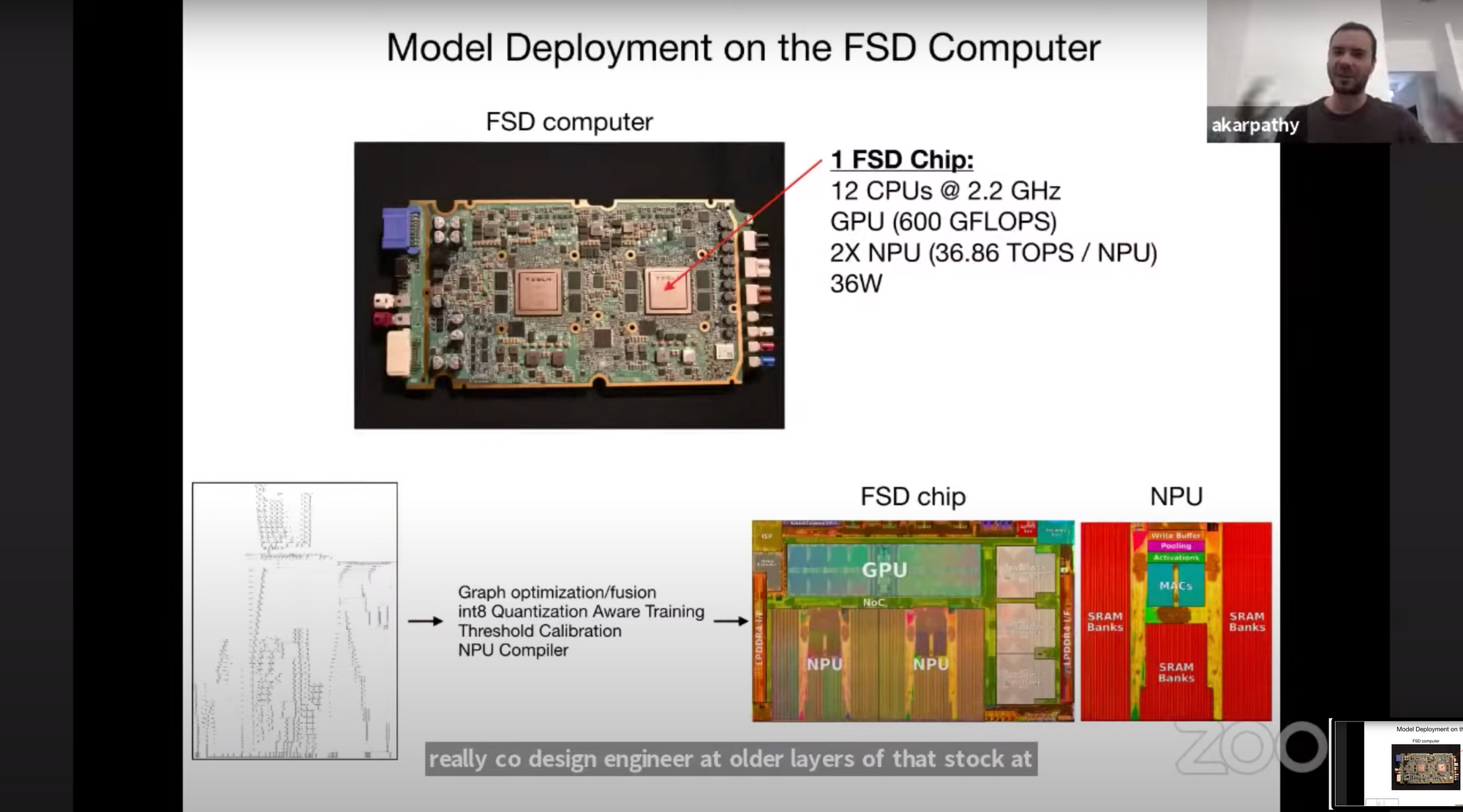

テスラの人工知能担当シニアディレクターであるAndrej Karpathyは6月21日に開催されたコンピュータビジョンのトップ会議であるComputer Vision and Pattern Recognition(CVPR)で、レーダーやLiDARのセンサーを捨てて、高品質の光学カメラによって自律走行を達成するビジョン(視覚)ベースのアプローチを紹介した。

テスラCEOのイーロン・マスクは以前、LiDARのことを「松葉杖」と呼び物議を醸したことがある。4月の第1四半期の発表資料では、テスラは「ビジョンのみのシステムは、究極的には完全な自律性に必要なものである」と記しており、その考えを改める兆候は見えない。

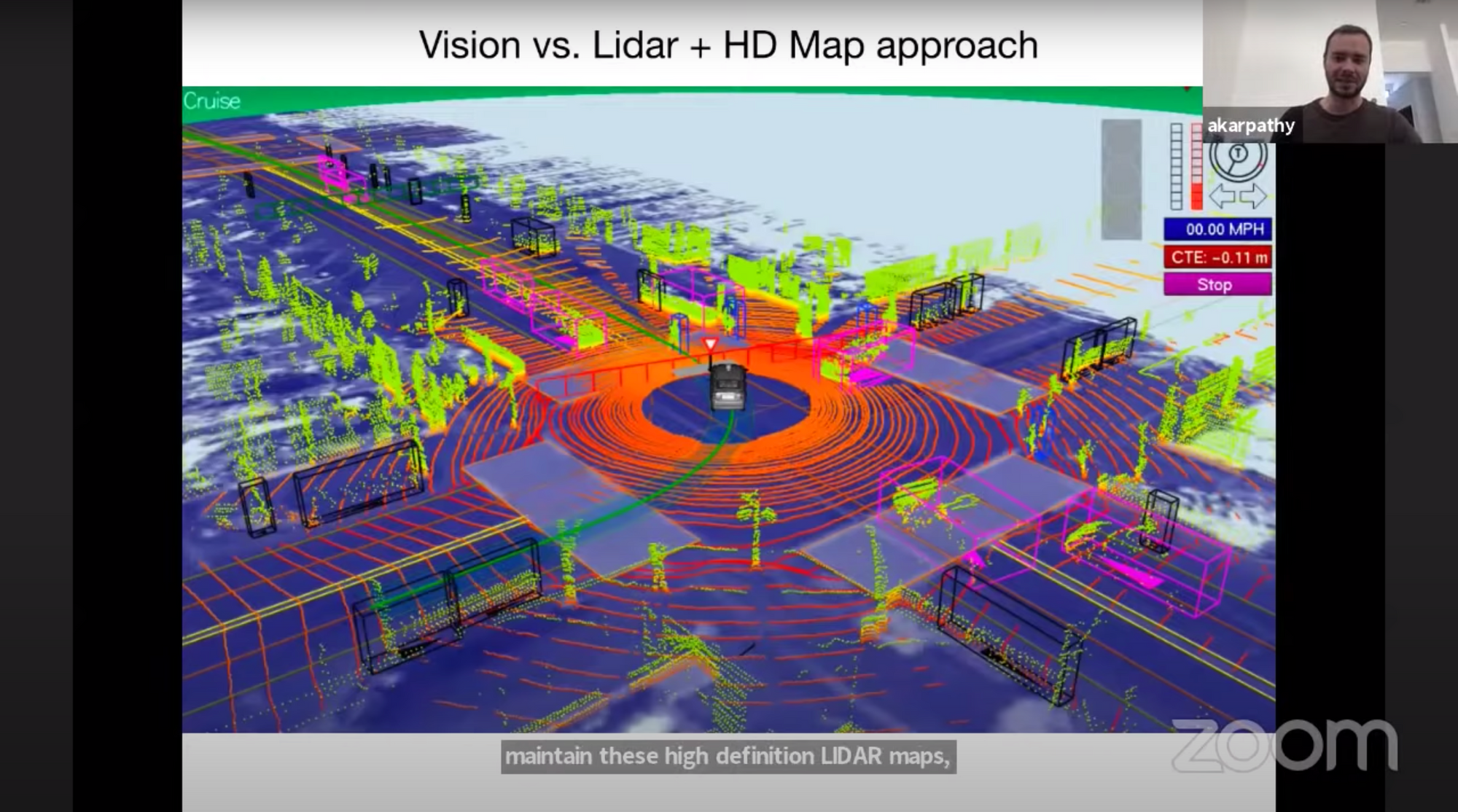

自律走行車開発者の多数派は、LiDARセンサーで環境を事前にマッピングし、高精細地図(HDマップ)を作成しているとされる。LiDARを利用した方法では、車線や信号機などもすべて地図に挿入し、テスト時にはその地図に車両の位置をマッピングして走行させているようだ。

自律走行車のセンサーは大量のデータを取得するが、それを基に運転を成立させるための短い時間で処理を行わないといけない。事前にHDマップを作成しておくと、この負荷を軽減することができる。一方、このアプローチはHDマップを作成していない場所では通用しないため、汎用的な自律走行を実現したことにはならない。だが、交通専門家の間には、より効率的な輸送を実現する公共交通機関を優先し、自律走行のロボタクシーをジオフェンス(仮想的な境界線で囲まれたエリア)の区域内に収めるべきとの考え方がある。このため、一定の区域内での自律走行の実現だけで、解くべき問題は解けているとも言える。

Waymoのような自律走行システムの会社と異なり、テスラは自動車会社であり、世界中に自律走行機能を持つ自動車を販売する必要がある。このため、どのような環境でも自律的に走ることできるビジョンベースの自律走行を追い求めているのかもしれない。イーロン・マスクは、自動車の私的所有と比べて少数の自動車で成立するロボットタクシー事業に言及しなくなっている印象がある。

視覚のみのアプローチは、世界中のあらゆる場所でHDマップを収集・構築・維持するよりも拡張性が高い一方で、物体検出や運転を担当するニューラルネットワークが、人間の奥行きや速度の認識能力に匹敵するスピードで膨大な量のデータを収集・処理できなければならないため、課題が多い。

テスラのビジョンシステムは、主に各車両に組み込まれた8台のカメラ(および12個の超音波センサー)がリアルタイムに生成するデータをニューラルネットワークで処理することに依存している。

Karpathyは「私たちのアプローチは主にビジョンベースで、車を囲む8台のカメラからの映像に基づいて、すべての出来事が車の中で初めて起こる(編注:事前に生成されたHDマップ等のデータに頼らず、その場ですべて判断しているの意)」と語っている。「例えば、初めての交差点では、車線がどこにあるのか、どのようにつながっているのか、信号機はどこにあるのか、どの信号機が関連しているのか、どの信号機がどの車線をコントロールしているのかなど、すべてのことが車の中で初めて起こる」。

「このインフラを常に最新の状態に保つのは非常にコストがかかる。もちろん、映像に基づいて信じられないほどよく機能するニューラルネットワークを実際に手に入れなければならないので、(競合他社のアプローチよりも)はるかに難しいことだ。しかし、一度うまくいけば、一般的なビジョンシステムとなり、原理的には地球上のどこにでも配備することができる。それが私たちが解決しようとしている問題だ」。

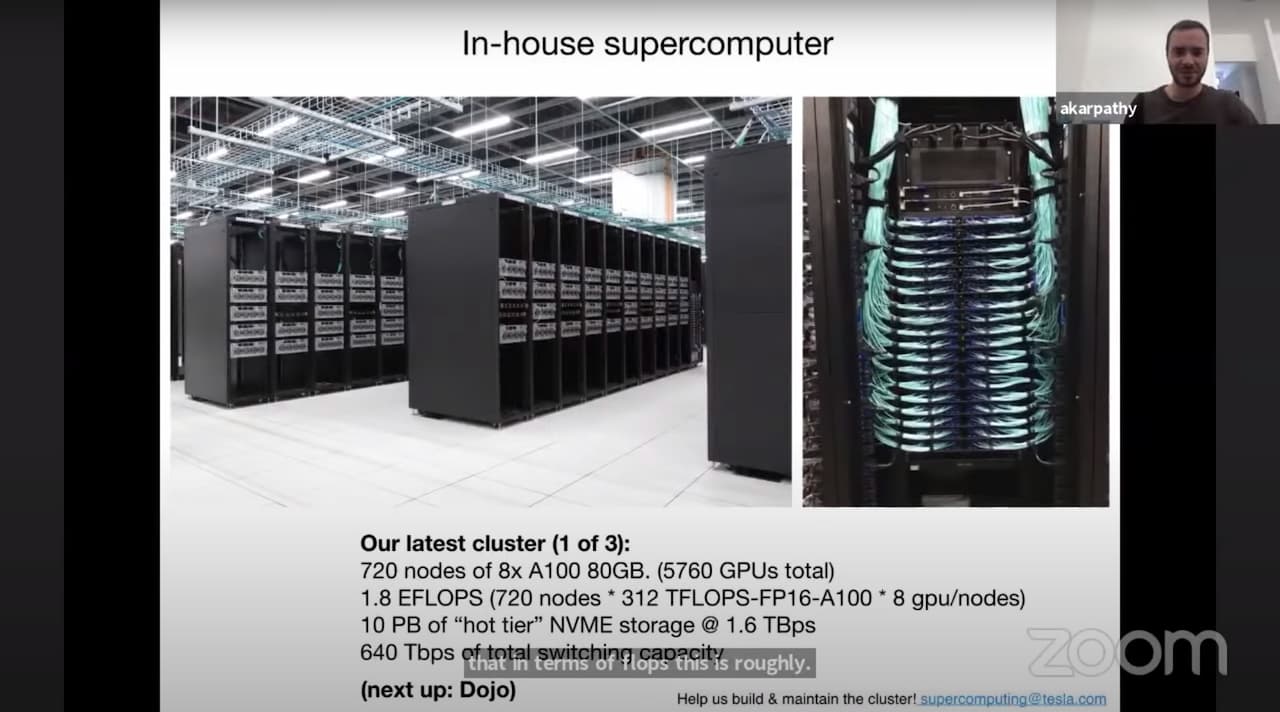

ワークショップの中では、Karpathyは同社の新しいスーパーコンピューターについても触れている。このスパコンは、車両を取り囲む8台のカメラから毎秒36フレームの映像を収集しており、車両を取り巻く環境について非常に多くの情報を提供していると、Karpathyは説明している。

昨年、マスクは、膨大な量のビデオデータを処理するためのニューラルネットワークトレーニングコンピュータ「Dojo」を開発していることを発表したが、Karpathyは講演の中でDojoの前身となるものを紹介した。この無名のスーパーコンピューターは、「720のノードがあり、それぞれにNvidiaのA100 GPU(80GBモデル)が8個ずつ搭載されており、システム全体ではなんと5,760個のA100がある」という。

「テスラの最新世代スパコンは、10ペタバイトのNVMe(不揮発性メモリ・エクスプレス) SSDを搭載し、毎秒1.6テラバイトで動作する。1.8 EFLOPS(エクサフロップス、浮動小数点演算を1秒間に100京回行う)で、世界で5番目に強力なスーパーコンピュータになるかもしれない」とKarpathyは語った。

テスラはこの最新のスパコンを使って、1本10秒前後の動画を100万本蓄積し、60億個の物体に奥行き、速度、加速度のラベルを付けた。これらが、なんと1.5ペタバイトに達しているという。しかし、ビジョンシステムだけに頼る自動運転システムに求められる信頼性を実現するためには、さらに多くのことが必要だという。そのため、テスラはより高度なAIを追求するために、これまで以上に強力なスーパーコンピューターを開発し続ける必要があるようだ。

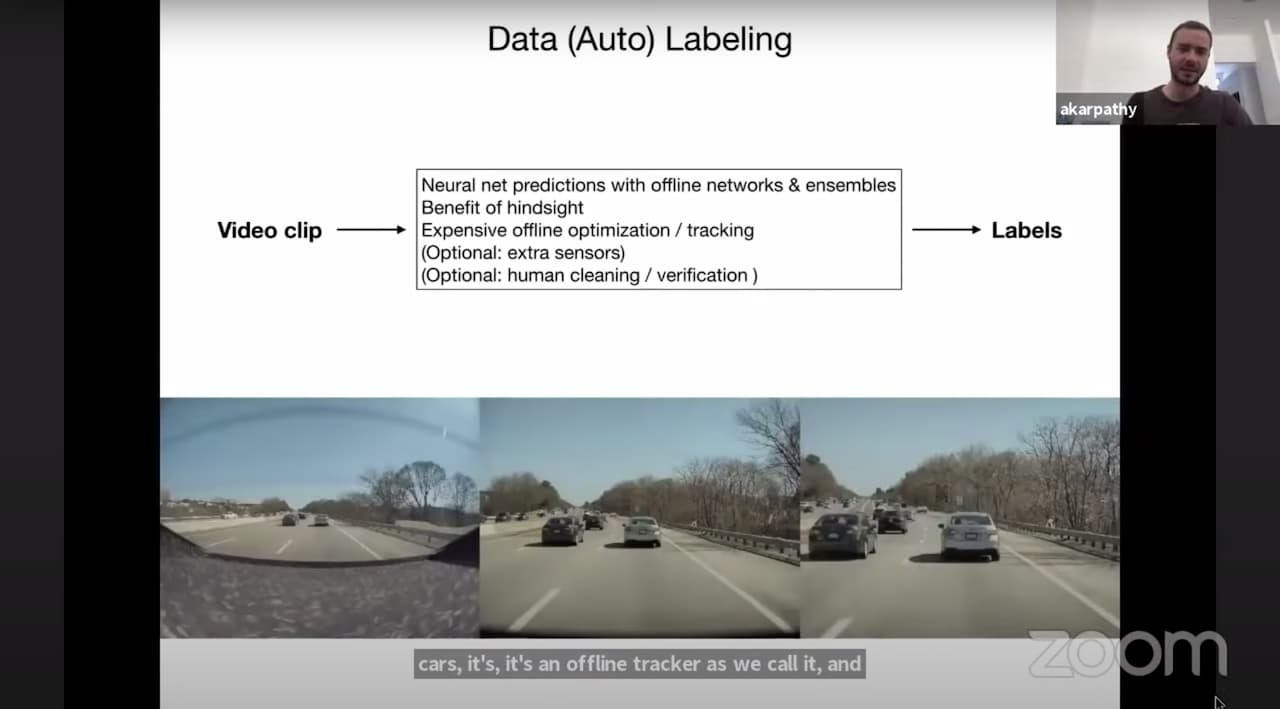

テスラのAIチームのゲームチェンジャーの一つは、自動ラベリングだったようだ。これは、テスラのカメラで車が撮影した何百万ものビデオから、道路の危険物などのオブジェクトを自動的にラベル付けするものだ。大規模なAIデータセットでは、多くの場合、手動でラベル付けを行う必要があるが、これには時間がかかる。特に、ニューラルネットワーク上の教師付き学習システムをうまく機能させるために必要な、きれいにラベル付けされたデータセットを得ようとする場合には、時間がかかってしまう。

Karpathyは、長年の研究の結果、この課題を教師付き学習問題として扱うことで実現できると考えている、と語った。Karpathyによると、この技術をテストしたエンジニアたちは、人口の少ない地域では何の介入もなく運転できることがわかったが、サンフランシスコのような非常に困難な環境では、間違いなく多くの問題が発生するという。このシステムが本当にうまく機能し、HDマップや追加のセンサーなどの必要性を軽減するためには、人口密度の高い地域への対応をもっとうまく行う必要がある。

レーダーはいらない、ではLiDARはどうか?

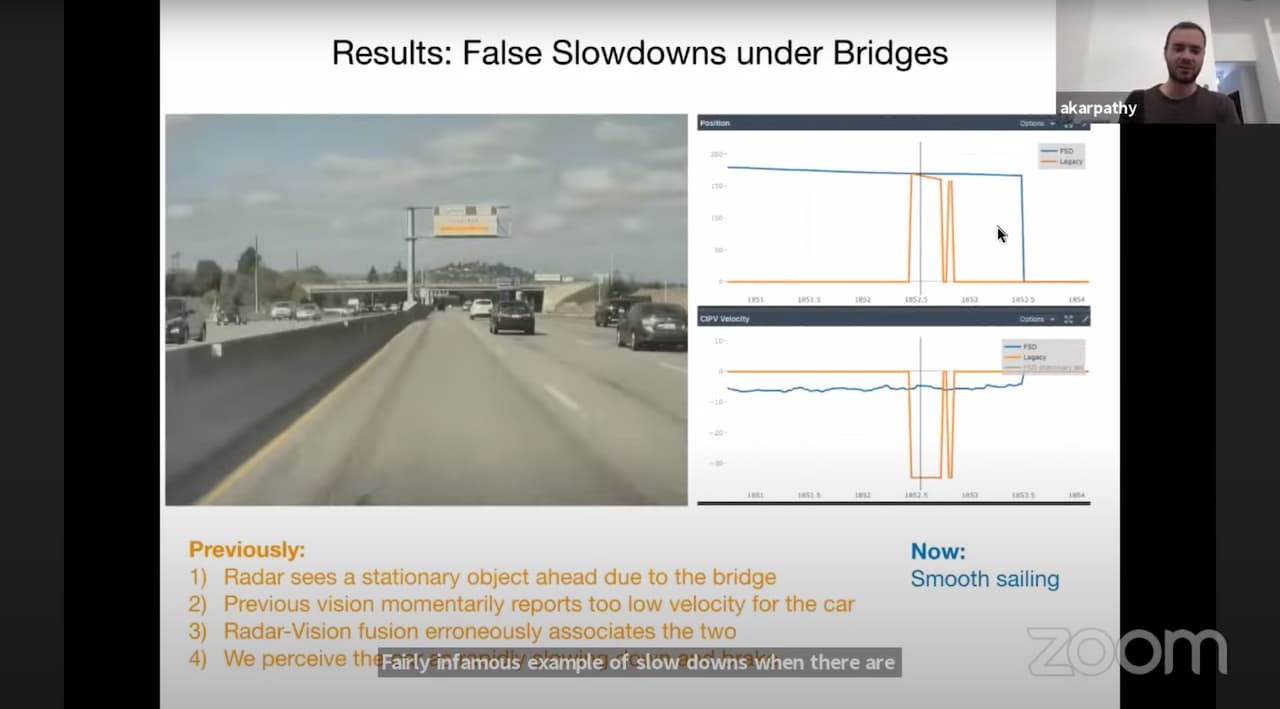

テスラは2021年5月の納入分から、北米市場向けのモデル3とモデルYには前方照射型レーダーセンサーを搭載することを中止した。レーダーは自ら電波を発射し、その反射波をとらえることにより、周囲の物体をとらえるものだ。

Karpathyは「イーロン・マスクが言っているのは、基本的には、ビジョンが、例えばレーダーよりも100倍優れたセンサーになってきているということだ。もし、あるセンサーが他のセンサーを圧倒し、非常に優れているとしたら、他のセンサーは、前者のシステムに実際に貢献し始めていることになる。だから、私たちはビジョンのみのアプローチをさらに強化している」と主張している。

テスラは、「完全自動運転」ソフトウェアのベータテストにおいて、ビジョンベースのオートパイロットの開発を進めてきた。しかし、レーダーセンサーがなくてもオートパイロットが完全に機能するようにするようにはなっておらず、これらの車両のいくつかの機能を無期限に制限または無効にしている。オートステア(カーブでも車線の中央を走ることができるオートパイロット機能)は、時速75マイル以下でしか使用できない。また、「前走車との最小追従距離が長い場合にのみ使用可能となる」とされている。

テスラは現在、高価なモデルであるセダンのModel SやSUVのModel Xからレーダーセンサーを取り除いていない。モデル3とモデルYの販売台数が圧倒的に多いため、まずはこの2つを専用のビジョンベースシステムに依存させることに注力しているという。「先にテスラビジョンに移行することで、大量の実世界のデータを短時間で分析することができ、結果的にテスラビジョンをベースにした機能の展開を早めることができる」と同社は記している。

他の自動車メーカーは、カメラ、レーダー、LiDAR(レーザー光を利用したレーダー)を組み合わせて、車の意思決定の判断材料となるデータを収集している。LiDARは高価なのであまり使われていないが、レーダーは安価なので広く使われている。

しかし、テスラはLiDARを搭載した手法を試しているようだ。5月、フロリダ州のパームビーチで、同地在住の自律走行車業界のコンサルタント、Grayson Brulteは、テスラのモデルYには、話題のセンサーメーカーLuminar社製のルーフトップライダセンサーが搭載されているのを撮影した。

Spotted in Palm Beach, Florida. A @Tesla Model Y with #LiDAR and CA Manufacturing (MFG) Plates. Can anyone offer details/insights? pic.twitter.com/5Uh4WU0U41

— Grayson Brulte (@gbrulte) May 20, 2021

ブルームバーグによると、Luminar社は、両社の契約の一環として、LiDARをテスラに販売した。また、モデルYには、カリフォルニア州でテスラに登録されているメーカーのナンバープレートが装着されていた。同じプレートは、サイバートラックの試作車を含む他のテスラ車でも目撃されている。

Eye Catch Image is courtesy of Tesla.

参考文献

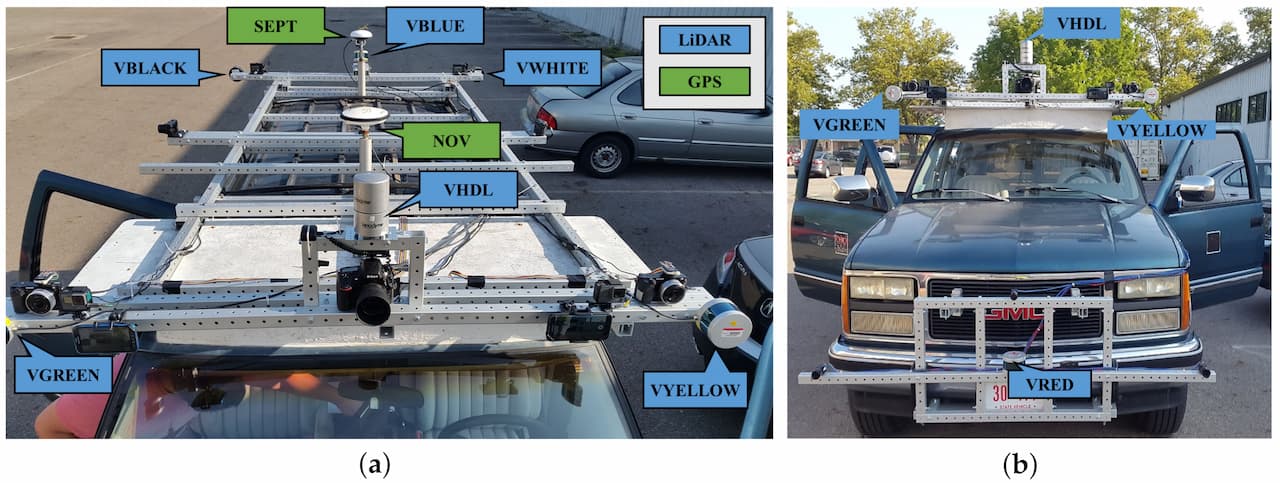

- Ilci V, Toth C. High Definition 3D Map Creation Using GNSS/IMU/LiDAR Sensor Integration to Support Autonomous Vehicle Navigation. Sensors. 2020; 20(3):899. https://doi.org/10.3390/s20030899

📨ニュースレター登録とアカウント作成

ニュースレターの登録は記事の下部にある「Sign up for more like this」か右上の「Subscribe」ボタンからサインアップをお願いします。あるいはこちらから。

Special thanks to supporters !

Shogo Otani, 林祐輔, 鈴木卓也, Kinoco, Masatoshi Yokota, Tomochika Hara, 秋元 善次, Satoshi Takeda, Ken Manabe, Yasuhiro Hatabe, 4383, lostworld, ogawaa1218, txpyr12, shimon8470, tokyo_h, kkawakami, nakamatchy, wslash, TS, ikebukurou 黒田太郎, bantou, shota0404, Sarah_investing, Sotaro Kimura, TAMAKI Yoshihito, kanikanaa, La2019, magnettyy, kttshnd, satoshihirose, Tale of orca.

寄付サブスク (吉田を助けろ)

吉田を助けろ(Save the Yoshi!)。運営者の吉田は2年間無休、現在も月8万円の報酬のみでAxionを運営しています。

月10ドル支援したいと考えた人は右上の「Subscribe」のボタンからMonthly 10ドルかYearly 100ドルご支援ください。あるいは、こちらからでも申し込めます。こちらは数量が99個まで設定できるので、大金を助けたい人におすすめです。

その他のサポート

こちらからコーヒー代の支援も可能です。推奨はこちらのStripe Linkです。こちらではない場合は以下からサポートください。

投げ銭