フィルターバブルの仕組み: レコメンドエンジンが生む情報の泡

フィルターバブルの人々をすでに信じている情報に晒し続けるメカニズムは、現代社会の大きな不確実要因になった。さまざまなインターネット製品が採用するパーソナライゼーションが、人々を限定された話題の情報にしか接しない状態にし、思想の自己強化サイクルに陥らせる。

要点

フィルターバブルの人々をすでに信じている情報に晒し続けるメカニズムは、現代社会の大きな不確実要因になった。さまざまなインターネット製品が採用するパーソナライゼーションが、人々を限定された話題の情報にしか接しない状態にし、思想の自己強化サイクルに陥らせる。

1. パーソナライゼーション技術の負の影響

ジャーナリストのイーライ・パリサーは2011年、パーソナライゼーション(個人化)技術の普及により、ネット利用者が多様な情報源や視点に接する機会が減らされている、と主張した。

彼は「フィルターバブル」という用語を生み出し、多様な視点やコンテンツから人々を効果的に隔離するオンラインパーソナライゼーションの可能性を説明した。神嶌敏弘、赤穂昭太郎、麻生英樹らの「情報中立推薦システム」(2012、産業技術総合研究所、筑波大学)によると、「パリサーはレコメンデーションエンジンなどの個人化技術により、利用者は知らないうちに、自身が関心があるとされる限定された話題の情報にしか接しないようになっており、まるで『泡』の中に閉じ込めらたような状態になっていると状況を描写する」という。神嶌らは、この結果、利用者が新たな話題に関心をもつ機会が奪われたり、社会の中での情報や認識の共有が困難になるなどの影響があると指摘している。

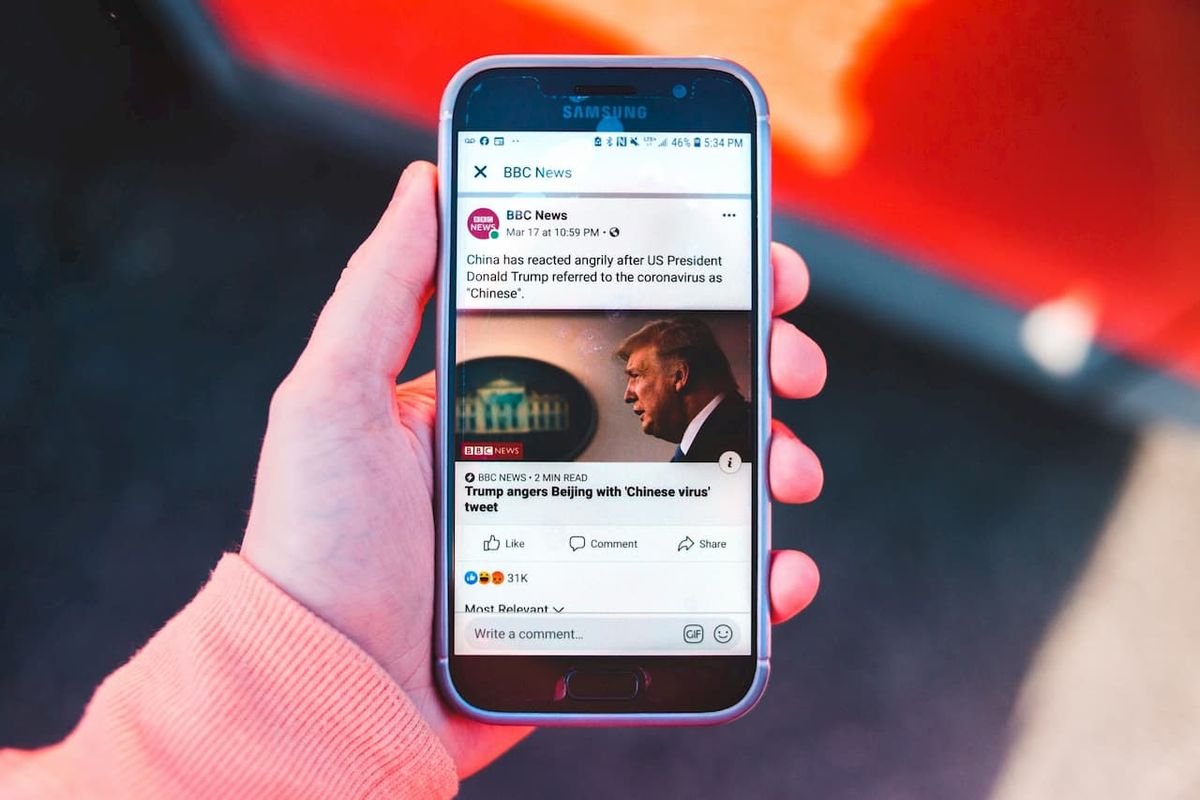

パリサ―はレコメンドによる情報の偏りの例として Facebookフィードの変化やGoogleの検索結果を挙げている。パリサーはFacebookフィードの例として自身の政治思想とは異なる人々とFacebookで交流したいと考えていたときの体験を挙げている。彼の交流の意思に反して、ある日、Facebookフィードから保守派の人たちが消えてしまった。その理由としてFacebookがパリサーの行動履歴を元にフィードの内容を利用者の好みに合うように変更していたためだった。パリサ―は実際には保守派よりリベラル派の友人のリンクをクリ ックしていることが多く、Facebookはパリサーのから許諾を取ることもなく配信から保守派の人たちを削除してしまった。

またGoogle検索の例では、パリサーは複数の友人に Google検索で「Egypt」と検索した結果を提供してもらい調査したところ、当時エジプトのデモは世界的に大きな話題になっていたが、ある友人の検索結果にはエジプトのデモに関する記事がほとんど表示されず、旅行に関する情報ばかりが表示されていたことを挙げている。このようにユーザが社会的に 問題のある情報に触れる機会が低下することは、社会で重要視されている情報が個々人で異なる状況を生み出し、社会的リアリティの共有が困難になる可能性がある、とパリサーは主張した。また提示される情報はユーザにパー ソナライズされたものであるため自身の考えと異なる他者との接触や新しい考え方に出会う機会を失わせる。そのため創造性やイノベーションの観点においても悪影響をおよぼす可能性があるかもしれない。

以前は、編集者がゲートキーパーの役割を果たしていたが、インターネットはそれを取り払い、代わりにアルゴリズムをゲートキーパーに変えた、とパリサーは説明します。アルゴリズムには編集者がもっていた倫理の役割を果たしていないことを彼は問題視した。

2. 機械学習研究者側のアプローチ

レコメンドシステムは、さまざまなオンライン製品で広く使用されている。このようなシステムでは、ユーザーの個人的な特性や過去の行動を利用して、ユーザーの好みに合わせた項目を個別にリスト化するため、ユーザーが新しい情報やアイテムを探索するコストを減らしている。このシステムは、ユーザーの便益に大きく寄与し商業的に非常に成功している。

ただし、商業インターネットの普及は、情報の洪水を引き起こしている。膨大な情報の全てを自身で網羅することは事実上、不可能であり、また、絶対的に客観的な観点も存在しないことから、フィルタリング技術の利用は避けられない、というのが、ミシガン大学のコンピュータ科学者のポール・レズニックらによるパリサーの主張への反応だった。同時に、彼らは、何かの情報を送ることは、他の情報を隠す ことに繋がり、本質的なトレードオフである、と指摘し、また、選択的露出は、FOXニュースの内容とアルジャジーラの内容が異なるように、パーソナライゼーション技術と関係なく存在する問題である、とも指摘した。

90年代から同様の問題を指摘してきたレズニックによると、既に信じていることを強化してしまうという「選択的露出」については、推薦システム研究者の間で研究がなされており、そのような傾向をもつ人も確かに存在するが、一方で影響されない人も確かに存在し、全体としては大きな影響にはならないとの見解が述べられた。

この2011年の議論の後も推薦システムとフィルターバブルの関連性の検証は続けられてきた。推薦システムの大家であるミネソタ大学のJoseph A. Konstanの率いるGroupLens研究チームのTien T. Nguyenらは、協調フィルタリング(訪問者と似た行動履歴を持つ利用者のデータを基に、訪問者が購入する可能性が高いアイテムをおすすめする手法)を採用する推薦システムがユーザーの触れるアイテムが狭められていることを発見した。ただし、Nguyenは推薦されているアイテムを実際に消費するユーザーがアイテムをより積極的に評価するという証拠も発見している。つまり、彼らはユーザーの触れるアイテムは推薦システムのせいで狭められているもののそれが彼らの満足感につながっている可能性があると主張している。

さらにNguyenは、推薦システムが実際にはユーザーが接触するコンテンツを狭めているのかを調査をした。Nguyenらは、レコメンドされたコンテンツを実際に利用する頻度に基づいて、ユーザーをカテゴリーに分類し、この分類により、同じシステムを利用している対照群と比較する、ランダム化対照実験(RCT)を実行した。その結果、レコメンドシステムが、ユーザーに提示されるアイテムの多様性を狭めていることを突き止めたものの、レコメンド内容を事前に想起していたユーザーは、その内容について好意的に捉えている、と彼らは結論づけた。つまり、この研究においては、フィルターバブルの存在らしきものはみとめられたものの、それは、「悪さ」をしていない、ということになったのだ。

3. レコメンドシステムのビジネスへの寄与

推薦システムがどれほど、大きな経済的インパクトがあるか。実際、すでに大手テクノロジー企業のビジネスに重要な役割を果たしている。たとえば、Amazonはかつて、売上の35%が推薦システムによるものだと報告したことがあり、2012年のNetflixの報告によると、ユーザーが見たものの75%は推薦システムによるものだった。

2015年のNetflixの研究チームによる推薦システムとビジネスの関連性を検証した論文によると、Netflixの一般的なメンバーは60〜90秒で視聴するタイトルを決定しないと、動画視聴に興味を失うことがリサーチの結果わかった。つまり90秒以内、具体的には1つまたは2つの画面10〜20タイトルの中でメンバーが興味をもつ動画を推薦する必要があるということだ

歴史的には、Netflixのレコメンド問題は、動画を見た人がその動画を見た後に評価する星の数を1から5までの尺度で予測する問題に相当すると考えられてきた。確かに、本業がDVDの郵送だった以前は、星の評価が会員が実際に動画を見たかどうかの主なフィードバックだったこともあり、このようなアルゴリズムに大きく依存していた。しかし、その後ビジネスがDVD郵送からストリーミングに移行し、推薦システムが社内で改良され視聴率予測の精度向上を目的としたコンテストを開催したこともあり、現在でも視聴率予測のためのアルゴリズムをコンテンツ制作に使用している。このアルゴリズムは有名な2009年のNetflix Prizeで提案されたものだ。

しかし、Netflixのレコメンデーションの焦点がスターやDVDだった時代はとっくに過ぎ去っている。現在では、コンテンツをストリーミングし、Netflixの各会員が何を視聴しているか、各会員がどのように視聴しているか(デバイス、時間帯、曜日、視聴の強度など)、製品内で各動画が発見された場所、さらには各セッションで表示されたが再生されなかったレコメンデーションまでを記述した膨大な量のデータを持っている。これらのデータとNetflix製品を改善した経験から、予測される星の数が多い動画だけに焦点を当てるよりも、視聴する動画を見つけるのにはるかに良い方法があることがわかった。

レコメンドシステムは、Netflixの体験を総合的に定義するさまざまなアルゴリズムで構成されており、ユーザーが最初に観る画面に、8つのレコメンドシステムが使われている。これは、Netflix会員がどのデバイス(テレビ、タブレット、携帯電話、ブラウザ)でもNetflixのプロフィールにログオンした際に最初に目にするページであり、上述の通り、Netflixでストリーミングされた3時間のうち2時間がレコメンドしたコンテンツによって消費されている。

4. 自己強化的なフィードバックループ

しかし、再び推薦システムの副作用に光が当てられた。Googleの子会社であるDeepMindの研究者Ray Jiangらは2019年の3月に、推薦システムにおけるエコーチェンバー効果とフィルターバブル効果の理論的解析を行った。Jiangらは推薦システムとユーザーの間のフィードバックループは、「エコーチェンバー」と「フィルターバブル」を発生させ、ユーザーのコンテンツへの露出を狭め、最終的に彼らの世界観を変えてしまう可能性があると主張した。

この論文では、エコーチェンバーとは、ユーザーが類似コンテンツに繰り返しさらされることで、関心が強化される現象を指すと定義されている。一方、フィルターバブルは、ユーザーがさらされるコンテンツの領域が狭まる現象を指すと定義される。両者は区別されるものの同類である、とJiangらは判断している。

推薦システムの動作がフィルターバブルを生成する際の影響を調査するために、 Jiangらは、ユーザーの関心が縮退するダイナミクスを持っていると仮定し、主に物理学的な観点からダイナミクスのさまざまなモデルを検討した。Jiangらは、推薦システム側には、システム設計において縮退速度に影響する3つの独立した要因、つまりモデルの精度、探索量、および候補プールの成長率があることを特定した。

それから、 Jiangらはいくつかの古典的なバンディットアルゴリズムを使用したシミュレーションで、ユーザーのダイナミクスとレコメンダーシステムの動作の相互作用を確認した。確かにエコーチェンバーやフィルターバブルのような現象が起きていた。

研究チームは興味深い提案をしている。フィルターバブルやエコーチェンバーに対抗する最適な方法は、より「探索的な推薦アルゴリズム」を設計することである。ユーザーの関心があまり確かでないものを表示してユーザーの関心を広げるようにすることだ。「システムの縮退に対する最善の解決策は、連続的なランダム探索と候補プールの少なくとも直線的な成長」と論文は指摘する。

Jiangらは彼らのシミュレーションには2つの制約があることに言及している。第一に、ユーザーの関心は直接観察されない隠された変数であるため、縮退を確実に研究するためには、実際にはユーザーの関心に対する適切な尺度が必要ということ。第二に、アイテムとユーザーは互いに独立していると仮定したが、現実の社会はアイテムとユーザーはその相互依存をもっている。彼らは将来の研究で、相互に依存する可能性のあるアイテムとユーザーの場合に分析を拡張するという。

参考文献

- Eli Pariser, Dr Ellen Helsper. The Filter Bubble: What The Internet Is Hiding From You. 2011.

- イーライ・パリサー, 井口 耕二. 閉じこもるイン ターネット — グーグル・パーソナライズ・民主主義. 早川 書房 (2012).

- Tien T. Nguyen Pik-Mai Hui F. Maxwell Harper Loren Terveen Joseph A. Konstan. Exploring the filter bubble: the effect of using recommender systems on content diversity. 2018.

- Ray Jiang, Silvia Chiappa, Tor Lattimore, Andras Gyorgy, Pushmeet Kohli. Degenerate Feedback Loops in Recommender Systems. 2019.

- Carlos A. Gomez-Uribe, Neil Hunt. The Netflix Recommender System: Algorithms, Business Value, and Innovation. ACM Transactions on Management Information SystemsDecember 2015 Article No.: 13

- Panel on The Filter Bubble. The ACM Recommender Systems Conference Blog. Oct, 2011.

- Tien T. Nguyen, Pik-Mai Hui, F. Maxwell Harper, Loren Terveen, Joseph A. Konstan. Exploring the Filter Bubble: The Effect of Using Recommender Systems on Content Diversity. WWW '14: Proceedings of the 23rd international conference on World wide web. April 2014.

- 神嶌 敏弘. 赤穂 昭太郎. 麻生 英樹. 佐久間 淳. 情報中立推薦システム. 2012.

- デイヴィッド・サンプター. 数学者が検証! アルゴリズムはどれほど人を支配しているのか? あなたを分析し、操作するブラックボックスの真実. 2019

Special thanks to supporters !

Shogo Otani, 林祐輔, 鈴木卓也, Mayumi Nakamura, Kinoco, Masatoshi Yokota, Yohei Onishi, Tomochika Hara, 秋元 善次, Satoshi Takeda, Ken Manabe, Yasuhiro Hatabe, 4383, lostworld, ogawaa1218, txpyr12, shimon8470, tokyo_h, kkawakami, nakamatchy, wslash, TS, ikebukurou 太郎.

月額制サポーター

Axionは吉田が2年無給で、1年が高校生アルバイトの賃金で進めている「慈善活動」です。有料購読型アプリへと成長するプランがあります。コーヒー代のご支援をお願いします。個人で投資を検討の方はTwitter(@taxiyoshida)までご連絡ください。

投げ銭

投げ銭はこちらから。金額を入力してお好きな額をサポートしてください。