自律走行に伴うエッジコンピューティングの進化

ADAS(先進運転支援システム)と自律運転の人気に伴い、車載型システムオンチップ(SoC)の計算ニーズは、自動車用半導体を非常に高度なプロセス・ノードに押し上げている。レベル3の機能を実現するには、センサ・フュージョン(ビジョン、レーダー、超音波、LiDAR)が必要だ。

ADAS(先進運転支援システム)と自律運転の人気に伴い、車載型システムオンチップ(SoC)の計算ニーズは、自動車用半導体を非常に高度なプロセス・ノードに押し上げている。レベル3の機能を実現するには、センサ・フュージョン(ビジョン、レーダー、超音波、LiDAR)が必要だ。それを超えるためには、知覚、コンピュート、意思決定のためのエッジ上のAI推論が必要になる。

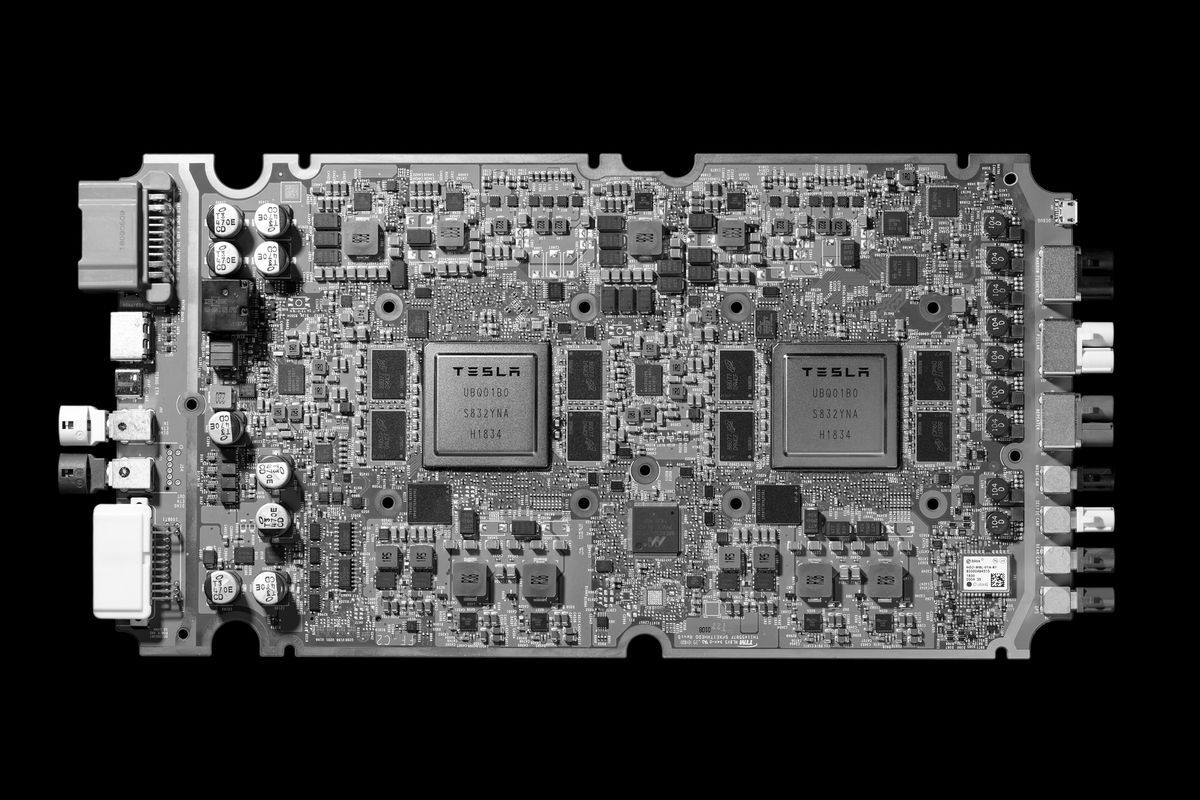

一部のOEMは、これらの研究開発努力を差別化し、ゲームを変えるものと認識しているため、先進的なSoCを自ら設計し始めている。例えば、テスラは自社設計の「HW3.0」を展開しており、Model 3とModel Sの両方に搭載して出荷している。

他の自動車メーカーと比較してテスラがユニークなのは、2019年初頭からテスラが運転支援システム用のチップの設計を完全に内製化していることだ。 メーカーはしばらく前から「フルオートパイロット」の登場を約束していたが、それが本当に実現するのは、SoCやアルゴリズムの性能向上を待たないといけない。

2019年からテスラは、2016年初頭に着任し、2018年4月にインテルに転向した元AMDのエンジニア(ジム・ケラー)らの手腕により、テスラが自社開発した「ハードウェア3.0」(HW3.0)と呼ばれるSoCを車両に搭載している。 テスラのそれまでのSoCは、Nvidia社製のチップをベースにしていた。 機密情報源を引用した中国时报によると、テスラは米Broadcomとの提携により、HW4.0の生産に近づいているという。 チップを生産するのは台湾のTSMCで、現行のHW 3.0はSamsungが生産している。

WikiChipによると、HW3.0の設計チームは2016年2月に結成された。開発は18カ月間に渡って行われた。2017年8月、最初のチップがリリースされ、2017年12月に最初のシリコンが完全に動作するようになったが、多くの追加修正が必要となったという。次のバージョンは2018年4月に製造用にリリースされた。2018年7月に完全生産が開始されると、2018年12月、テスラは新しいハードウェアとソフトウェアスタックを搭載した試作車の開発を開始した。2019年3月、テスラは、HW3.0を搭載したモデルSとモデルXの量産出荷を開始した。モデル 3での生産出荷は2019年4月に開始された。

テスラがファウンドリにTSMCを選んだのは、当時、7nmアーキテクチャのプロセッサを問題なく生産できる唯一の企業だったからだろう。この技術を使えば、より多くのトランジスタを内蔵した小型のチップを作ることができ、消費電力を抑えることができるかもしれない。7nmの製造プロセスに加えて、TSMCはテスラにもう一つの興味深い製造技術を提供している。それは、いわゆる integrated fan-out(InFO)と呼ばれるものだ。この超薄型パッケージ「InFO」は、厚みがわずか0.5mmしかない薄さと、基板がないことによる材料コストの削減、ウェハレベルの一括生産による製造コストの低減を両立させた、優れたパッケージである。この技術により、HW 4.0は物理的に小型化され、消費電力の低減とオーバーヒートの問題の低減を実現するとされる。 最終的にHW 4.0は5Gネットワークに対応することになる。

高い自律性を実現するためには、ハードウェアは多くのことをしなければならない。カメラからすべてのデータを受信し、自動操縦を管理するためにそれらを処理し、バッテリーから電気モーターへの電源供給を管理する(したがって、パフォーマンス、パワー、自律性に影響を与える)、インフォテインメントシステムを管理し、車内のすべての電子制御されたものを管理する。

HW2.0からHW3.0への移行において、テスラによれば、新しいチップは毎秒21倍のフレーム数、全体では40倍のデータを処理することができ、その結果、消費電力と発熱がわずかに増加しただけだという。また、マスクは、完全自律運転にはこのハードウェアで十分だと述べているが、この運転はまだ本当にテスラの目標に到達していない。マスクは、HW 4.0は第3世代チップの3倍の性能を持つと述べている。

半导体行业观察によると、TSMCは2020年の第4四半期にHW 4.0向けの新チップの実生産を開始する予定を持っていた。 しかし、生産開始時点では工程を微調整しなければならず、生産量は非常に低いと予想される。 最初に生産されたチップはロードテストに使用され、その後設計の修正が求められるだろう。HW 4.0を搭載したテスラが市場投入されるには2022年初頭まで待たなければならないかもしれない。

NVIDIA

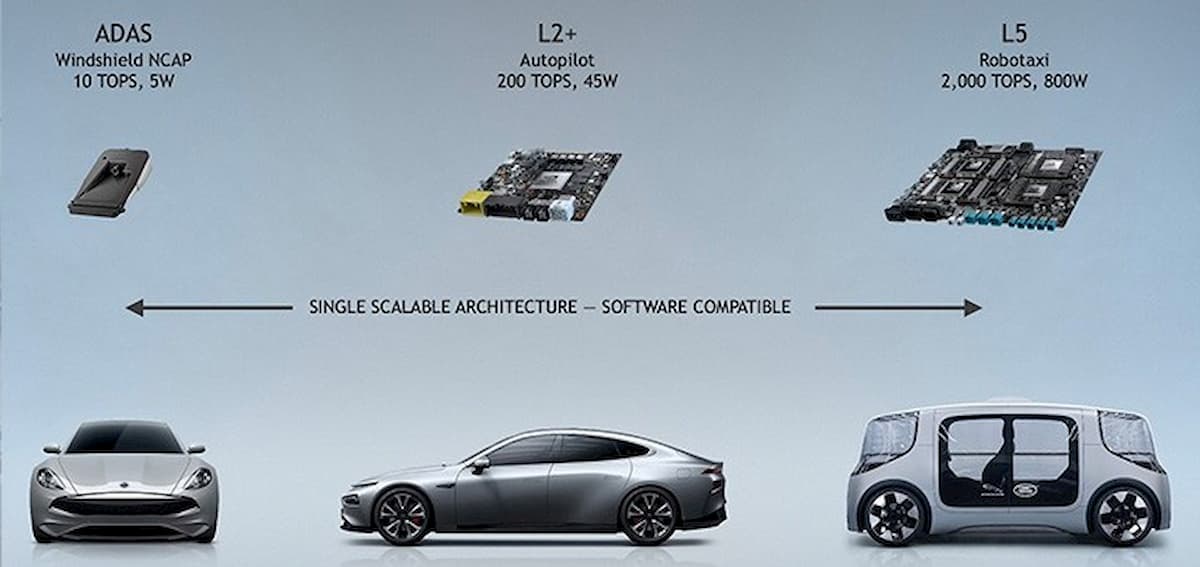

テスラがHW3.0を発表したのは2019年の春だったが、NVIDIAはその年の暮れに行われたGTC China 2019で次世代の自動運転車プラットフォーム「NVIDIA DRIVE AGX Orin」の市場投入計画を発表した。ジェン・スン・ファンCEOは、Orinは最大170億個のトランジスタ、8コアの64ビットCPU、200TOPSのディープラーニング演算能力をもち、前世代のXavierの7倍となる毎秒254兆回/秒(TOPS)の演算を実現すると主張した。

Orinは、自律走行レベルL2からL5までに対応している。多くのOEMは一世代前のXavierの助けを借りてサラウンドカメラビューと車線変更を処理しているが、Orinは、Xavierと後方互換性のあるCUDAとTensorRT APIならびにライブラリを通じてプログラムできるので、開発者は複数の製品世代にわたって投資を活用できる。

Orinは、自動運転車やロボットなどで同時に実行される多数のアプリケーションやディープニューラルネットワークに対応している。このプロセッサは、複数の高速センサーを扱い、環境を感知し、周囲のモデルを作成し、特定の目標に基づいて適切な行動戦略を展開するために自らを配置するように設計されている。NVIDIAのソリューションはLiDARやその他のセンサーもサポートしている。

NVIDIAは2020年5月には、Ampere GPUを活用し、DRIVE AGX プラットフォームの機能を拡張すると発表した。機能拡張の対象には完全自律走行を前提としたロボタクシープラットフォームが含まれている。これは、2つのOrin SoCと2つのNVIDIA Ampere GPUが実装され、前例のない2,000兆オペレーション / 秒 (TOPS)を実現し、完全自動運転のロボタクシー運用に必要な、より高い解像度のセンサー入力と、より高度な自動運転ディープニューラルネットワーク(DNN)を処理することができ、それはこれまでのプラットフォームの6倍以上のパフォーマンスに相当する、と同社はマーケティングしている。

中国EV新興企業NIOは、2021年1月9日、スーパーコンピュータ「Adam」を新型セダンに搭載することを明らかにした。Adamは4つのNVIDIA Orinプロセッサから成り立っており、市販車では前例のない毎秒1,000兆回(TOPS)以上の演算を実現するという。4つのOrinのうち、最初の2つは、車両のセンサーセットから生成される8ギガバイト / 毎秒のデータを処理する。3番目のOrinは、どのような状況でもシステムが安全に運転できるようにバックアップの役割を果たし、4番目のOrinはローカルトレーニングを可能にし、分散協調学習で車両制御を改善したり、個々のユーザーの好みに基づいて運転体験をパーソナライズしたりするという。

自律走行には専用のチップが必要

自律走行は、今後5年間で半導体にとって最も重要なアプリケーションの1つである。自律走行システムに搭載される人工知能(AI)チップは、最も重要なコンポーネントであると同時に、SoC設計者にとって新たなチャンスでもある。テスラに牽引されて、ここ数年で多くのベンダーが自律走行用チップの設計競争に参加している。人工知能アルゴリズムを得意とするスタートアップ企業も、巨大なチップベンダー(NVIDIA、インテル、クアルコム)もこの機会に自分たちの能力を発揮したいと考えている。

レベル3以上の自律運転システムでは、より多くのセンサー(カメラ、LiDAR、レーダーなど)を使用して、車の周囲の3Dモデルを再構築する。システムからの指示に基づいて、自動的に対応する行動をとる。収集した情報を他の全車両のデータと組み合わせることで、アルゴリズムを継続的に改善することができ、同じ駆動システムを使用する全車両にアップデートが反映される。

カメラは、自律走行システムにとって重要なセンサーだ。カメラで撮影した画像 / 映像を人工知能チップで処理し、車両周辺の環境を識別・解釈して判断する必要がある。例えば、レベル2システムに搭載されているLKA(レーンキーピングシステム)のように、ラインマーキングを検出し、人間の介入なしに車線内を集中的に自動走行するように車両を制御することだ。チップの処理能力とそれに付随するアルゴリズムによって、車の自律走行能力が決定される。

自律運転や高度な運転支援に必要なレイテンシーが低いため、車載ハードウェア上で動作する畳み込みニューラルネットワーク(CNN)によるディープラーニング(深層学習)が必要だ。高速でよく訓練された深層学習システムでなければ、人間の運転手が事故を回避するために行うような瞬時の判断を行うことができず、効果的な自律運転システムとして機能することはできない。

古典的なルールベースのソフトウェアを実行するために設計されたコンピュータでは、これは実現できない。最先端のディープラーニングをデータセンターの外にあるデバイスに、リーズナブルな電力とコストで持ち込むことを可能にする、専用のSoCが必要となる。

例えば、車両に搭載されたフルハイビジョンカメラからのディープラーニングを使ったデータをフル解像度でリアルタイムに処理するには、データセンター規模のGPUをフルに使用しなければならず、1センサーあたり100ワット以上の消費電力を必要とすることが挙げられる。

これらのAI処理を車載コンピュータ上で実行するには、いくつかの課題がある。第一に、多くのAI処理、特に車両内の処理は、計算量が多く、リアルタイム性に厳しい要件を持っている。例えば、ビジョンベースの物体検出タスクの計算遅延は、車両の安全性に直結している可能性がある。そのためには、高い計算能力とタイミングを保証する手段が必要となる。第二に、ハードウェア・プラットフォームは、コスト、サイズ、重量、電力の制約を満たさなければならず、高効率のプラットフォームが必要となる。これら2つの相反する要件は、プラットフォームの選択プロセスを複雑にしている。

Special thanks to supporters !

Shogo Otani, 林祐輔, 鈴木卓也, Mayumi Nakamura, Kinoco, Masatoshi Yokota, Yohei Onishi, Tomochika Hara, 秋元 善次, Satoshi Takeda, Ken Manabe, Yasuhiro Hatabe, 4383, lostworld, ogawaa1218, txpyr12, shimon8470, tokyo_h, kkawakami, nakamatchy, wslash, TS, ikebukurou 太郎.

月額制サポーター

Axionは吉田が2年無給で、1年が高校生アルバイトの賃金で進めている「慈善活動」です。有料購読型アプリへと成長するプランがあります。コーヒー代のご支援をお願いします。個人で投資を検討の方はTwitter(@taxiyoshida)までご連絡ください。

投げ銭

投げ銭はこちらから。金額を入力してお好きな額をサポートしてください。

https://paypal.me/axionyoshi?locale.x=ja_JP

Image Credit: Full Self-Driving Chip(FSD Chip、あるいはAutopilot Hardware 3.0)via Tesla.

参考文献

- モバイル端末向けパッケージング技術「FOWLP」(後編) (1/2)

- AnandTech, Hot Chips 31 Live Blogs: Tesla Solution for Full Self Driving.

- Sorin Grigorescu et al. A Survey of Deep Learning Techniques for Autonomous Driving. Journal of Field Robotics, Online ISSN:1556-4967, 2019. DOI:

- NVIDIA, NVIDIA DRIVE が Ampere でさらに加速: スケーラブルなプラットフォームがNVIDIA Ampere アーキテクチャに対応.