金融業界への大規模言語AIの応用可能性は大いにある

銀行ではディープラーニングの導入ギャップがあり、その結果、ビジネスニーズを満たすのに十分な速さでAIモデルを構築・導入できていない。これらを解決するための自然言語処理モデルとハードウェアの組み合わせが提案されている。

AIチップとシステムのスペシャリストであるSambaNovaは、金融サービス業界におけるGPTモデルの導入を簡素化し、迅速に行うことを目的とした新サービス「SambaNova GPT Banking」を2月下旬に発表した。この新サービスは、SambaNovaが展開する「dataflow-as-a-service」(データフロー・アズ・ア・サービス)商品群の一部として現在提供中ですが、価格は公表されていない。

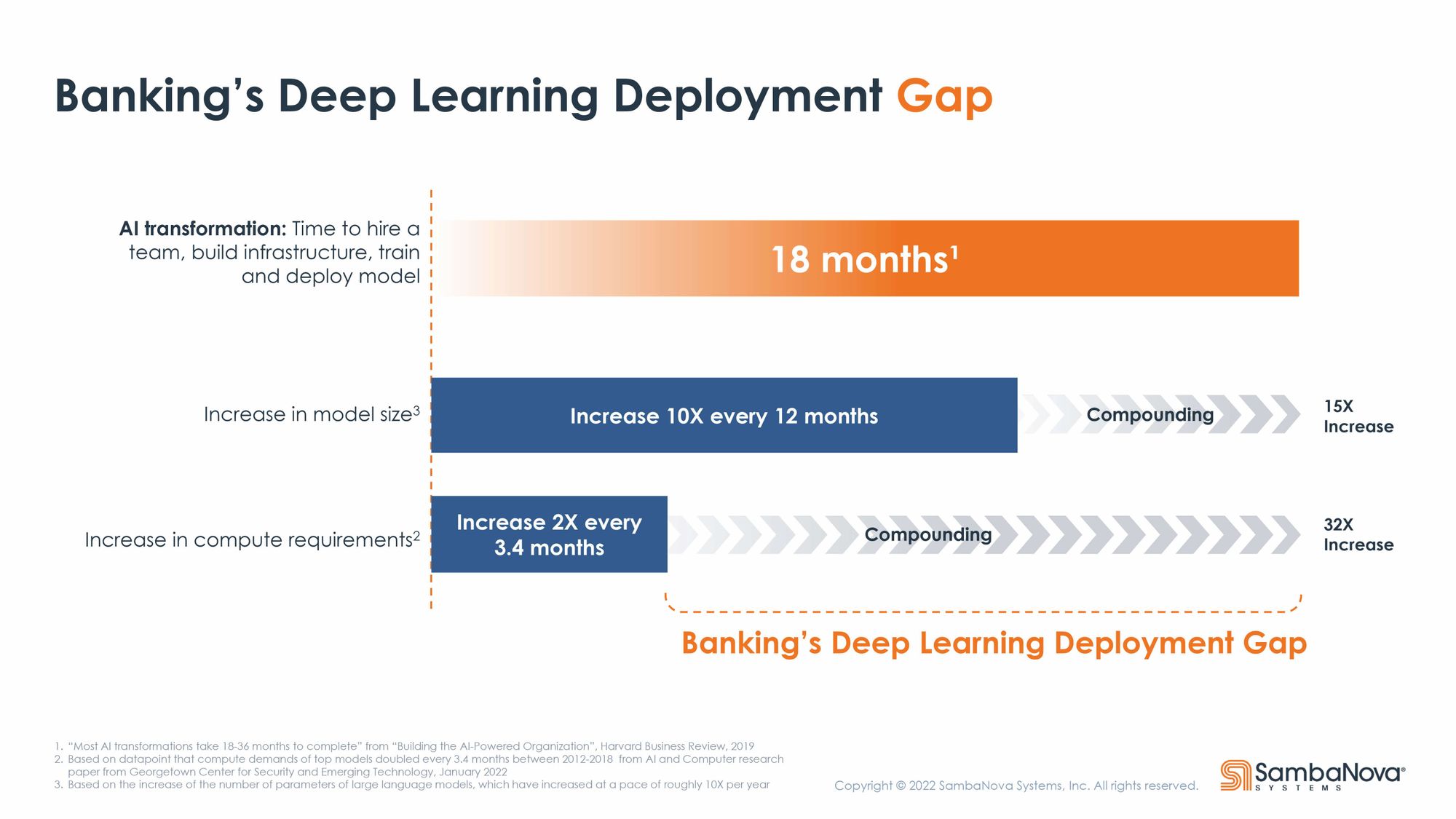

銀行ではディープラーニングの導入ギャップがあり、その結果、金融サービス企業はビジネスニーズを満たすのに十分な速さでAIモデルを構築・導入することができていない。

銀行が熟練したデータサイエンスチームを雇用し、インフラを構築し、大規模な言語モデルをトレーニングして導入するには、平均して18カ月かかる。銀行は、熟練したデータサイエンスチームを雇用し、インフラを構築し、大規模な言語モデルをトレーニングしてデプロイするまでに、平均して18ヶ月を要する。デプロイの準備が整う頃には、その機関のモデルは時代遅れになっている。

SambaNova GPT Bankingはこの問題の解決手段を提供すると息巻いている。「AIは今日、そのための最も迅速でコスト効率の高いツールであり、我々のサービスは数週間で展開し、価値を提供することができる」とSambaNovaのCEO兼共同設立者のロドリゴ・リャンは語っている。

GPT Bankingは、銀行が保有する大規模な言語モデル向けに構築されており、最先端の言語モデルを短時間で導入するプロセスを簡素化するためのサブスクリプションサービスとして提供されている。銀行はこの技術を活用して以下のことを行うことができる

- センチメント分析:ソーシャルメディア、報道、ブログをスキャンし、市場、投資家、ステークホルダーのセンチメントを把握する。

- エンティティ認識:ヒューマンエラーを減らし、ドキュメントを分類し、手作業や繰り返しの作業を減らす。

- 言語生成:クレームの処理、転記、優先順位付けを行い、必要な情報を抽出してドキュメントを作成し、顧客満足度を向上させる。

- 言語翻訳:言語翻訳を行い、顧客基盤を拡大する。

SambaNovaはGPT-3の機能を活用することで、例えば、ヘッジファンドによるリスクに関する意思決定を助けることができると期待している。同社のGPT Bankingプラットフォームの一般ユーザーは、ハンガリーのOTP銀行で、プロトタイプを導入している段階だという。

SambaNovaが提案するオンプレミス型の導入モデルは、データ管理に厳しい規制のある業界で好まれる手法として浮上している。銀行の分野ではセキュリティが常に懸念されるが、SambaNovaはサービスが適切な規制と慣行をすべて遵守していると確信している。

GPTのような大規模モデルのAI技術の使用を主流にすることは、少なくとも今のところ、X-as-a-serviceのアプローチに適していると思われる。SambaNovaは、インフラではなく機能を強調するための記述として、dataflow-as-a-serviceを好む。それはまだ安価ではないが、展開するのはかなり簡単で速い。

GPT(generative pre-trained transformer)モデルは、近年、その規模と効果が急上昇している。GPTの王者として君臨するOpenAIのGPT-3は、1,750億個の機械学習パラメータを搭載している。GPTモデルは、自然言語処理(NLP)において非常に有効であることが証明されており、新しい応用先が次々と登場している。

毎月70本のハイエンド記事が読み放題の有料購読が初月無料

アクシオンではクイックな情報は無料で公開していますが、より重要で死活的な情報は有料会員にのみ提供しております。有料会員は弊社オリジナルコンテンツに加え、ブルームバーグ、サイエンティフィック・アメリカン、ニューヨーク・タイムズから厳選された記事、月70本以上にアクセスができるようになります。現在、初月無料キャンペーン中。下の画像をクリックしてください。