生体認証による市民監視は不可避

「バイオメトリクスの規制」と題したAI倫理研究機関「AI Now」の新しい報告書では、「バイオメトリクスの規制。グローバルなアプローチと緊急の質問」と題された新しい報告書の中で、AI Now Instituteは、規制擁護派がバイオメトリクスの監視状態は避けられないと考え始めていると述べています。

「バイオメトリクスの規制」と題したAI倫理研究機関「AI Now」の新しい報告書では、「バイオメトリクスの規制。グローバルなアプローチと緊急の質問」と題された新しい報告書の中で、AI Now Instituteは、規制擁護派がバイオメトリクスの監視状態は避けられないと考え始めていると述べている。

報告書の発表は、これ以上に時宜を得たものではない。パンデミックが秋に引きずられる中、企業、政府機関、学校は公共の安全を確保するソリューションを求めて必死になっている。入口での体温の追跡から健康ウェアラブルの発行、監視用ドローンや顔認識システムの採用に至るまでの対策で、個人の権利や自由と生体情報の収集のバランスをとる必要性がこれまで以上に高まったことはない。一方で、一見良心的に見えても、問題のある、あるいは悪用される可能性さえあるようなバイオメトリクス主導の製品やサービスを販売する企業が増えている。

監視資本主義(サーベイランスキャピタリズム)は、個人が反撃する勇気を失わせるために、避けられないものとして提示されている。COVID-19が世界中に広がり続けているので、それは特に簡単な錯覚である。人々はすぐにでも解決策を求めている、たとえそれが将来的に新たな問題や長引く可能性のある問題を容認することを意味していたとしてもだ。

バイオメトリクスデータの収集や監視に関しては、何が倫理的で安全で合法的なのか、またどのような法律や規制が必要なのか、明確になっていないことがよくある。AI Nowの報告書では、これらの課題を体系的に整理し、なぜ重要なのかを説明し、解決策を提唱している。さらに、学校でのバイオメトリクス監視、米国と英国での警察による顔認証技術の利用、オーストラリアとインドでのバイオメトリクス情報の一元化に向けた国の取り組みなどを検証した8つのケーススタディを通じて、形と実体を提供している。

政治家、起業家、技術者だけでなく、すべての市民が、バイオメトリクス、AI技術、監視をめぐる問題を理解する必要がある。急速に変化している状況の中で、この報告書は、今後も生じ続ける新たな疑問を理解するための参考資料となり得る。111 ページの文書全体を数百語で要約するのは不公平であるが、いくつかの大まかなテーマに触れている。

データ、権利、監視に関連する法規制は、生体認証を収益化したり、政府の追跡のためにそれらを適応させたりする様々なAI技術の開発と実装に遅れをとっている。これがクリアビューAIのような企業が繁栄している理由です。彼らが行うことは多くの人にとって不快であり、倫理的ではないかもしれませんが、一部の例外を除いてはまだ合法だ。

バイオメトリクスデータの定義は非常に不安定なままであり、一部の専門家は、我々は新しい法律を作成し、改革や他のものを更新しながら、これらのシステムの実装を一時停止したいと考えている。また、ガードレールがあっても永久に危険なものがあるという理由で、システムを完全に禁止しようとする専門家もいる。

この技術を効果的に規制するためには、一般市民、民間企業、政府は、生体認証を含むデータを利用したシステムとその固有のトレードオフを十分に理解する必要がある。報告書は、「プライバシーやデータ保護権の侵害は必要であり、使用される手段と意図された目的の間で適切なバランスをとる」ことを提案している。このような比例性とは、「プライバシーへの権利が競合する権利や公共の利益とバランスが取れている」ことを保証することも意味する。

このことは、ある状況が生体情報の収集を全く正当化するかどうかという問題を提起している。また、これらのシステムに「機能のクリープ」がないかどうかを監視し、データが本来の意図を超えて使用されていないかどうかを確認する必要がある。

この報告書では、スウェーデンの学校で生徒の出席状況を追跡するために使用された顔認証の例について考察している。スウェーデンのデータ保護局は最終的に、顔認識は目の前のタスクには負担が大きすぎるという理由で、この技術を禁止しました。このようなシステムでは、多くの子供や教師に関する豊富なデータが取得されます。このようなシステムは、多くの子どもや教師に関する豊富なデータを収集しているが、そのデータは他に何のために、誰に使われるのだろうか。

ここで、安全性とセキュリティに関するレトリックが用いられる。スウェーデンの学校の例では、顔認証の利用がいかに比例性の原則に沿っていないかが容易にわかる。しかし、レトリックが安全とセキュリティに関するものであれば、反発することは難しくなる。システムの目的が出席率を取ることではなく、むしろ武器をスキャンしたり、キャンパス内にいるはずのない人を特定することであれば、話は変わってくる。

人々を安全に仕事に復帰させ、COVID-19から帰国した学生や教職員を守る必要性についても同じことが言える。人々は、パンデミック統計になるリスクを減らしながら生活を維持することを意味するのであれば、より侵襲的で広範な生体認証監視に従順である。

より多くのセキュリティイコールより多くの安全という単純化された立場にデフォルトするのは魅力的だが、その論理は実生活でのアプリケーションでは崩壊する可能性がある。まず第一に、誰のためのより多くの安全か。難民が国境で生体認証データを大量に提出しなければならなかったり、市民権擁護者が抗議権を行使している間に顔認証を受けたりした場合、誰の安全が守られるのだろうか。

そして、そのような状況でセキュリティの必要性があるとしても、強化された監視は、自由の範囲に凍りつくような影響を与える可能性がある。命からがら逃げている人々は、亡命という侵略的な条件に嫌悪感を抱くかもしれない。抗議者は自由に発言することを恐れ、民主主義そのものを傷つけることになるかもしれない。そして子供たちは、学校が脅威にさらされていることを常に思い知らされることで苦しむことになるかもしれず、それは精神的な幸福と学習能力を妨げることになる。

関連する問題としては、インドで物議を醸しているアーダハーの生体認証プロジェクトの事例で報告書が例示しているように、これらのシステムが導入された後でしか規制が行われない可能性があるということである。

報告書は、このプロジェクトを「インドに居住するすべての個人のバイオメトリクス情報(指紋、虹彩スキャン、写真)を保存し、人口統計情報と固有の12桁の『Aadhaar』(アードハール)番号と一緒にインデックス化する集中データベース」と説明している。このプログラムは何年にもわたって、適切な法的なガードレールなしで実行されていた。結局、新しい規制を利用してシステムを後退させたり、その欠陥や危険性に対処したりする代わりに、法律家は基本的に法律を適合させるように調整し、それによって後世に問題をエンコードした。

さらに、ある対策がどれだけ効果があるのか、それが役に立つのかどうかという問題もある。AIのバイアスに関する研究や、いつ、どこで、どのようにして、そのバイアスが技術的な失敗を引き起こし、悪用につながるのかの例で、論文全体を埋め尽くすことができます。モデルがベンチマークされたとしても、そのスコアは実世界でのパフォーマンスを反映していない可能性があると報告書は指摘している。データ処理、製品設計、配備の複数のレベルでAIにおけるバイアスの問題を解決することは、この分野が今日直面している最も重要かつ緊急の課題の1つ。

人間をループに入れておくことは、AIが咳き込むエラーを軽減するための1つの方法だ。警察署では、警官がデータベースに対して画像を実行した後に、バイオメトリクススキャンがリードを提供するために使用され、人間はその後、任意の容疑者をフォローアップすることができる。しかし、これらのシステムはしばしば自動化バイアスに悩まされる。これは、人間がループの中にいることの目的を打ち破り、誤認逮捕、またはそれ以上の恐怖につながる可能性がある。

有効性を向上させる努力は、道徳的な配慮も必要になる。多くのAI企業は、コンピュータビジョンを使って歩行や顔を調べることで、その人の感情や精神状態を判断できると言っている。このようなツールの信頼性には議論の余地があるが、その目的そのものが不道徳であると考える人もいる。極端に言えば、このような予測の努力は、AIの骨相学に相当する不条理な研究につながる。

最後に、説明責任と透明性がなければ、上記のどれも問題にならない。民間企業が誰にも知られず、誰の同意も得ずにデータを収集したり、契約が秘密裏に締結されたり、監査の要求よりも所有権の問題が優先されたり、国家と国の間の法律や規制が矛盾していたり、影響評価が任意であったりすると、人権が失われてしまう。そして、それは受け入れられない。

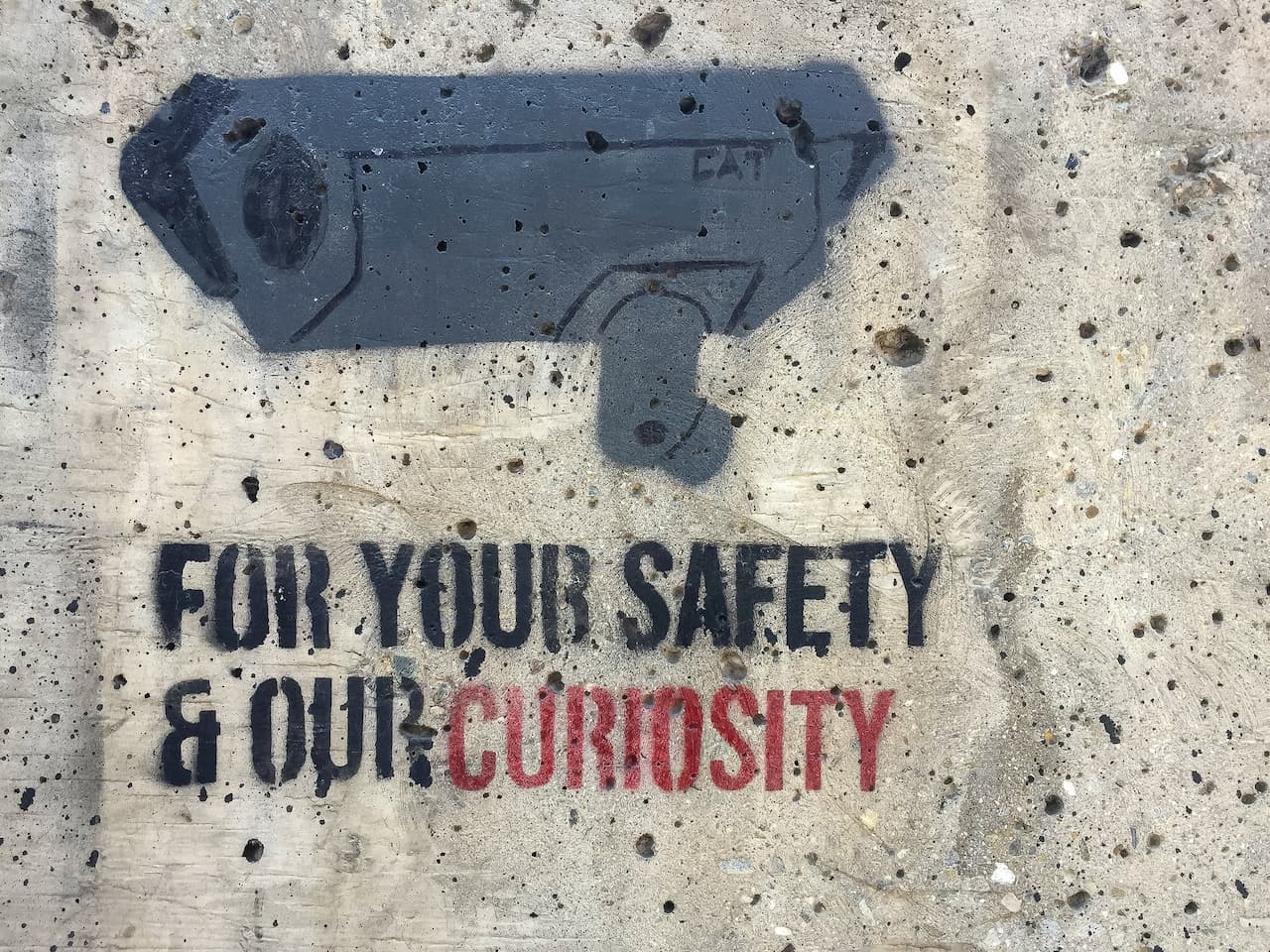

Photo by Amanda Dalbjörn on Unsplash